UL Solutions führt neuen Standard zur Regulierung von KI ein

UL hat über 120 Jahre Erfahrung in der Gewährleistung von Produktsicherheit. In der letzten Woche hat das Unternehmen zum ersten Mal eine neue Zertifizierung für KI-gestützte Produkte herausgegeben. Die CEO des Unternehmens erklärte: „Innovation ohne Sicherheit ist ein Versagen.“

Die Notwendigkeit eines Standards

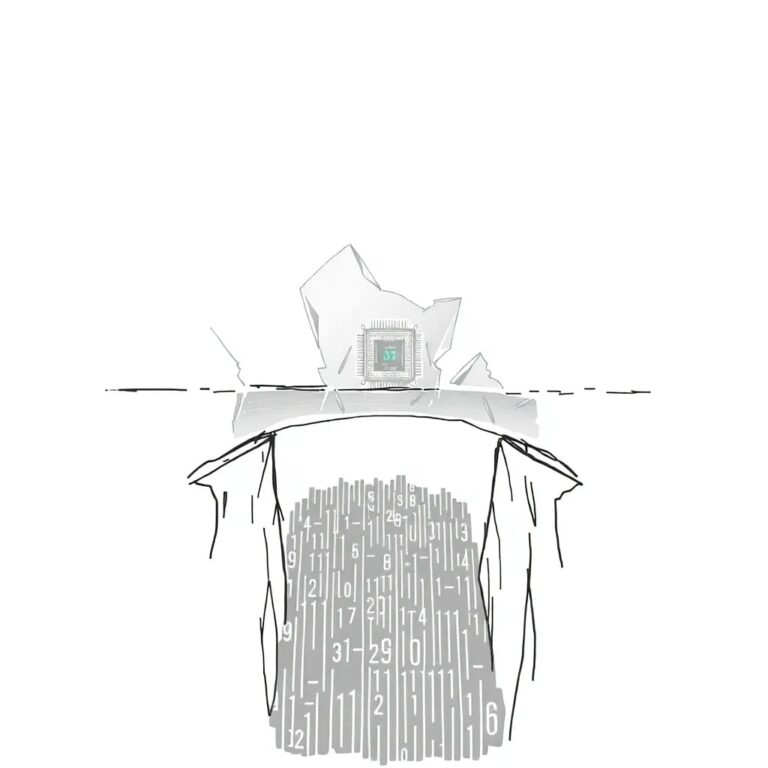

Technologien entwickeln sich rasant, während die Aufsicht darüber oft hinterherhinkt. Ein aktuelles Beispiel ist OpenClaw, ein autonomer virtueller Agent, der in China große Aufmerksamkeit erregt hat. Die Frage bleibt, ob private Sicherheitsstandards in der Lage sind, die Lücken zu schließen, die von der Regierung nicht gefüllt wurden.

Der UL-Standard UL 3115 bewertet, ob ein KI-gestütztes Produkt sicher, robust und gut verwaltet ist, wobei ein „Mensch in Kontrolle“ während des gesamten Lebenszyklus des Produkts berücksichtigt wird. Kunden suchen zunehmend nach Standards, die ihnen Vertrauen geben, insbesondere wenn keine staatliche Regulierung vorhanden ist.

Funktionale Sicherheit und Herausforderungen

Die Expertise von UL liegt in der funktionalen Sicherheit. Ein Beispiel ist die Frage, wie sicher die Software ist, die in Produkten wie Autos verwendet wird. Die Ingenieure und Wissenschaftler von UL arbeiten eng mit den Kunden zusammen, um deren Bedenken zu verstehen.

Bei KI-gestützten Produkten wird über die Transparenz von Algorithmen, mögliche Vorurteile in den Daten und die Verifizierung der Trainingsdaten nachgedacht. Es ist entscheidend, dass ein menschlicher Aufsichtsmechanismus vorhanden ist, um die Sicherheit zu gewährleisten.

Aktuelle Zertifizierungen

Bisher wurden zwei Produkte mit dem KI-Zertifikat ausgezeichnet: ein Energiemanagementsystem und eine Smart-Building-Lösung. Diese Zertifizierung ist ein Schritt in die richtige Richtung, um das Gleichgewicht zwischen Innovation und Sicherheit zu fördern.

Fazit

Mit der Einführung des neuen Standards setzt UL einen wichtigen Schritt in der Regulierung von KI-gestützten Produkten. Die Herausforderungen, die mit der schnellen Entwicklung dieser Technologien einhergehen, erfordern klare Richtlinien und Sicherheitsstandards, um das Vertrauen der Verbraucher zu gewährleisten.