Washington führt neue KI-Gesetze zur Bekämpfung von Fehlinformationen und zum Schutz von Minderjährigen ein

Washington hat kürzlich neue Gesetze zur Regulierung von künstlicher Intelligenz (KI) verabschiedet. Unter zwei von der Regierung unterzeichneten Gesetzen müssen Unternehmen neue Offenlegungen in ihren beliebten Chatbots für Benutzer in Washington einführen.

Gesetzesentwurf zur Bekämpfung von Fehlinformationen

Der Gesetzesentwurf zielt darauf ab, KI-generierte Fehlinformationen zu bekämpfen. Wenn Inhalte erheblich mithilfe von generativer KI verändert werden, müssen diese Informationen nun durch Wasserzeichen oder Metadaten nachverfolgbar sein. Dieses Gesetz gilt für große KI-Unternehmen mit mehr als 1 Million monatlichen Abonnenten.

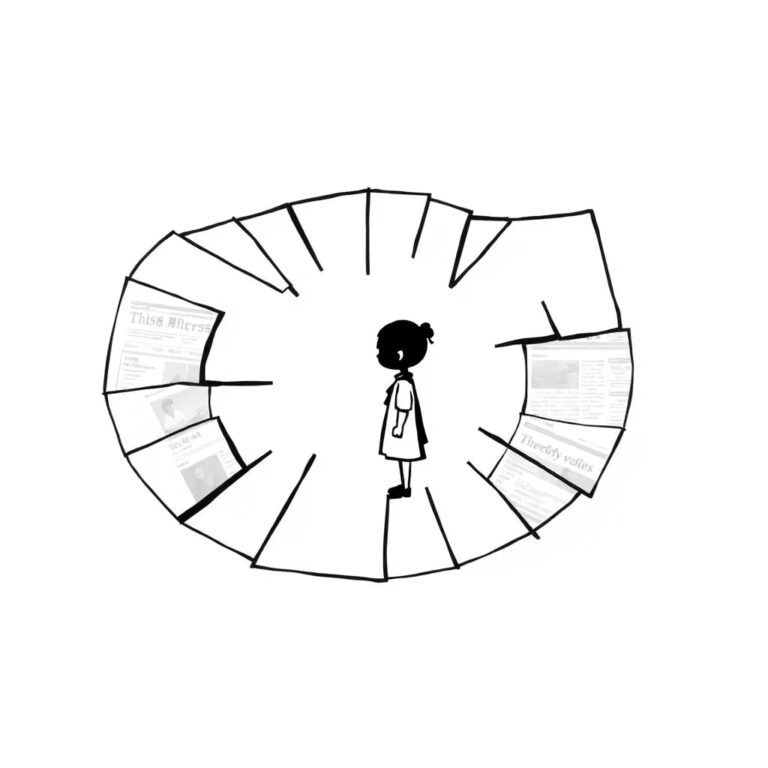

Regelungen für KI-Chatbots

Ein weiterer Gesetzesentwurf legt neue Richtlinien für KI-Chatbots fest, die wie Freunde oder Begleiter agieren. Chatbots wie ChatGPT müssen den Benutzern zu Beginn jedes Gesprächs und alle drei Stunden in einem laufenden Chat mitteilen, dass sie keine Menschen sind. Diese Tools dürfen auch nicht vorgeben, menschlich zu sein.

Besondere Vorschriften für Minderjährige

Für Benutzer, die Minderjährige sind, müssen Unternehmen alle Stunde darauf hinweisen, dass die Tools keine Menschen sind. Darüber hinaus verbietet das Gesetz KI-Begleiter, mit Minderjährigen sexuell explizite Gespräche zu führen, und es sind keine manipulativen Engagement-Techniken erlaubt. Beispielsweise dürfen Chatbots Minderjährige nicht dazu drängen, Informationen vor Eltern geheim zu halten.

Schutz der psychischen Gesundheit

Unter dem Gesetz dürfen KI-Chatbots nicht zur Förderung von Selbstmord oder Selbstverletzung ermutigen oder Informationen darüber bereitstellen. Die Unternehmen müssen ein Protokoll zur Kennzeichnung von Gesprächen entwickeln, die auf Selbstverletzung hinweisen, und Benutzer mit psychischen Gesundheitsdiensten verbinden.

Schlussfolgerung

Die neuen Vorschriften kommen als Reaktion auf mehrere hochkarätige Fälle von Selbstmord unter Jugendlichen, die nach längeren Interaktionen mit KI-Begleitern auftraten, die Warnzeichen zeigten. Viele weitere KI-Nutzer aller Altersgruppen haben nach intensiver Nutzung der Technologie von psychischen Problemen und Psychosen berichtet.