AI hat die Haube dicht gemacht: Bald kann niemand mehr Code reparieren, wenn er kaputt geht

Seit der Einführung des Verbrennungsmotors konnten Autowerkstätten fast alles für jede Marke und jedes Modell mit einfachen Werkzeugen reparieren. Dann kam die Modernisierung; die Einspritzmotoren übernahmen.

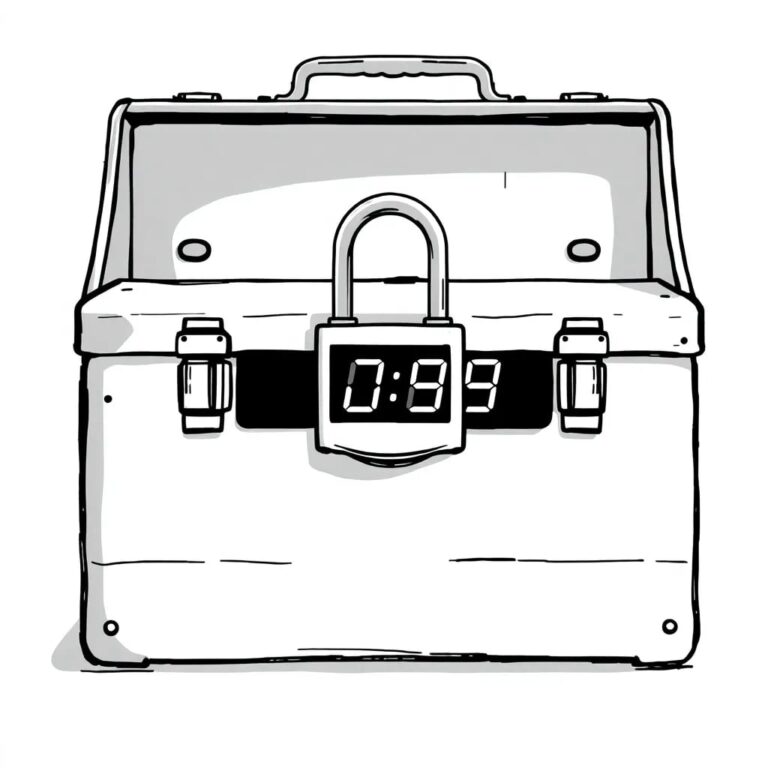

In ähnlicher Weise, wie Einspritzmotoren Kolben, Zündkerzen und Vergaser ersetzt haben, sorgt die KI-Programmierung dafür, dass niemand mehr unter die Motorhaube seines Autos schaut. Jetzt schaut niemand mehr auf seine Webanwendungen.

Risiken und Herausforderungen

Das Risiko, dass fehlerhafter Code überall auftaucht, ist ein Aspekt des Problems. Ein tiefgreifenderes Risiko ist jedoch der Verlust grundlegender Fähigkeiten zur Wartung und Pflege von Code. Es gibt keine austauschbaren Komponenten, wenn alles eine komplizierte Ansammlung von Softwarefunktionen und Bibliotheken ist, die beim Einsatz funktionieren könnten, aber dann unüberschaubar und unwartbar werden.

Apps laufen, aber immer weniger Menschen wissen wirklich, warum oder wie. Wenn wir die Beziehung zur zugrunde liegenden Technik verlieren, verlieren wir auch unsere Verbindung zur Qualität selbst. Dieser Verlust an Wartungsfähigkeit ist nicht nur unpraktisch, sondern auch ein neues Risiko.

Beweise für das Problem

Eine Studie zeigt, dass eines von fünf Unternehmen bereits einen ernsthaften Vorfall durch KI-generierten Code erlitten hat. Fast 70 % haben Schwachstellen entdeckt, die durch KI-Assistenten eingeführt wurden. Wenn KI einen Fehler einführt, weiß niemand, wer die Verantwortung dafür trägt.

Frühberufliche Ingenieure arbeiten fast ausschließlich auf der Abstraktionsebene. Sie liefern Code schneller, haben aber viel weniger Kontakt zu Systemen, Netzwerken oder Fehlermodi. Das schwächt das menschliche Urteilsvermögen, das notwendig ist, um KI-Ausgaben zu hinterfragen, bevor sie in die Produktion gelangen.

Die Verantwortung bei Algorithmusfehlern

Wenn ein Algorithmus versagt, stellt sich die Frage, wer die Schuld trägt. In einem Beispiel könnte ein Unternehmen, das klinische Ratschläge gibt, KI nutzen, um während der Patientenaufnahme Empfehlungen abzugeben. Wenn ein Patient aufgrund eines nicht-deterministischen Algorithmus eine unerwartete negative Folge erlebt, wird es sicherlich Schuldzuweisungen geben.

Wir sehen, dass KI-Tools die Kernwerte und die Sicherheitskultur einer Organisation verstärken. Wenn eine Organisation eine gute Sicherheits-DNA hat, werden KI-Tools diese Kultur verbessern. Fehlt es jedoch an Disziplin und grundlegendem Risikomanagement, wird die autonome Softwareentwicklung diese unreife Sicherheitskultur widerspiegeln.

Versicherung und Haftung

Die Versicherungsbranche ist auf die Herausforderungen von KI-generierten Schäden noch nicht vorbereitet. Versicherer müssen Deckungen für Fahrlässigkeit, IP-Verletzungen und regulatorische Haftungen schaffen, während große Versicherer versuchen, Ausschlüsse für KI aus bestehenden Policen zu erlangen.

Die Vereinfachung des Programmierens

Junior-Entwickler werden nicht ersetzt, sondern ihre Arbeit verändert sich. Die Verwendung von KI führt dazu, dass die Qualität der Ausgaben abnimmt. Der Begriff „Slop“ wird auf die Ausgaben von KI-Modellen angewendet, die oft eine pejorative Bedeutung haben.

Wir erleben eine Vereinfachung in der Softwareentwicklung. Die Idee, dass eine Gruppe von Affen mit Schreibmaschinen die kompletten Werke von Shakespeare produzieren könnte, illustriert Wahrscheinlichkeit und Unvermeidlichkeit, aber auch, dass Kreativität und Intention essentielle Elemente der Qualität sind.

Tool-Sprawl und seine Folgen

Untersuchungen zeigen, dass Teams, die Sicherheitsvorfälle erlitten haben, mehr Anbieter-Tools nutzen als solche, die keine Vorfälle hatten. Zu viele Tools verschärfen die Probleme; AI-generierter Code trägt dazu bei.

Eine SOC2-Prüfung sucht nach der Differenz zwischen veröffentlichten Richtlinien und der tatsächlichen Praxis. Wenn Unternehmen Richtlinien haben, die nicht durchgesetzt werden können, ergeben sich Probleme.

Fazit

Bretter sollten fragen: „Können Sie mir genau zeigen, wo KI-generierter Code aktuell in der Produktion läuft und wer für sein Verhalten verantwortlich ist?“

CISOs müssen in der Lage sein zu antworten: „Wir können jede Instanz von KI-generiertem Code identifizieren, verfolgen, wer sie genehmigt hat, und darlegen, wie sie überprüft wurde.“

Wenn diese Fragen nicht beantwortet werden können, gibt es keine Governance, sondern nur gut geschriebene Fiktion.