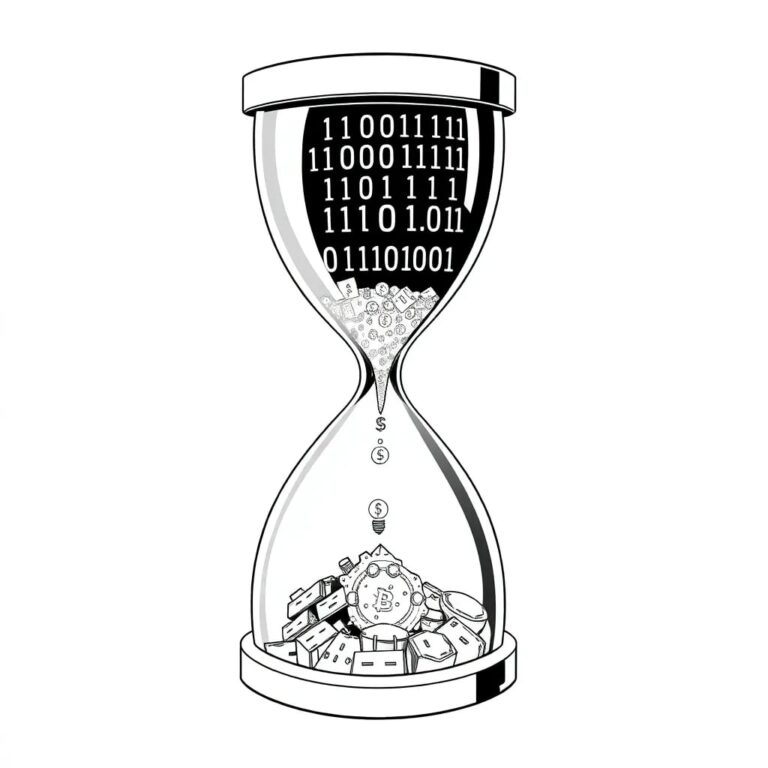

AI im Jahr 2026: Finanzdienstleistungen ziehen voraus, aber Risiko- und Governance müssen aufholen

AI ist mittlerweile tief in die Finanzdienstleistungen integriert, doch die Governance und Aufsicht haben nicht Schritt gehalten, was wachsende operationale, regulatorische und Vertrauensrisiken für Unternehmen und Berater schafft.

AI im Finanzsektor

Wir sind bereits einen Monat im Jahr 2026 und es ist klar, dass AI keine futuristische Ambition mehr für die Finanzdienstleistungen ist. Sie ist zunehmend in den täglichen Betrieb von Banken, Versicherungen und Vermögensverwaltern eingebettet und wird in Bereichen wie der Echtzeit-Betrugserkennung, Kreditentscheidungen und der Bereitstellung personalisierter Kundenreisen eingesetzt.

Für Berater gestaltet sich das Onboarding schneller, die Portfolio-Insights sind datengetrieben, und die digitale Interaktion wird zur Norm.

Herausforderungen bei der Governance von AI

Die Governance von AI hat jedoch nicht Schritt gehalten. Viele Unternehmen verlassen sich weiterhin auf Rahmenbedingungen, die für statische Modelle ausgelegt sind und die dynamische, kontinuierlich lernende Natur von AI nicht berücksichtigen. Dies führt zu einer wachsenden Lücke in der operationale Resilienz, regulatorischen Bereitschaft und Cyber-Abwehr, die, wenn sie nicht angegangen wird, das Vertrauen der Kunden untergraben kann.

AI-Entscheidungen im Mainstream

AI-gestützte Entscheidungen beeinflussen mittlerweile Kreditgenehmigungen, Betrugswarnungen, Risikoprofilierung und Kundensegmentierung. Im Gegensatz zu traditionellen Systemen sind moderne Modelle oft adaptiv und aktualisieren sich mit neuen Daten. Veraltete Kontrollen, die auf einmaligen Validierungen und historischen Backtests basieren, sind nicht ausreichend. Ohne fortlaufende Aufsicht riskieren Unternehmen eine Drift, die die Leistung beeinträchtigt, versteckte Vorurteile, die Ergebnisse schädigen, und Entscheidungen, die für Kunden oder Aufsichtsbehörden schwer zu erklären sind.

Über traditionelle Modellrisikomanagement hinaus

Das traditionelle Modellrisikomanagement bleibt grundlegend, muss jedoch für AI ergänzt werden. Unternehmen sollten kontinuierliches Monitoring, Lebenszyklus-Governance und strenge Dokumentation der Datenherkunft, Schulung, Tests und Aktualisierungen übernehmen. Dies geht über die Compliance hinaus; es geht um Resilienz. Unüberwachte Modelle können lautlos degradieren, bis Probleme für Kunden oder Aufsichtsbehörden sichtbar werden.

Cyber-Bedrohungen und Verantwortlichkeit

AI erweitert sowohl die Angriffsfläche als auch die Angriffsvektoren. Bedrohungen wie Datenvergiftung, Modellinversion, Modellklau und Eingabeaufforderungsangriffe werden immer ausgeklügelter. Ein wirksamer Schutz erfordert nun eine Kombination aus Cybersecurity-Disziplin und einem Verständnis dafür, wie Modelle im Laufe der Zeit lernen und sich verhalten, insbesondere wenn es um Kundendaten und Vertrauen geht.

Regulierung und ethische Aufsicht

Die Verantwortung für die Governance von AI wird zunehmend auf Vorstände und die Unternehmensführung übertragen, neben Cyber-Sicherheit und finanziellen Kontrollen. Dies schließt ein, dass Mitarbeiter nicht nur im Umgang mit AI-Tools geschult werden, sondern auch die regulatorischen, reputationsbezogenen, finanziellen, ethischen und operationale Risiken verstehen und managen können.

Regulatorische Erwartungen

Die regulatorischen Erwartungen werden strenger. Der EU AI Act und aufkommende Standards drängen Unternehmen dazu, verantwortungsvolle AI-Prinzipien von Anfang an zu verankern, einschließlich Risikoeinstufung, Dokumentation, Transparenz und Nachverfolgung nach dem Markt, anstatt Kontrollen nachträglich anzupassen.

Governance als Wettbewerbsvorteil

Der entscheidende Faktor im Jahr 2026 wird nicht sein, wie weit verbreitet AI eingesetzt wird, sondern wie intelligent sie regiert wird. Unternehmen, die in robuste Aufsicht, Transparenz und ethische Rahmenbedingungen investieren, werden mit Zuversicht innovieren, Kunden schützen und glaubwürdig auf regulatorische Prüfungen reagieren können.

Für Berater und ihre Kunden ist eine effektive AI-Governance kein abstraktes technisches Problem, sondern fundamental für Vertrauen, Resilienz und die Glaubwürdigkeit von Finanzberatung in einer zunehmend automatisierten Welt.