DOT plant den Einsatz von Künstlicher Intelligenz zur Erstellung von Sicherheitsvorschriften, was Besorgnis auslöst

Bald könnten die Sicherheitsvorschriften, die Flugzeuge in der Luft halten, Autofahrer schützen und Explosionen von Erdgas-Pipelines verhindern, von Künstlicher Intelligenz verfasst werden. Dies beunruhigt einige Personen im Verkehrsministerium, insbesondere vor dem Hintergrund des Fokus auf Quantität statt Qualität, wobei das Ministerium nach „ausreichend gut“ strebt.

Die Rolle von Künstlicher Intelligenz

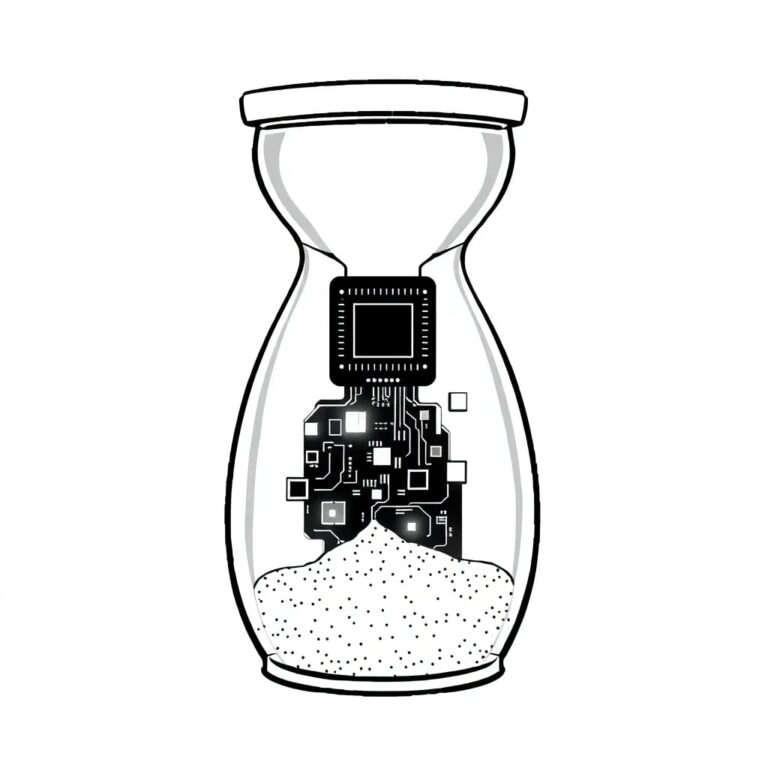

So genannte Künstliche Intelligenz hat jeden Aspekt unseres Lebens berührt. Alles scheint heutzutage „KI“ zu sein, obwohl es wenig Intelligenz im eigentlichen Sinne gibt. Der Begriff „Künstliche Intelligenz“ bezieht sich fast immer auf große Sprachmodelle (LLMs), die alles andere als intelligent sind. Stattdessen sind sie gut darin, vorherzusagen, welches Wort (oder Pixel) am besten neben einem anderen verwendet werden kann, indem sie unzählige ähnliche Kontexte analysieren.

Fehler von KI sind häufig, auch wenn die von einem Chatbot verfassten Sätze auf den ersten Blick sinnvoll erscheinen. Diese LLMs haben absolut keine Ahnung von der Bedeutung der Worte, die sie ausgeben. Trotz dieser Einschränkungen werden LLMs zunehmend von Menschen genutzt, die zu faul sind, um eigene Recherchen anzustellen. Das Problem dabei ist, dass diese Personen oft nicht wissen, ob der Chatbot korrekt ist.

Besorgnis im Verkehrsministerium

Dies erklärt, warum einige Mitarbeiter im Verkehrsministerium besorgt sind, dass nun KI-Chatbots zur Erstellung von Sicherheitsvorschriften eingesetzt werden sollen. Die Mitarbeiter befürchten, dass Fehler der KI zu fehlerhaften Vorschriften führen könnten, die im besten Fall zu Rechtsstreitigkeiten führen und im schlimmsten Fall Verletzungen und Todesfälle im Verkehrssystem verursachen könnten.

Während einer Demonstration der Regelentwurf-Fähigkeiten von Gemini erzeugte das LLM ein Dokument, dem Schlüsseltexte fehlten, die ein Mitarbeiter ergänzen musste. Dennoch scheint der leitende Anwalt des Ministeriums nicht besorgt zu sein. Er erklärte, dass er Gemini wollte, weil es Regeln in weniger als 30 Minuten entwerfen könnte, während menschliche Berater Wochen oder sogar Monate benötigen.

Die Risiken von „ausreichend gut“

Die Vorschriften betreffen jeden Aspekt der Verkehrssicherheit, und „ausreichend gut“ reicht nicht aus. In diesem Fall könnte jeder Fehler ernsthafte Folgen haben. Ein Mitarbeiter bezeichnete dies als „wild verantwortungslos“. Zu den mit der Hilfe von Gemini entworfenen Regeln gehört eine noch nicht veröffentlichte Regel der Federal Aviation Administration.

Es scheint, dass eine schnelle Einführung von KI in federalen Behörden angestrebt wird. Das Verkehrsministerium möchte „die Speerspitze“ dieser Bemühungen sein und die erste Behörde sein, die vollständig in der Lage ist, KI zur Erstellung von Vorschriften zu nutzen.