Einführung

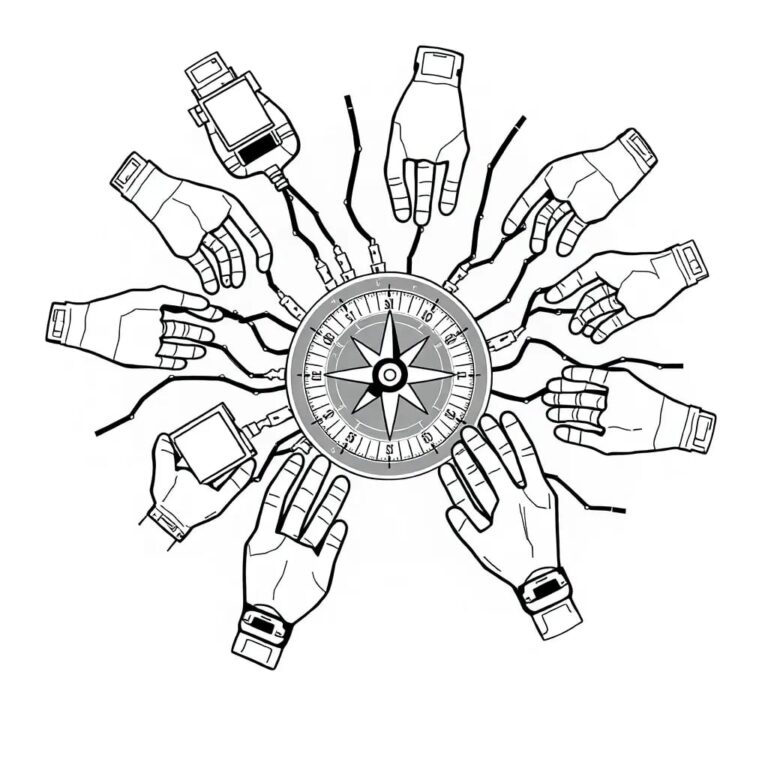

Der rasante Fortschritt im Bereich der künstlichen Intelligenz führt zu einem kollektiven Handlungsproblem: Unternehmen konkurrieren um Marktanteile und reduzieren dabei die Sicherheitsstandards. Ohne koordinierte Regelungen entsteht ein Wettlauf nach unten bei der Risikobewertung.

Kernanalyse des Selbstregulierungsmodells

Struktur des Modells

Ein selbstregulierender Zusammenschluss, vergleichbar mit etablierten Modellen im Finanzsektor, ermöglicht es Branchenakteuren, verbindliche Regeln zu erarbeiten, die von einer Aufsichtsbehörde genehmigt und überwacht werden. Die Finanzierung erfolgt durch Gebühren der Mitgliedsunternehmen, wodurch ein unabhängiges Budget entsteht.

Herausforderungen

Vier zentrale Probleme müssen adressiert werden: Wettbewerbsdruck, Informationsasymmetrie, das Tempo der technologischen Entwicklung im Vergleich zum Gesetzgebungsprozess und die Notwendigkeit präventiver Eingriffe, bevor Risiken irreversibel werden.

Implikationen und Risiken

Wettbewerbsdruck

Ohne einheitliche Standards investieren Unternehmen weniger in Sicherheit, weil sie befürchten, Marktanteile zu verlieren. Ein verpflichtender Zusammenschluss würde diesen Druck mindern, indem alle Akteure denselben Sicherheitsrahmen einhalten.

Informationsasymmetrie

Die notwendigen Details zu Trainingsdaten und Sicherheitsbewertungen sind häufig proprietär. Durch die Einbindung technischer Experten aus den Unternehmen in standardsetzende Ausschüsse kann die Transparenz erhöht werden.

Tempo der Regulierung

Ein flexibles Regelwerk, das kurzfristige Änderungen ohne langwierige Gesetzgebungsverfahren ermöglicht, ist entscheidend, um mit den schnellen Fortschritten in der KI Schritt zu halten.

Fazit

Ein von einer Aufsichtsbehörde beaufsichtigter Selbstregulierungsverband bietet eine praktikable Lösung für die komplexen Herausforderungen der KI‑Sicherheit. Durch verbindliche, von der Branche mitgestaltete Regeln und ein unabhängiges Finanzierungsmodell kann ein ausgewogenes Verhältnis zwischen Innovation und Risikominimierung erreicht werden.