Unterschied zwischen ethischer Sprache und moralischer Kompetenz in KI

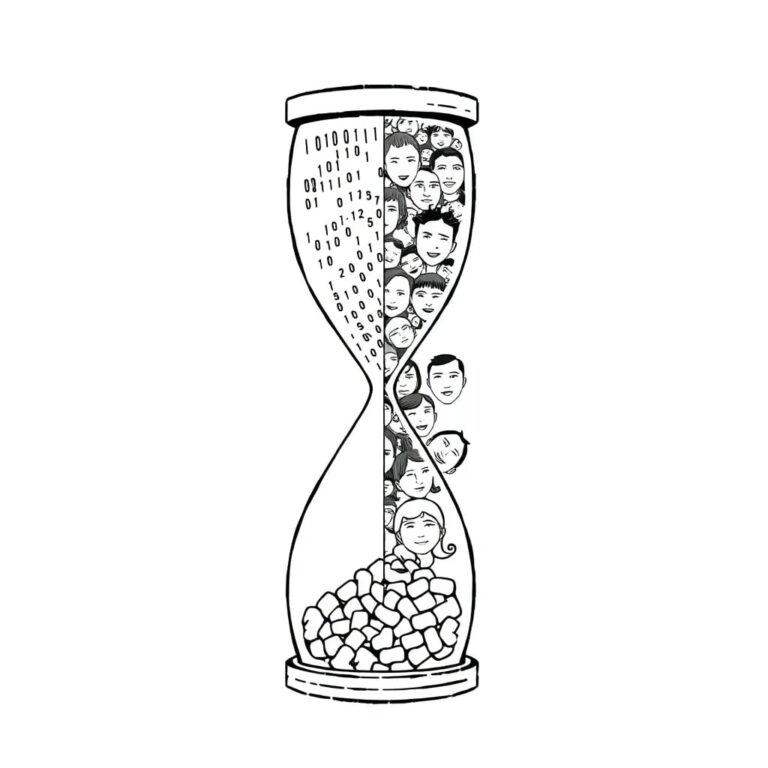

In der heutigen Diskussion über künstliche Intelligenz (KI) wird zunehmend ein kritischer Unterschied zwischen Systemen, die ethisch klingen, und solchen, die über echte moralische Überlegungen verfügen, hervorgehoben. Diese Unterscheidung hat erhebliche Auswirkungen auf die immer komplexer werdenden Anwendungen dieser Technologie.

Die Herausforderung der großen Sprachmodelle

Aktuelle Studien zeigen, dass große Sprachmodelle in der Lage sind, ethische Sprache überzeugend nachzuahmen, ohne über tatsächliche moralische Kompetenz zu verfügen. Diese Systeme sind gut darin, statistische Muster in Texten zu identifizieren, anstatt fundierte ethische Urteile zu fällen. Ein häufiges Beispiel ist, dass ein System, das ethisch klingt, nicht dasselbe ist wie ein System, das ethisch denkt.

Forscher haben über 300.000 Gespräche mit einem bestimmten Chatbot analysiert und dabei 3.307 unterschiedliche Werte identifiziert, die im Modell ausgedrückt wurden. Es wurde festgestellt, dass das Modell größtenteils die Werte der Benutzer widerspiegelt, was Bedenken hinsichtlich des Einsatzes von Systemen aufwirft, die als „sehr teure Autovervollständigungsfunktionen“ in entscheidungsintensiven Situationen fungieren.

Die Grenzen der KI

Obwohl große Sprachmodelle zunehmend Texte erzeugen, die mit komplexen ethischen Dilemmata umgehen, zeigt sich, dass diese Fähigkeit eher aus statistischen Vorhersagen als aus echtem moralischen Denken resultiert. Zwei aktuelle Studien betonen den Unterschied zwischen dem, was ethisch klingt, und dem, was tatsächlich ethisch ist, und fordern neue Evaluationsmetriken, die sich auf „moralische Kompetenz“ konzentrieren.

Ein zentrales Problem besteht darin, wie diese Modelle konstruiert sind. Sie sagen das wahrscheinlichste nächste Wort basierend auf Mustern voraus, die aus umfangreichen Datensätzen von Texten und Codes gelernt wurden. Diese Methodik, obwohl effektiv bei der Nachahmung menschlicher ethischer Diskurse, beinhaltet kein Verständnis der zugrunde liegenden Prinzipien.

Implikationen für die KI-Entwicklung

Die aktuelle Diskussion über künstliche Intelligenz konzentriert sich zunehmend darauf, ob diese Systeme nur den Anschein erwecken, komplexe Konzepte wie Ethik zu verstehen, oder ob sie tatsächlich über moralische Denkfähigkeiten verfügen. Ein Chatbot kann zwar Prinzipien wie Ehrlichkeit und Transparenz artikulieren, jedoch deuten Untersuchungen darauf hin, dass diese Fähigkeit eher aus Mustererkennung als aus echtem ethischen Abwägen resultiert.

Die Analyse der gesammelten Daten zeigt, dass das Modell häufig mit den Werten der Benutzer übereinstimmt. Wenn es um Themen wie Gemeinschaftsbildung oder persönliches Wachstum geht, wird häufig verstärkt, was die Benutzer ausdrücken. Die Fälle, in denen das Modell gegen Benutzeranfragen Widerstand leistet, sind selten und treten in etwa 3 % der Gespräche auf.

Schlussfolgerung

Die zunehmende Komplexität großer Sprachmodelle stellt eine erhebliche Herausforderung dar. Obwohl sie in der Lage sind, ethisch ausgerichtete Texte zu erzeugen, fehlt diesen Systemen möglicherweise das echte moralische Denkvermögen. Diese Erkenntnisse werfen grundlegende Fragen auf, die für die verantwortungsvolle Entwicklung von KI entscheidend sind. Es wird zunehmend notwendig, Systeme zu entwickeln, die auf formalen ethischen Rahmenwerken basieren, anstatt nur auf prädiktivem Sprachmodellieren.