Warum agentische KI-Systeme eine bessere Governance benötigen – Lektionen von OpenClaw

Organisationen benötigen dringend Governance-Rahmenwerke, die auf Sichtbarkeit, Zugriffskontrolle und Verhaltensüberwachung basieren, um die erweiterte Angriffsfläche zu verwalten, die diese Systeme schaffen.

Einführung in OpenClaw

OpenClaw ist eine Open-Source-Plattform für autonome KI-Agenten, die lokal auf Ihrem Rechner für die Automatisierung von Aufgaben gehostet werden kann. Diese Plattform ermöglicht es KI-Agenten, über ein experimentelles soziales Netzwerk namens Moltbook miteinander zu interagieren. Selbst erfahrene Sicherheitsforscher haben festgestellt, dass OpenClaw nicht ohne seine Herausforderungen ist, wie etwa der unbeabsichtigte Verlust von E-Mails durch einen KI-Agenten.

Die neue Rolle der KI-Assistenten

OpenClaw-KI-Assistenten sind keine veralteten Chatbots mehr. Sie haben ein erhebliches Upgrade erfahren und fungieren nun als Automatisierungsschicht, die über Chats ausgeführt wird. Sie können auf Tools und Systeme zugreifen und nutzen anhaltende Erinnerungen und vererbte Berechtigungen, um im Namen des Nutzers zu handeln. Diese Übergang von Empfehlungen zu Aktionen bedeutet, dass Organisationen diese Veränderung aus der Perspektive der Governance betrachten müssen, mit Fokus auf verbesserte Sichtbarkeit, Kontrolle und Durchsetzung zur Unterstützung eines besseren Risikomanagements.

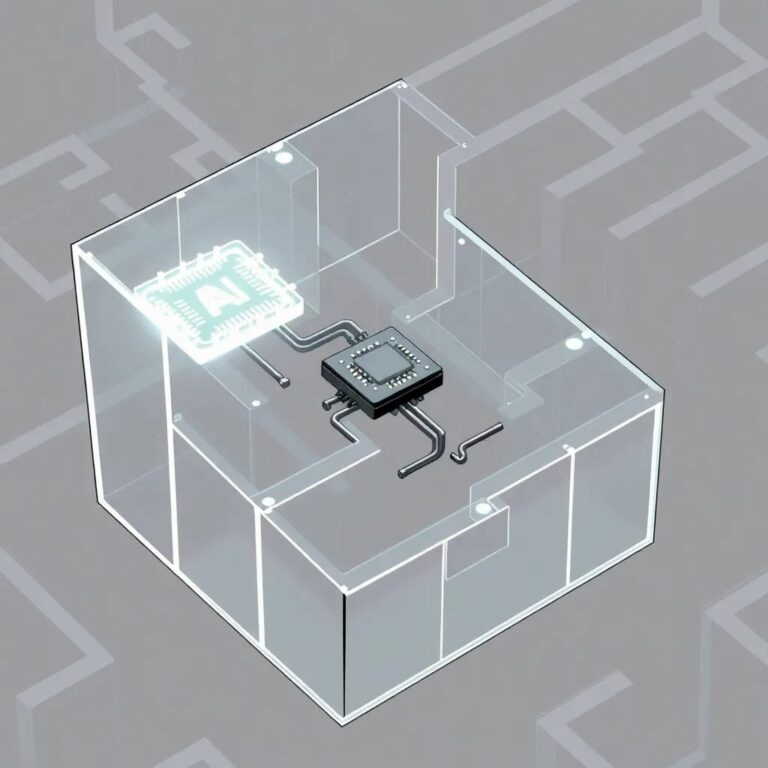

Die Anatomie des OpenClaw-Rahmenwerks

Ein typischer Anfrageprozess beginnt in einem Chat oder einem Messaging-Tool, das möglicherweise außerhalb der üblichen Unternehmensanwendungen liegt. Das Gateway empfängt die Anfrage, verfolgt das laufende Gespräch und entscheidet, welche verbundenen Tools oder Dienste verwendet werden. Sobald die notwendigen Schritte abgeschlossen sind, wird das Ergebnis dem Nutzer als Antwort im Chat zurückgegeben.

Risiken durch Schwachstellen

Die Risiken steigen, wenn das Gateway über seinen vorgesehenen Netzwerkbereich hinausgeht und von außen erreichbar wird. Schwache Zugriffskontrollen können die Gefahr weiter erhöhen, da Angreifer möglicherweise erfolgreich authentifiziert werden und Aktionen auslösen können. Viele Gateways verwenden sowohl reguläre HTTP-Endpunkte als auch langfristige WebSocket-Verbindungen, wo Sicherheitslücken entstehen können.

Governance-Defizite bei OpenClaw

Die Empfehlungen von OpenClaw konzentrieren sich auf die Minimierung der Exposition des Gateways, die Durchsetzung starker Authentifizierung und die Behandlung aller Protokolle als heilig. Diese Richtlinien können jedoch in großem Maßstab unzureichend sein, insbesondere in drei hochriskanten Bereichen:

- Prompt Injection: Schadhafte Anweisungen können dazu führen, dass der Assistent auf Daten zugreift, auf die er nicht zugreifen sollte.

- Supply Chain Drift: Erweiterungen können schleichend breite Berechtigungen erlangen und den Zugriff des Assistenten erweitern.

- Malware-Zustellung: Bekannte Tools werden häufig verwendet, um Malware durch gefälschte Installateure oder Erweiterungen auszuliefern.

Der ideale Governance-Ansatz

Der ideale Governance-Ansatz sollte auf Sichtbarkeit, Kontrolle und der Blockierung schädlicher Pfade basieren. Mit einem signifikanten Anteil an Mitarbeitenden, die nicht genehmigte KI-Agenten nutzen, ist es entscheidend, Sichtbarkeit in die Nutzung dieser Systeme zu erhalten und geeignete Richtlinien zu implementieren.

Fazit

Die Verwaltung von Risiken agentischer KI erfordert mehr als nur veraltete Sicherheitsansätze. Es bedarf tieferer Einblicke in Bedrohungen wie Prompt Injection und Datenexfiltration, um die Risiken in realen Umgebungen zu verstehen. Daher ist die Sicherheit von KI auf kontinuierliche Forschung und bessere Verhaltensanalysen angewiesen.