Ist die KI Ihrer Organisation eine versteckte Bedrohung? Die Gefahren von Shadow AI enthüllen

In Ihrer Organisation meldet sich gerade jemand für ein künstliche Intelligenz (KI)-Tool an. Sei es ein Marketingmanager, der mit der Inhaltsgenerierung experimentiert, ein Entwickler, der einen KI-Coding-Assistenten integriert, oder ein Finanzteam, das automatisierte Berichterstattung erkundet.

Diese Mitarbeiter handeln nicht leichtfertig, sondern einfallsreich. Sie haben etwas gefunden, das ihre Arbeit schneller, einfacher und besser macht. Sie haben das Tool mit Ihren Systemen verbunden und ihm Zugang zu Ihren Daten gewährt.

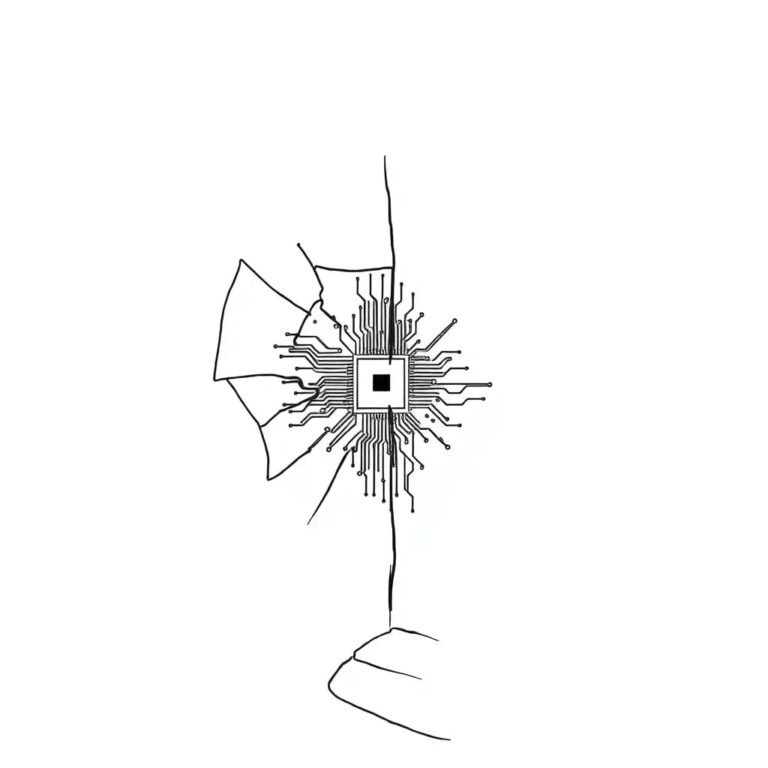

Was sie wahrscheinlich nicht getan haben, ist, die IT darüber zu informieren. Und was die IT fast sicher nicht getan hat, ist, dieses Tool und die damit verbundenen Identitäten in Ihr Governance-Framework zu integrieren. Dies ist das Phänomen der Shadow AI und es verursacht eine Identitätskrise, der sich viele Organisationen noch nicht bewusst sind.

Das Problem der Shadow AI

Die Einführung von KI in südafrikanischen Unternehmen hat dramatisch zugenommen. Laut einem Bericht des Weltwirtschaftsforums und des Global Cyber Security Capacity Centre der Universität Oxford im Januar 2025 erfolgt ein Großteil der aktuellen KI-Bereitstellung explorativ oder experimentell, wobei Organisationen kleinere, praxisbezogene Ansätze verwenden, die Ideation und schnelle Implementierung betonen.

Das Problem ist nicht das Experimentieren selbst; Innovation erfordert Freiheit zum Erkunden. Das Problem entsteht jedoch, wenn diese Experimente in den regulären Geschäftsbetrieb eingebettet werden, ohne die strengen Risikobewertungen, Systemtests und Governance-Überwachung, die formelle Bereitstellungen erfordern würden.

Jedes KI-Tool, das mit Ihrer Umgebung verbunden ist, schafft neue Identitäten. API-Schlüssel, die Anfragen authentifizieren, Servicekonten, die auf Datenbanken zugreifen, und Tokens, die dauerhafte Verbindungen aufrechterhalten. Diese nicht-menschlichen Identitäten vervielfachen sich schnell, oft ohne in einem Register zu erscheinen oder unter eine Governance-Richtlinie zu fallen.

In Organisationen, in denen nicht-menschliche Identitäten bereits die menschlichen Benutzer im Verhältnis 10:1 oder mehr übersteigen, beschleunigt Shadow AI dieses Ungleichgewicht noch weiter, ganz außerhalb der Sichtbarkeit Ihres Sicherheitsteams.

Die Notwendigkeit von Sichtbarkeit

Traditionelles Identitäts- und Zugangsmanagement wurde mit einem klaren Prozess im Hinterkopf entwickelt. Jemand beantragt Zugang, die Anfrage wird bewertet, der Zugang wird gewährt oder verweigert, und die Entscheidung wird protokolliert. Wenn sich die Umstände ändern, wird der Zugang überprüft und angepasst.

Shadow AI umgeht diesen Prozess vollständig. Es gibt keine Anfrage, weil niemand daran denkt, eine zu stellen. Es gibt keine Bewertung, weil das Tool harmlos erscheint. Es gibt kein Protokoll, weil die Verbindung außerhalb genehmigter Kanäle erfolgt. Wenn der Mitarbeiter, der es eingerichtet hat, eine andere Rolle übernimmt oder das Unternehmen verlässt, bleibt das KI-Tool und seine Identitäten – verwaist, unüberwacht und potenziell anfällig.

Die oben genannten Risiken führen zu einem Mangel an Transparenz und schwächen die Managementprozesse sowie die Aufsicht der Führungsebene. Nachlässiges Softwaremanagement verstärkt das Problem weiter, da KI über nicht genehmigte Browser, Plugins und Open-Source-Tools eingeführt wird, die Entwickler ohne Überprüfung übernehmen.

Praktische Überprüfung

Hier ist ein praktischer Test: Kann Ihre Organisation diese Fragen mit Zuversicht beantworten?

Wie viele KI-Tools sind derzeit mit Ihren Systemen verbunden? Welche davon wurden formell genehmigt und welche wurden informell übernommen? Auf welche Daten können diese Tools zugreifen? Welche Identitäten wurden erstellt, um diese Verbindungen zu ermöglichen? Wer besitzt diese Identitäten? Wann wurden die Anmeldeinformationen zuletzt gewechselt? Was passiert mit diesen Verbindungen, wenn der Mitarbeiter, der sie erstellt hat, das Unternehmen verlässt?

In unserer Arbeit mit verschiedenen Unternehmen stellen wir fest, dass die meisten nicht einmal die Hälfte dieser Fragen beantworten können. Die Lücke hier ist infrastrukturell bedingt. Die Werkzeuge und Prozesse, die entwickelt wurden, um menschliche Arbeitskräfte zu verwalten, wurden einfach nicht für die sich ausbreitende Population von Maschinenidentitäten, die die KI-Einführung schafft, konzipiert.

Lösungsansätze für Shadow AI

Um Shadow AI anzugehen, muss mit dem begonnen werden, was kontrolliert werden kann: Sichtbarkeit. Sie können nicht steuern, was Sie nicht sehen können, und Sie können nicht sehen, wonach Sie nicht suchen.

Die Entdeckung ist der erste entscheidende Schritt. Automatisiertes Scannen kann KI-Integrationen in Ihrer Umgebung identifizieren, sowohl autorisierte als auch nicht autorisierte. Viele Shadow-AI-Bereitstellungen existieren einfach, weil es keinen klaren Prozess für die formelle Annahme gab. Sichtbarkeit und Zugänglichkeit dieses Prozesses reduzieren den Anreiz, ihn zu umgehen.

Das Inventar folgt der Entdeckung. Jedes KI-Tool, jede zugehörige Identität wird einem menschlichen Eigentümer und einem Geschäftszweck zugeordnet. Dies schafft Verantwortlichkeit. Wenn jemandem ein Name an einer Integration angehängt ist, wird das Gespräch über Governance natürlich und nicht konfrontativ.

Die Richtlinien müssen sich an die Realität anpassen. Umfassende Leitlinien, die festlegen, wie KI innerhalb der Organisation genutzt werden kann, wie neue Tools vor der Implementierung überprüft werden und wie die Identitäten, die diese Tools erstellen, während ihres gesamten Lebenszyklus verwaltet werden, stellen sicher, dass Innovation kein unbeabsichtigtes Risiko schafft.

Es gibt auch einen menschlichen Aspekt. Mitarbeiter übernehmen Shadow AI, weil sie den Wert darin sehen. Eine vollständige Blockierung dieser Übernahme führt dazu, dass das Verhalten noch weiter in den Untergrund gedrängt wird. Der effektivere Ansatz kombiniert Befähigung mit Governance.

Das bedeutet, dass IT-Administratoren geschult und befähigt werden müssen, um KI-Tools zu bewerten und zu verwalten. Es müssen klare Wege geschaffen werden, damit Mitarbeiter neue Tools anfordern können, mit Reaktionszeiten, die sie nicht zu inoffiziellen Alternativen treiben. Es erkennt an, dass die Einführung von KI unvermeidlich ist und positioniert Ihr Identitätsframework so, dass es dies ermöglicht, anstatt es zu widerstehen.

Fazit

Die Organisationen, die das richtig machen, betrachten Shadow AI als Signal und nicht nur als Bedrohung. Sie verstehen, wo und warum Mitarbeiter KI-Lösungen wünschen. Diese Erkenntnisse können die strategische KI-Einführung informieren, die die Produktivitätsvorteile bietet und gleichzeitig Sicherheit und Governance aufrechterhält.

Shadow AI ist eine gegenwärtige Realität, die mit jedem Tag komplexer wird. Jedes neue Tool, das ohne Aufsicht übernommen wird, jeder API-Schlüssel, der ohne Governance erstellt wird, und jedes Servicekonto, das außerhalb Ihres Identitätsframeworks existiert, summiert sich zu Risiken, die schwieriger zu beheben sind, je länger sie ignoriert werden.

Die gute Nachricht ist, dass die Prinzipien zur Bewältigung dieser Herausforderung bereits existieren. Entdeckung, Inventar, Eigentum, Lebenszyklusmanagement und kontinuierliche Überwachung sind dieselben Grundlagen, die für jede Identitätspopulation gelten. Was erforderlich ist, ist, deren Reichweite zu erweitern, um die KI-Tools zu umfassen, die bereits in Ihrer Umgebung aktiv sind.

Die KI, die Ihr Team letzte Woche übernommen hat, hat ihre eigene Identität. Die Frage ist, ob Sie sie proaktiv verwalten oder während einer Vorfalluntersuchung entdecken werden.