Ein weiteres Jahr, eine weitere Sitzung der KI-Überregulierung

Mit dem Auftakt der Gesetzgebungssitzung 2026 nimmt eine neue und bedeutende Phase in der Diskussion über die Meinungsfreiheit und künstliche Intelligenz Gestalt an. Eine neue Reihe von KI-Gesetzentwürfen wird voraussichtlich bestimmen, wie Menschen Maschinen zur Kommunikation nutzen, was grundlegende verfassungsmäßige Fragen zur Meinungsäußerung aufwirft.

Die Anwendung des Ersten Verfassungszusatzes

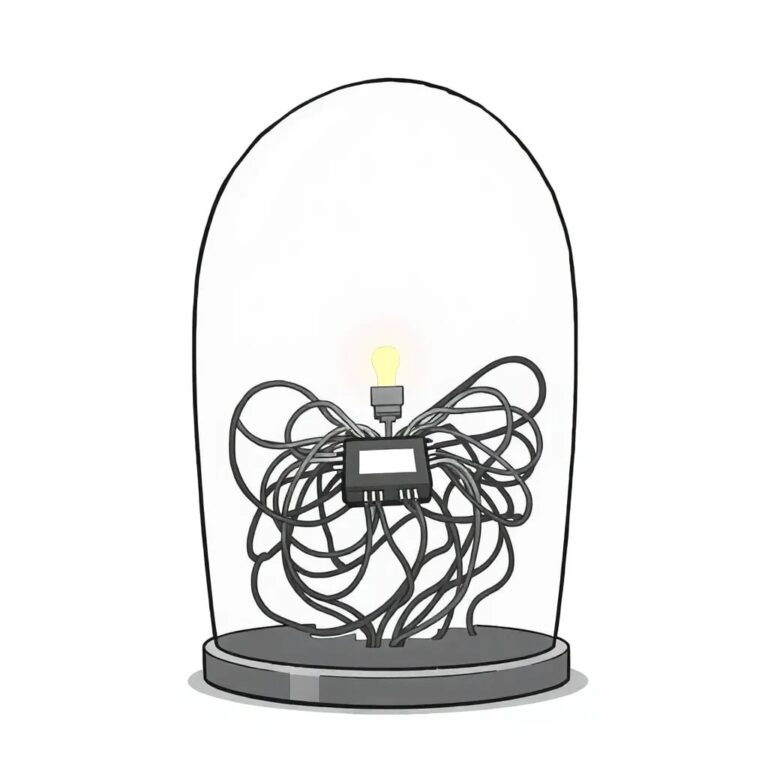

Der Erste Verfassungszusatz gilt für künstliche Intelligenz in ähnlicher Weise, wie er für frühere Ausdruckstechnologien gilt. Wie der Druck, die Kamera, das Internet und soziale Medien ist KI ein Werkzeug, das Menschen verwenden, um Ideen zu kommunizieren, Informationen zuzugreifen und Wissen zu generieren. Unabhängig vom verwendeten Medium schützt unsere Verfassung diese Formen des Ausdrucks.

Bestehende Gesetze und neue Vorschriften

Während die Gesetzgeber die KI-Politik 2026 erneut überdenken, ist zu beachten, dass bestehende Gesetze bereits viele der Schäden abdecken, die sie ansprechen möchten – Betrug, Fälschung, Verleumdung, Diskriminierung und Wahlbeeinflussung – unabhängig davon, ob KI verwendet wird. Betrug bleibt Betrug, unabhängig davon, ob man einen Stift oder eine Tastatur verwendet, da die Haftung ordnungsgemäß der Person zugewiesen wird, die rechtswidrige Handlungen begeht, und nicht dem Instrument, das sie dabei verwendet.

Viele der in diesem Jahr eingeführten oder erwarteten KI-Gesetzentwürfe stützen sich auf regulatorische Ansätze, die ernsthafte Bedenken hinsichtlich des Ersten Verfassungszusatzes aufwerfen. Einige würden verlangen, dass Entwickler oder Nutzer Haftungsausschlüsse oder Etiketten an rechtmäßig erzeugte KI-Ausdrücke anbringen, was sie dazu zwingt, als Sprachrohre der Regierung für Ansichten zu fungieren, die sie möglicherweise nicht vertreten.

Einschränkungen bei Wahl-bezogenen Inhalten

Die Gesetzgebung zu Deepfakes im Wahlkontext bleibt 2026 ein zentrales Anliegen. Im vergangenen Jahr haben mehrere Bundesstaaten Gesetzentwürfe eingeführt, die darauf abzielen, KI-generierte politische Inhalte zu kontrollieren. Diese Gesetze schränken jedoch oft die wesentliche politische Rede ein, und die Gerichte haben gut etablierte Rechtsprechung zum Ersten Verfassungszusatz angewendet, um sie für verfassungswidrig zu erklären.

Regulierungen für Chatbots

Eine wachsende Kategorie von Gesetzen versucht, „Chatbots“ oder konversationale KI einzuschränken, indem sie Rahmenbedingungen aus den Gesetzen für soziale Medien übernimmt. Dazu gehören allgemeine Warnanforderungen, die den Nutzern mitteilen, dass sie mit KI interagieren, und viele gewöhnliche, risikoarme Interaktionen einbeziehen, bei denen keine Warnung erforderlich ist. Einige Vorschläge würden Chatbots kategorisch verbieten, emotionalen Support zu bieten, was eine direkte und unbestimmte Regulierung des Tons und Inhalts von KI-generierten Antworten zur Folge hätte.

Folgen und Risiken

Diese Arten von Einschränkungen stellen die Regierung zwischen die Menschen und die Informationen, auf die sie ein verfassungsmäßig geschütztes Recht haben. Sie zensieren rechtmäßigen Ausdruck und belasten das Recht zu sprechen und anonym zuzuhören. Aus diesem Grund haben Gerichte ähnliche Beschränkungen, die auf soziale Mediennutzer und -plattformen angewendet werden, wiederholt blockiert.

Umfassende KI-Regulierungsentwürfe sind auch in diesem Jahr zurückgekehrt, wobei mindestens ein Bundesstaat bisher einen solchen Vorschlag in diesem Zyklus eingeführt hat. Diese Gesetzentwürfe, die in mehreren Bundesstaaten 2025 eingeführt wurden, gehen weit über enge Anwendungsfälle hinaus und versuchen, umfassende regulatorische Rahmenbedingungen für KI-Entwickler, -Nutzer und -Anwender durch weitreichende staatliche Aufsicht und umfassende Haftung für die Drittbenutzung von KI-Tools zu schaffen.

Fazit

Es ist wichtig, legitime gesetzgeberische Ziele wie den Schutz vor Betrug, Diskriminierung und Wahlbeeinflussung zu verfolgen. Allerdings haben Erfahrungen gezeigt, dass umfassende, vage und präventive Regulierung von Ausdruckswerkzeugen oft rechtmäßige Reden einschränkt, ohne Fehlverhalten effektiv zu bekämpfen. Anstatt politische Rede zu zielen oder Altersgrenzen für Ausdruckswerkzeuge aufzuerlegen, sollten Regierungsbeamte mit den bereits vorhandenen rechtlichen Mitteln beginnen.