6 Cybersecurity-Trends, die Governance und KI-Akzeptanz im Jahr 2026 prägen

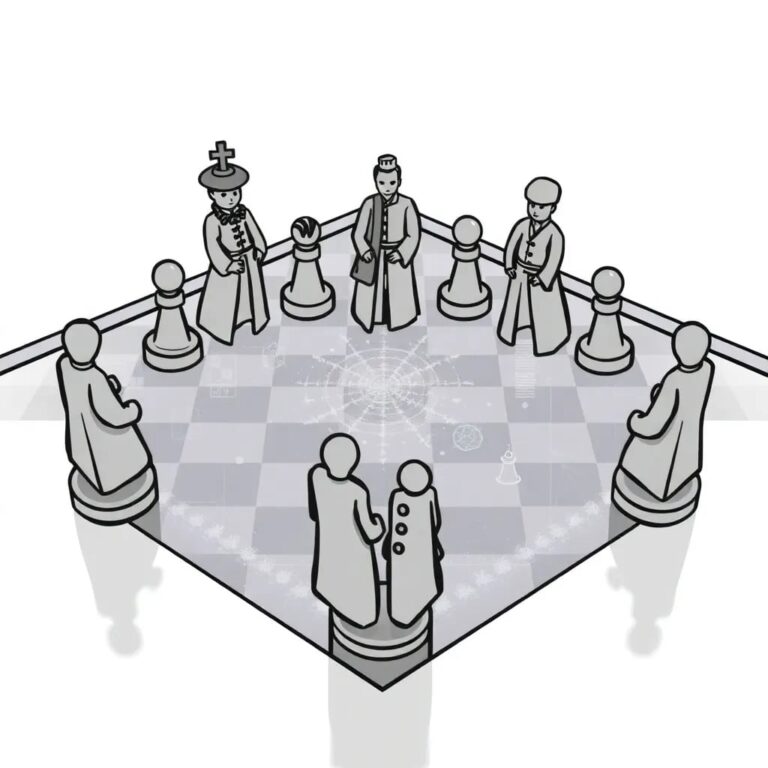

Der rasante Anstieg von KI, eskalierende geopolitische Spannungen, regulatorische Unsicherheiten und eine zunehmend komplexe Bedrohungslandschaft verändern die Cybersecurity-Trends für 2026. Diese Entwicklungen stellen Cybersecurity-Führungskräfte vor neue Herausforderungen und erfordern innovative Ansätze für das Management von Cyberrisiken, Resilienz und Ressourcenzuteilung.

Agentic AI erfordert Cybersecurity-Überwachung

Die rasante Adoption von Agentic AI durch Mitarbeiter und Entwickler eröffnet neue Angriffsflächen. Die Zunahme von No-Code- und Low-Code-Tools sowie von Vibe-Coding beschleunigt diesen Wandel und führt zu einer Verbreitung von unmanaged AI-Agenten, unsicherem Code und erhöhten Compliance-Risiken. Starke Governance bleibt unerlässlich, um sowohl genehmigte als auch nicht genehmigte AI-Agenten zu identifizieren und robuste Kontrollen zu implementieren.

Postquantum-Computing in Aktionsplänen

Es wird prognostiziert, dass Fortschritte im Quantencomputing die asymmetrische Kryptografie, auf die Organisationen zur Absicherung ihrer Daten angewiesen sind, bis 2030 unsicher machen werden. Alternativen zur Postquantum-Kryptografie müssen jetzt angenommen werden, um potenziellen Datenverletzungen und finanziellen Verlusten vorzubeugen. Diese Entwicklungen zwingen Organisationen, traditionelle Verschlüsselungsmethoden zu identifizieren, zu verwalten und zu ersetzen.

Identitäts- und Zugriffsmanagement passt sich AI-Agenten an

Die Zunahme von AI-Agenten bringt neue Herausforderungen für traditionelle Strategien im Identitäts- und Zugriffsmanagement (IAM) mit sich. Eine gezielte, risikobasierte Strategie ist erforderlich, um in Bereichen mit den größten Lücken und Risiken zu investieren und gleichzeitig Automatisierung zu nutzen. Dies ist entscheidend für die Sicherstellung von Innovation, Compliance und den Schutz kritischer Vermögenswerte in AI-zentrierten Umgebungen.

KI-gesteuerte SOC-Lösungen destabilisieren betriebliche Normen

Die Einführung von KI-unterstützten Sicherheitsoperationen (SOCs) führt zu zusätzlicher Komplexität. Während diese Technologien die Alarmtriage und Ermittlungsabläufe verbessern, erhöhen sie gleichzeitig den Druck auf das Personal und erfordern eine Umgestaltung der Kostenstrukturen. Um das volle Potenzial von KI in Sicherheitsoperationen auszuschöpfen, müssen Cybersecurity-Führungskräfte die Mitarbeiterentwicklung priorisieren.

GenAI verändert traditionelle Cybersecurity-Bewusstseinstaktiken

Bestehende Sicherheitsbewusstseinsmaßnahmen versagen weiterhin darin, Cybersecurity-Risiken zu reduzieren, während die Akzeptanz von GenAI zunimmt. Eine Umstellung von allgemeinen Schulungen auf adaptive Verhaltens- und Trainingsprogramme, die AI-spezifische Aufgaben beinhalten, wird empfohlen. Dies wird helfen, die Exposition gegenüber Datenschutzverletzungen und Verlust von geistigem Eigentum zu reduzieren.