AI-Industrieplayer versprechen Compliance nach Enthüllungen über ‚Datenvergiftung‘

Nach der jährlichen Verbraucherrechts-Gala, die die sogenannte „AI-Vergiftung“ durch eine kommerzielle Technik namens generative Engine-Optimierung (GEO) ins Rampenlicht rückte, gaben einige Start-up-Unternehmen in der GEO-Branche am Montag Erklärungen ab und versicherten ihre öffentliche Compliance in der KI-Optimierung.

Überblick über die GEO-Technik

Berichten zufolge haben einige Anbieter von GEO-Diensten ihren Kunden versprochen, dass ihre Produkte gegen Gebühr häufig in den KI-generierten Antworten erscheinen können – sogar falsche Werbeinhalte als „Standardantworten“ präsentieren können.

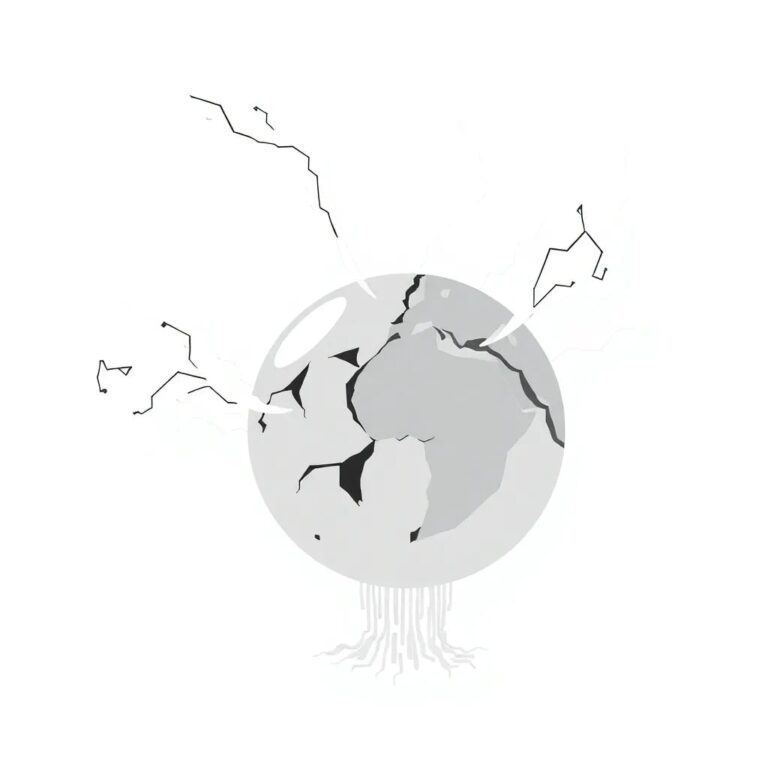

Die Gala deckte Aktivitäten wie die Generierung falscher Informationen, Datenvergiftung durch KI, Manipulation von Rankings und böswillige Wettbewerbspraktiken auf, die durch GEO verursacht werden und als wachsende Bedrohung für die Integrität großer KI-Modelle angesehen werden.

Erklärungen der Unternehmen

Ein Unternehmen in der Branche gab eine Erklärung ab, in der es betonte, dass sein Produkt den Grundsatz „Technologie für das Gute, Compliance zuerst“ einhält. Es wurde versichert, dass sie strikt die Kontrolle über Inhalte überwachen und die Verwendung von digitalen Marketingtechniken oder gefälschtem Traffic zur Verbesserung von Rankings ablehnen.

Ein weiteres Unternehmen veröffentlichte ebenfalls eine Notfallmitteilung, in der es jede Form von falscher Werbung und Datenfälschung ablehnte. Es wurde erklärt, dass sie nicht an den beschriebenen Praktiken teilnehmen oder solche Dienstleistungen anbieten.

Risiken der Datenvergiftung

GEO-Tools, ursprünglich entwickelt zur Optimierung der Informationsverbreitung, können missbraucht werden. Experten definieren „AI-Vergiftung“ als das absichtliche Einspeisen von gefälschten Informationen in das Informationsökosystem, sodass KI-Systeme diese falschen Informationen lernen und reproduzieren.

Solche Praktiken könnten die Rechte der Verbraucher auf informierte Entscheidungen verletzen und möglicherweise gegen Werberegulierungen verstoßen. Wenn diese Praktiken nicht kontrolliert werden, besteht das Risiko, dass sie den Wettbewerb auf dem Markt verzerren und das öffentliche Vertrauen in KI als zuverlässige Informationsquelle untergraben.

Fazit

Die Trainingdaten großer chinesischer Modelle stammen hauptsächlich aus dem chinesischen Internet. Die Lösung dieses Problems erfordert gemeinsame Anstrengungen mehrerer Parteien. Behörden sollten aktiv die Qualität der Internetinformationen verbessern und das Angebot an objektiven, neutralen und wissenschaftlichen Informationen erhöhen.

Im Januar wurde die KI-generierte Werbung als eine der zentralen Herausforderungen für die Regulierung von Internetwerbung identifiziert, was eine verstärkte Aufsicht und Verwaltung dieser Praktiken fordert.