Le Royaume-Uni et l’UE : Comment résoudre un problème comme Grok ?

Le 3 février, le bureau du commissaire à l’information du Royaume-Uni a ouvert une enquête formelle sur xAI concernant le traitement des données personnelles dans la création d’images sexualisées non consensuelles par Grok. Le bureau évalue si Grok a respecté la législation britannique sur la protection des données. Si xAI est reconnu coupable d’avoir traité des données personnelles de manière illégale, le bureau pourra imposer une amende pouvant atteindre 17,5 millions de livres sterling ou 4 % du chiffre d’affaires mondial annuel de xAI (selon ce qui est le plus élevé) en vertu de la loi sur la protection des données de 2018 et du RGPD britannique.

Cela fait suite à l’ouverture d’une enquête par Ofcom en vertu de la loi sur la sécurité en ligne de 2023, qui criminalise le partage d’images intimes générées par deepfake sans consentement. Une autre loi, la loi sur les données (utilisation et accès) de 2025, rend également illégal de créer ou de demander du contenu deepfake d’adultes au Royaume-Uni, mais n’interdit pas encore de fournir la technologie permettant de créer des deepfakes, bien que le gouvernement travailliste envisage d’amender la loi.

Cette enquête sur la conformité de Grok avec la législation britannique sur la protection des données fait suite à une perquisition des bureaux de X à Paris par les procureurs français du bureau de la cybercriminalité le même jour, et à l’ouverture d’une enquête formelle par la Commission européenne sur X en vertu de la loi sur les services numériques pour évaluer si l’entreprise a atténué les « risques systémiques » liés à Grok, y compris la diffusion de contenu illégal et la violence basée sur le genre.

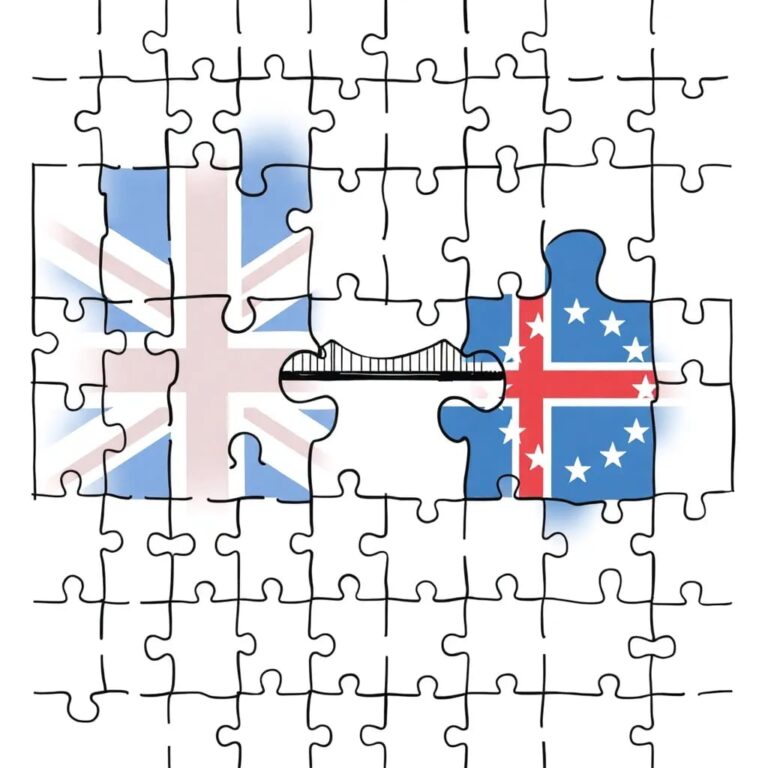

Différences entre les approches britannique et européenne

L’action d’exécution contre Grok montre la différence de focalisation entre les régimes britanniques et européens de protection des données et de sécurité en ligne. L’approche britannique, typique d’une juridiction de common law, se concentre sur l’adresse de préjudices spécifiques, tandis que l’approche européenne vise à établir un cadre préventif pour la gestion des risques systémiques. Ces approches montreront leur valeur à différents stades du développement d’une nouvelle technologie, avec l’approche de common law capable de répondre plus rapidement à la vitesse actuelle du développement de l’IA, tandis que le potentiel d’un système réglementaire européen de prévenir les préjudices est temporairement affaibli par le désir de l’Europe de ne pas être laissée pour compte dans la course à l’IA.

Un régime réglementaire européen de haut en bas est conçu pour habiliter un exécutif politique agissant au nom du public votant contre une classe industrielle agissant dans l’intérêt du capital privé. Le principal problème de l’Europe est qu’elle ne dispose pas d’une classe industrielle importante (au moins dans le secteur informatique), mais elle possède un large marché de consommateurs. Les législateurs européens ont traditionnellement tenté de tirer parti du pouvoir d’achat du marché de consommateurs de l’UE pour établir des normes réglementaires mondiales.

Défis réglementaires et temporisation

L’effet Bruxelles a bien fonctionné pour traiter les préoccupations en matière de protection des données à l’ère du « capitalisme de surveillance », mais il peine à suivre le rythme du développement de l’IA. Cela a conduit la Commission européenne à présenter la proposition de réglementation « Digital Omnibus » en novembre 2025, visant à retarder l’adoption de certaines parties de la loi sur l’IA concernant l’identification biométrique jusqu’en décembre 2027, et à modifier le RGPD pour permettre l’entraînement de modèles d’IA sur des données européennes, dans un mouvement largement perçu comme une poussée vers la déréglementation.

La loi sur l’IA de l’UE impose des règles de transparence pour le contenu produit par l’IA générative, stipulant que ce contenu doit être marqué de manière lisible par machine. Ces règles devaient initialement entrer en vigueur en août 2026, mais la Commission a proposé de retarder leur mise en œuvre jusqu’en 2027. Actuellement, le Royaume-Uni n’a aucune législation exigeant des marques d’eau pour les images générées par IA, bien qu’une consultation gouvernementale de 2024 sur les droits d’auteur et l’IA ait reconnu les avantages de l’étiquetage de l’IA.

Réactions rapides et enforcement

Les actions de l’ICO et d’Ofcom ont été rapides concernant le problème des deepfakes, l’ICO ciblant xAI (le développeur de technologie) ainsi que X (la plateforme/distributeur), montrant une exécution à différents niveaux du cycle de données. Le Royaume-Uni, en raison de son héritage de common law, est peut-être plus agile pour répondre à des cas spécifiques de préjudice en ligne, tandis que le système de l’UE fournit une meilleure structure pour faire respecter des normes uniformes contre de grandes entreprises à long terme.

Les deux systèmes, avec leurs différentes focalisations, peuvent ensemble fournir un moyen complet d’appliquer des normes partagées et de protéger les droits des individus contre les grandes entreprises, mais le défi clé réside dans la coordination après le Brexit.

Conclusion

Les approches du Royaume-Uni et de l’UE en matière d’application suivent des lignes généralement similaires dans une gamme de domaines, pas seulement la protection des données. En résumé, l’approche britannique résout un problème spécifique au fur et à mesure qu’il se présente, tandis que l’approche de l’UE cherche à accroître l’influence de la Commission européenne à long terme. Chacune de ces approches présente des avantages, et les deux peuvent être utilisées de manière complémentaire pour tenir les grandes entreprises responsables.