AI Hallucinations, Sanctions et Contexte : Ce qu’un Cas Disciplinaire en Floride Enseigne Réellement

Il est indéniable que l’intelligence artificielle offre désormais des avantages considérables pour le travail juridique de haut niveau. Depuis la disponibilité généralisée de l’IA générative, les chercheurs juridiques, les technologues et les développeurs de produits ont démontré comment ces outils, s’ils sont utilisés correctement, peuvent améliorer les performances humaines. L’IA excelle dans l’accès, l’organisation et le traitement de volumes d’informations énormes ; les avocats et les juges apportent leur jugement, leur expérience, leur empathie et leur responsabilité éthique. Utilisés ensemble, cette combinaison peut être extraordinairement efficace.

Cependant, trop de professionnels occupés ont omis une vérité évidente et impitoyable : l’IA peut se tromper ; l’utilisateur humain reste entièrement responsable ; et la vérification n’est pas optionnelle. Les avocats responsables doivent vérifier chaque citation et assertion dans une déposition devant le tribunal contre des sources originales et autoritaires. Il n’y a pas de raccourci à cette obligation.

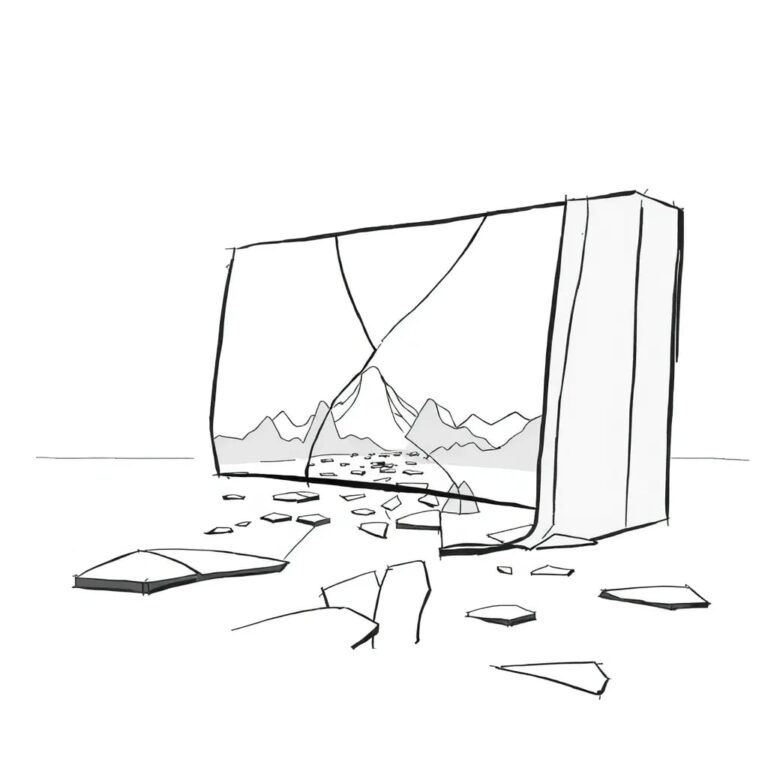

Le non-respect de cette discipline de base a produit un nombre croissant de cas impliquant des "hallucinations" de l’IA, c’est-à-dire des citations et des assertions fabriquées ou inexactes apparaissant dans les soumissions judiciaires. Malgré la notoriété générale, les avertissements judiciaires, les conseils éthiques et les sanctions, le problème n’a pas diminué.

Une base de données maintenue publiquement qui suit les décisions judiciaires impliquant des hallucinations générées par l’IA rapporte plus de 500 de tels cas dans les tribunaux des États-Unis à l’heure actuelle. Les tribunaux, face à des violations répétées, ont intensifié les sanctions pour tenter de dissuader ce comportement. Ce qui a commencé par des avertissements, des réprimandes et des pénalités monétaires a, dans certains cas, progressé vers la disqualification de la représentation, la divulgation obligatoire des ordres de sanctions aux clients et aux tribunaux, et des renvois aux autorités disciplinaires du barreau.

Contexte du Cas : Ce que Neusom Est — et Ce qu’il N’est Pas

Le cas de discipline de l’Ordre des avocats de Floride contre un avocat n’est pas un exemple clair d’une erreur isolée d’IA entraînant une suspension. L’ordre de la Cour suprême de Floride est bref et largement procédural ; la plainte du barreau et le rapport du juge rapporteur fournissent les conclusions substantielles. Ces documents décrivent un avocat qui a ignoré à plusieurs reprises des ordres judiciaires, a réaffirmé des arguments déjà rejetés par le tribunal, a déformé l’autorité légale, et n’a pas corrigé les citations fabriquées même après que les déficiences aient été identifiées par l’avocat adverse.

Les citations hallucinations dans ce cas corroborent une conduite plus large ; elles ne la définissent pas. Le dossier révèle un modèle soutenu de conduite incorrecte. En plus des citations inexactes et fabriquées, le juge rapporteur a constaté des violations répétées des règles locales, un étiquetage incorrect des dépôts, des tentatives inappropriées de relitiger des questions de compétence, le dépôt d’une demande de faillite de mauvaise foi dans le seul but d’éviter une expulsion, et un manquement à se présenter à l’audience disciplinaire.

Conséquences Inattendues : Alphabétisation en IA, Dissuasion et Risque de Surexcitation

Il existe une raison pour laquelle les associations du barreau publient des résumés des cas disciplinaires. Ils remplissent une fonction importante en rappelant aux avocats leurs obligations professionnelles, en identifiant les comportements qui tombent en dessous des normes éthiques et en promouvant l’éducation et la dissuasion. Cependant, pour que ces efforts réussissent, le message éducatif doit refléter avec précision la nature de la faute en question.

Les juges et les organes de sanction fonctionnent sous un mandat différent. Les sanctions doivent correspondre au cas, ancrées dans l’équité et la proportionalité. Les décisions disciplinaires nécessitent une calibration et une différenciation, avec des résultats ancrés dans des conclusions spécifiques d’intention, de degré de culpabilité, et de préjudice réel ou potentiel. Lorsque le comportement sanctionné est mentionné sans contexte, le risque n’est pas sous-application, mais surcorrection.

Conclusion

L’augmentation des hallucinations générées par l’IA dans les dépôts judiciaires représente un défi réel et sérieux pour la profession juridique. Les tribunaux et les autorités disciplinaires ont raison de répondre fermement à des comportements qui compromettent la franchise, la compétence et l’intégrité du processus judiciaire. Les sanctions demeurent un outil essentiel de dissuasion et de correction.

Cependant, la discipline fonctionne mieux lorsqu’elle est ancrée dans le contexte et la culpabilité. Cela illustre comment les erreurs liées à l’IA peuvent corroborer une faute plus large. Les traiter autrement risque d’entraîner une escalade axée sur les résultats, détachée de l’intention, de la proportionalité et des normes disciplinaires de longue date.