Échapper au piège des solutions ponctuelles : pourquoi la pensée systémique est le lien manquant dans la gouvernance de l’IA

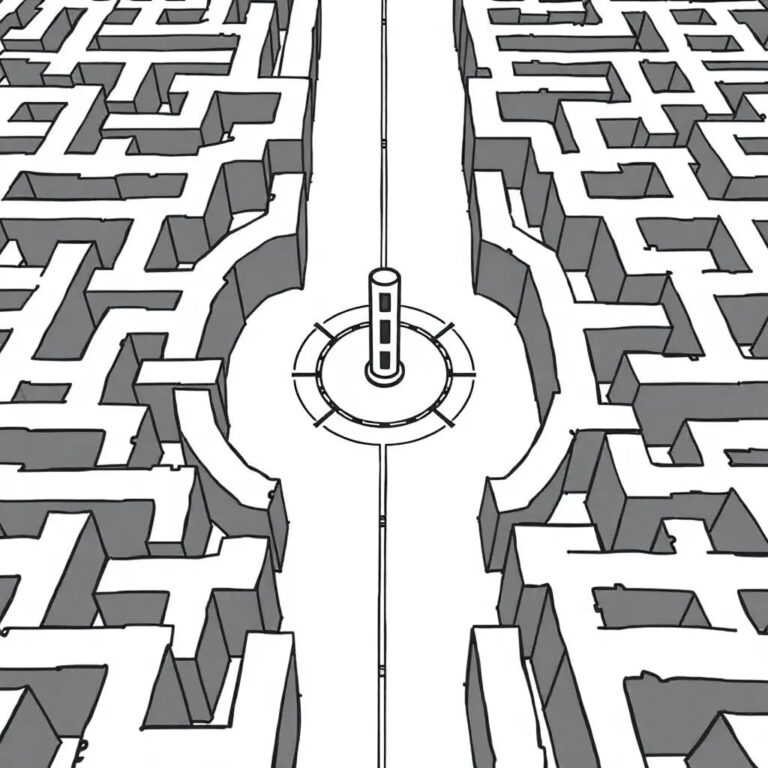

Au cœur du défi de la gouvernance de l’IA se trouve non pas un problème technologique, mais la compréhension de l’interaction complexe entre le comportement humain, les structures organisationnelles et les capacités émergentes de l’IA. Trop souvent, les efforts se concentrent sur un aspect isolé du problème, une « solution ponctuelle » qui ne parvient pas à traiter les problèmes systémiques sous-jacents.

Cette approche, bien intentionnée, est comparable à traiter un symptôme sans s’attaquer à la maladie. Les systèmes d’IA n’existent pas dans un vide ; ils sont intégrés dans des écosystèmes complexes de personnes, de processus et de technologies existantes. Pour les gouverner efficacement, nous devons adopter une approche de pensée systémique qui reconnaît et traite ces interdépendances.

Les pièges des solutions ponctuelles

Considérons les approches courantes de la gouvernance de l’IA :

- Sauvegardes techniques : La mise en œuvre d’algorithmes éthiques, de détection de biais et d’outils d’explicabilité. Bien que cruciaux, ceux-ci peuvent être contournés ou devenir obsolètes à mesure que l’IA évolue.

- Politique et réglementation : Le développement de lois et de directives pour l’utilisation de l’IA. Celles-ci s’adaptent souvent lentement aux avancées technologiques rapides et peuvent être difficiles à appliquer à l’échelle mondiale.

- Formation et éducation : Équiper les individus d’une culture de l’IA et d’une conscience éthique. Cela est vital mais insuffisant si les structures organisationnelles et les incitations ne soutiennent pas le déploiement responsable de l’IA.

Chacune de ces approches constitue une pièce précieuse du puzzle, mais en tant que solution autonome, elle est incomplète. Par exemple, un outil de détection de biais peut signaler un problème, mais si les pratiques de collecte de données sous-jacentes, les biais humains dans l’interprétation ou les pressions commerciales restent non résolus, le problème risque de réapparaître sous une autre forme.

La puissance de la pensée systémique

La pensée systémique offre un cadre plus holistique et efficace pour la gouvernance de l’IA. Elle implique :

- Comprendre les interconnexions : Reconnaître comment les différents composants de l’écosystème de l’IA s’influencent mutuellement. Cela signifie aller au-delà de l’algorithme pour considérer les pipelines de données, les opérateurs humains, les utilisateurs finaux et les impacts sociétaux.

- Identifier les boucles de rétroaction : Observer comment les actions au sein du système créent des cycles de renforcement ou de correction. Par exemple, un système d’IA mal conçu pourrait entraîner de la frustration chez les utilisateurs, ce qui pourrait à son tour générer des données plus négatives, dégradant encore la performance de l’IA.

- Se concentrer sur les propriétés émergentes : Comprendre que le comportement du système global peut être plus que la somme de ses parties. Les considérations éthiques, par exemple, ne concernent pas seulement les composants individuels de l’IA, mais la manière dont ils façonnent collectivement les résultats.

Appliquer la pensée systémique à la gouvernance de l’IA

Pour mettre en œuvre la pensée systémique dans la gouvernance de l’IA, les organisations devraient :

- Cartographier l’écosystème : Visualiser tous les acteurs, processus et technologies impliqués dans le cycle de vie de l’IA, depuis le développement jusqu’au déploiement et à la surveillance.

- Réaliser des évaluations d’impact : Évaluer les conséquences sociales, éthiques et économiques potentielles des systèmes d’IA dans l’ensemble de l’écosystème, et non seulement selon des paramètres techniques isolés.

- Favoriser la collaboration interfonctionnelle : Rassembler des équipes diversifiées — ingénieurs, éthiciens, décideurs politiques, experts juridiques, scientifiques sociaux et chefs d’entreprise — pour garantir une compréhension complète des défis et des solutions.

- Adopter l’itération et l’adaptation : Concevoir des cadres de gouvernance flexibles qui peuvent évoluer avec la technologie de l’IA et son intégration sociétale. Cela inclut une surveillance continue et un apprentissage à partir des performances du système.

Conclusion

Le chemin vers une gouvernance efficace de l’IA nécessite un changement fondamental, passant de la résolution de problèmes isolés à la compréhension et à la gestion des complexités de l’ensemble du système d’IA. En adoptant la pensée systémique, les organisations peuvent dépasser les limites des solutions ponctuelles et construire des cadres d’IA qui sont non seulement technologiquement solides mais aussi éthiquement robustes et socialement responsables. Cette perspective holistique n’est pas seulement une meilleure pratique ; elle est le lien manquant pour établir la confiance et garantir l’intégration bénéfique de l’IA dans notre monde.