Introduction

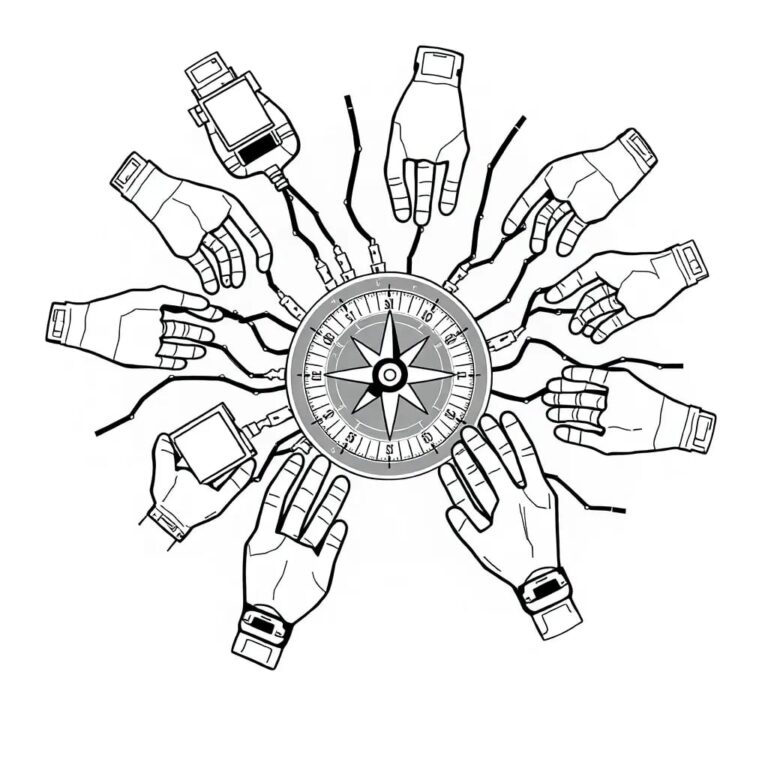

La concurrence entre les laboratoires d’intelligence artificielle crée une dynamique où la sécurité est souvent sacrifiée au profit de la rapidité. Cette pression conduit à un problème d’action collective : chaque laboratoire hésite à investir dans la sécurité tant que ses concurrents ne le font pas.

Analyse du modèle d’autorégulation

Origine du modèle

Depuis près d’un siècle, le secteur financier utilise des organisations d’autorégulation supervisées (SRO) pour concilier expertise industrielle et contrôle public. Ce modèle repose sur des règles contraignantes approuvées par le gouvernement et une supervision officielle.

Application au secteur de l’IA

Un cadre similaire pourrait être adopté pour l’IA, en créant une entité chargée d’établir des normes de sécurité, de les faire appliquer et d’ajuster les exigences en temps réel. Le financement viendrait des frais payés par les laboratoires, évitant ainsi les dépendances budgétaires publiques.

Implications et risques

Problèmes de concurrence

Sans coordination, les laboratoires continuent de « courir vers le bas » en matière de sécurité. Une autorégulation obligatoire neutraliserait cet effet en imposant les mêmes exigences à tous les acteurs.

Asymétrie d’information

Les détails techniques des modèles d’IA sont souvent confidentiels, créant une asymétrie d’information entre les développeurs et les régulateurs. Une SRO dotée d’un accès sécurisé à ces données réduirait cet écart.

Problème de rapidité législative

Les lois évoluent plus lentement que les technologies. Un organisme autorégulateur capable de mettre à jour rapidement ses règles offrirait une réponse adaptée aux avancées rapides de l’IA.

Risques catastrophiques

Les conséquences potentielles d’un déploiement imprudent peuvent être irréversibles. Une supervision proactive, incluant des évaluations pré‑déploiement et des mécanismes d’arrêt, est essentielle pour prévenir de tels scénarios.

Conclusion

Adopter un modèle d’autorégulation supervisée permettrait de concilier l’innovation rapide de l’intelligence artificielle avec la nécessité d’une sécurité robuste. En imposant des normes uniformes, en assurant la transparence et en offrant une flexibilité réglementaire, ce cadre pourrait atténuer les risques liés à la concurrence, à l’opacité technique et à la lenteur législative, tout en favorisant un développement responsable de l’IA.