Une nouvelle année, une nouvelle session de sur-régulation de l’IA

Alors que les législateurs entament la session législative de 2026, une nouvelle phase importante dans la conversation sur la liberté d’expression et l’intelligence artificielle se dessine déjà dans les assemblées législatives à travers le pays. Une nouvelle série de projets de loi sur l’IA est prête à dicter comment les gens utilisent les machines pour communiquer, soulevant des questions constitutionnelles fondamentales sur la liberté d’expression.

La protection du Premier Amendement

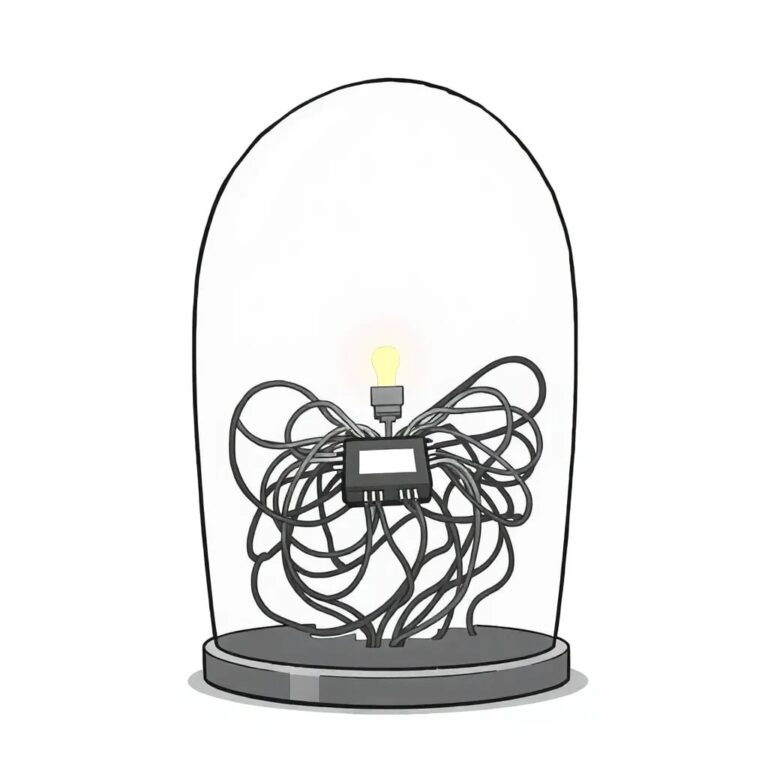

Le Premier Amendement s’applique à l’intelligence artificielle de la même manière qu’il s’applique aux technologies d’expression antérieures. Comme la presse, la caméra, Internet et les médias sociaux, l’IA est un outil que les gens utilisent pour communiquer des idées, accéder à l’information et générer des connaissances. Peu importe le support utilisé, notre Constitution protège ces formes d’expression.

Les préoccupations concernant les projets de loi sur l’IA

Alors que les législateurs révisent la politique sur l’IA en 2026, il est important de rappeler que la législation existante traite déjà de nombreux préjudices qu’ils cherchent à aborder — fraude, contrefaçon, diffamation, discrimination et interférence électorale — que l’IA soit utilisée ou non. La fraude reste de la fraude, que l’on utilise un stylo ou un clavier, car la responsabilité revient à la personne qui commet des actes illégaux.

De nombreux projets de loi sur l’IA introduits ou attendus cette année s’appuient sur des approches réglementaires qui soulèvent de sérieuses préoccupations concernant le Premier Amendement. Certains exigeraient que les développeurs ou les utilisateurs ajoutent des avertissements ou des étiquettes aux expressions générées par l’IA, les forçant à servir de porte-parole du gouvernement pour des opinions qu’ils ne partagent peut-être pas.

Les lois sur les deepfakes liés aux élections

La législation concernant les deepfakes liés aux élections reste un point central en 2026. Au cours de l’année écoulée, plusieurs États ont introduit des projets de loi visant à contrôler le contenu politique généré par l’IA. Mais ces lois restreignent souvent le discours politique central, et les tribunaux ont appliqué une jurisprudence bien établie du Premier Amendement pour les déclarer inconstitutionnelles.

Les chatbots et la régulation

Une autre catégorie de législation en croissance vise à restreindre les « chatbots », ou l’IA conversationnelle, en utilisant des cadres empruntés aux lois sur les médias sociaux. Cela inclut des exigences d’avertissement généralisées informant les utilisateurs qu’ils interagissent avec une IA, ce qui englobe de nombreuses interactions ordinaires à faible risque où aucun avertissement n’est nécessaire. D’autres propositions interdisent catégoriquement aux chatbots d’être formés pour fournir un soutien émotionnel aux utilisateurs, imposant une réglementation directe sur le ton et le contenu des réponses générées par l’IA.

Les implications de la régulation excessive

Ces types de contraintes placent le gouvernement entre les gens et les informations auxquelles ils ont le droit d’accéder constitutionnellement. Ils censurent l’expression légale et entravent le droit de parler et d’écouter de manière anonyme. Pour cette raison, les tribunaux ont régulièrement bloqué des restrictions similaires lorsqu’elles ont été appliquées aux utilisateurs et plateformes de médias sociaux.

Des projets de loi réglementaires larges et globaux concernant l’IA ont également fait leur retour cette année, avec au moins un État ayant introduit une telle proposition jusqu’à présent. Ces projets de loi, qui ont été introduits dans plusieurs États en 2025, vont bien au-delà de cas d’utilisation étroits et cherchent à imposer des cadres réglementaires étendus aux développeurs, utilisateurs et déployeurs d’IA par le biais d’une surveillance gouvernementale expansive.

Conclusion

Aborder des préjudices réels, tels que la fraude, la discrimination et l’interférence électorale, peut être un objectif législatif légitime. Cependant, une réglementation expansive et vague des outils d’expression risque souvent de freiner l’expression légale sans cibler efficacement les inconduites. Les autorités devraient commencer par utiliser les outils juridiques déjà disponibles pour répondre aux comportements illégaux, sans alourdir l’expression protégée ou l’innovation.