Bannir la Réglementation de l’IA Serait un Désastre

Le lundi, une annonce a été faite concernant un projet d’ordre exécutif interdisant aux États de réglementer l’IA. Les partisans de cette préemption de l’IA associent la compétitivité à la déréglementation, arguant que des garde-fous au niveau des États entravent l’innovation et affaiblissent le pays dans sa compétition technologique.

Les Risques de la Déréglementation

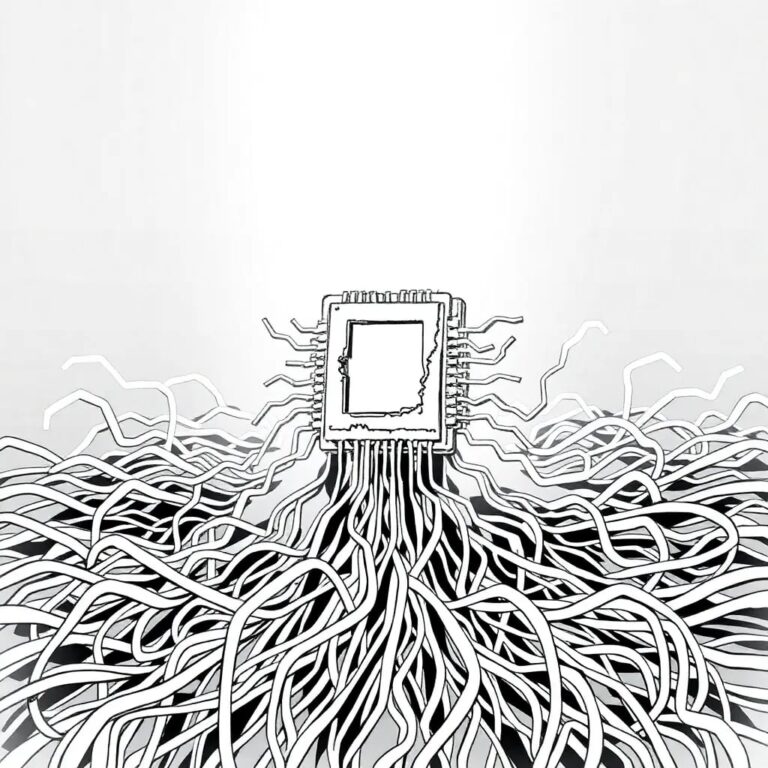

En réalité, les vulnérabilités les plus graves en matière de sécurité nationale liées à l’IA proviennent non pas d’une supervision excessive, mais d’un manque d’encadrement. Les systèmes d’IA soutiennent déjà des fonctions essentielles de l’économie, comme la gestion des aéroports, la prévision des réseaux énergétiques et les systèmes de détection de fraude. Ces systèmes créent des avantages opérationnels extraordinaires, mais ils présentent également des points de défaillance concentrés et à fort impact.

Chaque point de défaillance est une cible attractive. Les adversaires savent que lorsque des infrastructures cruciales dépendent d’algorithmes opaques et non réglementés, une seule sortie manipulée peut provoquer des pannes d’électricité, déstabiliser les marchés financiers ou dégrader la préparation militaire de manière difficile à détecter en temps réel.

Campagnes de Désinformation et Cyber Conflits

Les acteurs malveillants conduisent déjà des campagnes de désinformation et de guerre cognitive, utilisant des narrations fausses pour influencer les élections et éroder la confiance civique. Ces campagnes prospèrent sur les lacunes créées par des tests incohérents et l’absence de normes de sécurité applicables.

Récemment, des attaques cybernétiques actives ont été menées à l’aide de logiciels malveillants alimentés par l’IA, illustrant le passage de l’influence vers des conflits cybernétiques actifs.

La Nécessité d’une Réglementation Appropriée

Les grandes entreprises technologiques dépensent des sommes considérables pour éviter ou renverser les garde-fous qui préviennent les dommages prévisibles. Leur stratégie consiste à sécuriser une préemption fédérale large qui immobilise les États, puis à retarder et affaiblir une réglementation significative au niveau fédéral.

Cette approche est tragiquement myope. Contrairement à la narration promue par un petit nombre d’entreprises dominantes, la réglementation ne doit pas ralentir l’innovation. Des règles claires favoriseraient la croissance en durcissant les systèmes contre les attaques et en garantissant que les modèles intégrés dans les systèmes de défense et les plateformes publiques soient robustes avant leur déploiement à grande échelle.

Conclusion

La solution aux risques de l’IA n’est pas de démanteler la supervision, mais de concevoir la bonne supervision. Le leadership américain en intelligence artificielle ne sera pas assuré en affaiblissant les rares garde-fous existants, mais plutôt par des règles sérieuses conçues pour résister aux véritables adversaires opérant dans le monde réel.