Apprendre des Échecs Collectifs : Une Réflexion Avant le Sommet sur la Gouvernance de l’IA

À l’approche du Sommet Numérique 2025 à Tallinn, une visite au Musée en Plein Air Estonien met en lumière des parallèles troublants entre les échecs d’une planification collective imposée et les systèmes d’IA d’aujourd’hui. Ces blocs d’appartements en béton, héritage de l’occupation soviétique, servent d’avertissement sur les conséquences de la standardisation au détriment de l’adaptabilité.

La Promesse et l’Échec des Kolkhozes

Les kolkhozes, collectifs agricoles mandatés par le régime soviétique, promettaient prospérité partagée à travers des économies d’échelle. Cependant, la réalité a engendré une inefficacité chronique et des pénuries alimentaires, en supprimant les connaissances locales qui soutenaient depuis longtemps les communautés agricoles. L’échec résidait non pas dans le collectivisme en tant que concept, mais dans le modèle rigide imposé à travers des géographies et cultures diverses.

Le Parallèle avec l’IA : Optimisation pour la Majorité

Les systèmes d’IA d’aujourd’hui rencontrent un défi structurel similaire. Les modèles de langage et de vision par ordinateur sont formés sur d’énormes ensembles de données, optimisant les motifs les plus courants. Cela produit de bonnes performances pour les cas d’utilisation principaux, mais sous-performe de manière constante pour les langues minoritaires et les contextes non occidentaux. Ce problème de gouvernance a des impacts réels.

Des outils de recrutement alimentés par l’IA, formés principalement sur des données historiques provenant d’entreprises technologiques occidentales, risquent d’exclure des candidats qualifiés issus de parcours non traditionnels. De même, les systèmes médicaux d’IA, formés sur des données provenant d’hôpitaux occidentaux, peuvent négliger des manifestations de maladies communes dans d’autres populations.

Au-Delà des Audits de Biais : Solutions Structurelles

La réponse habituelle – audits de biais et réentraînement sur des ensembles de données plus diversifiés – est importante mais insuffisante. Ces efforts ne traitent pas les défauts de conception systémiques. Les blocs d’appartements kolkhozes suggèrent une leçon plus profonde : lorsque l’infrastructure échoue, les résidents formaient souvent des comités de base pour plaider en faveur du changement.

La gouvernance de l’IA nécessite des mécanismes similaires : non seulement des données diverses, mais aussi des décideurs divers et habilités. Cela implique :

- Intégrer les parties prenantes tout au long du cycle de développement, et non simplement les consulter après le déploiement.

- Établir des boucles de rétroaction avec un réel pouvoir. Les rapports d’échecs de l’IA devraient déclencher des examens obligatoires.

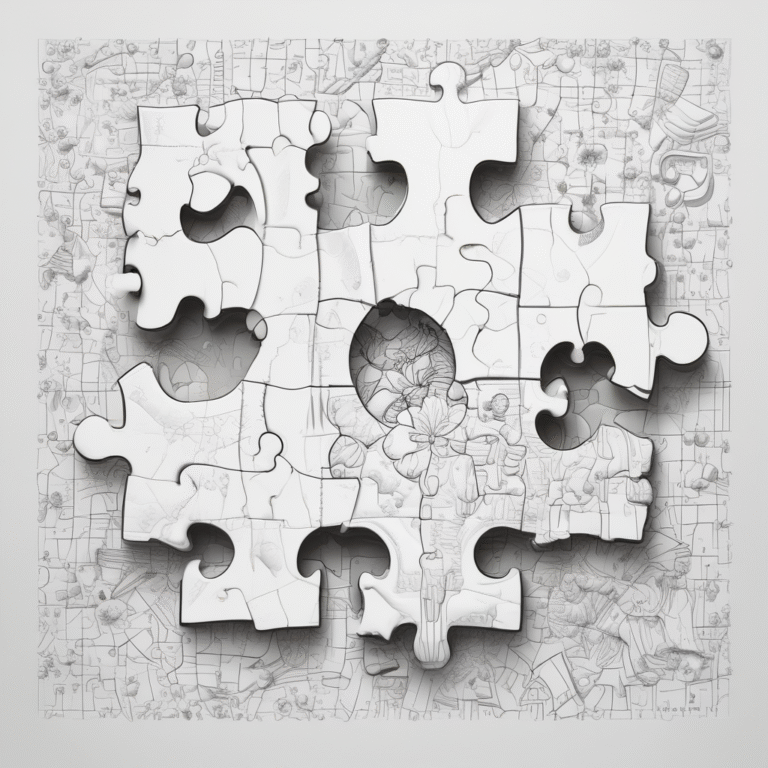

- Concevoir pour la modularité plutôt que pour des systèmes monolithiques, permettant une adaptation locale au sein d’un cadre partagé.

La Question de la Responsabilité

Dans le système des kolkhozes, la responsabilité était diluée à travers des couches de bureaucratie. Les planificateurs centraux blâmaient les gestionnaires locaux, qui, à leur tour, blâmaient les directives. Les systèmes d’IA risquent de connaître un vide similaire de responsabilité. Lorsque l’algorithme refuse un prêt, qui est responsable ?

Pour éviter cela, il est crucial de conférer la responsabilité à ceux qui sont le plus proches de l’impact. Cela signifie habiliter des équipes interdisciplinaires à intervenir lorsque l’IA cause des dommages.

Innovation Collective sans Imposition Collective

Le thème du sommet – « Collectivement à la Croisée des Chemins : Vers des Avenirs de l’IA Sécurisés et Résilients » – souligne la nécessité d’un progrès partagé. Mais l’histoire de l’Estonie rappelle que l’innovation collective ne doit pas devenir une imposition collective.

La résilience ne découle pas uniquement de la standardisation, mais de la diversité, de la redondance et de l’adaptabilité. Les cadres de gouvernance de l’IA les plus solides combineront une infrastructure globale avec un profond respect pour l’autonomie locale.

Alors que les dirigeants mondiaux se réunissent à Tallinn, les vestiges d’un système imposé rappellent en silence que les systèmes florissants sont construits avec les communautés, et non pour elles. La question n’est pas de savoir si l’IA doit soutenir des objectifs collectifs, mais qui définit ces objectifs et quelles expériences les façonnent.