Lancement d’un outil de gouvernance pour agents d’IA

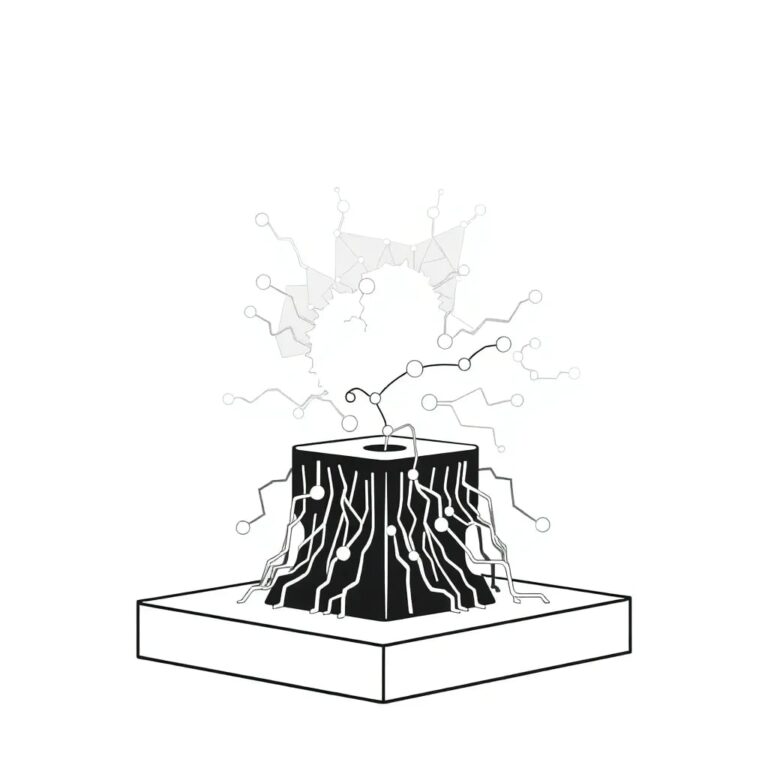

Un nouveau produit de gouvernance a été lancé pour aider les entreprises à suivre et contrôler la manière dont les agents d’intelligence artificielle se connectent aux systèmes d’entreprise. Ce produit répond à un besoin croissant des entreprises qui peinent à comprendre quels outils sont utilisés, quelles données peuvent être accessibles et quelles identités se cachent derrière ces connexions.

Présentation du produit

Le produit, appelé Agentic Governance & Administration (AGA), cible les équipes de sécurité et d’identité qui gèrent l’utilisation croissante des assistants IA, des plateformes d’agents et des agents exécutés localement dans les environnements d’entreprise.

Avec l’adoption rapide des outils d’IA, l’accès commence souvent par une connexion simple effectuée par un développeur ou un membre de l’équipe, mais la supervision de ces connexions peut prendre du retard. Cela laisse les équipes de sécurité dans l’incertitude concernant les applications et systèmes auxquels un agent d’IA peut accéder, ainsi que les permissions associées.

Fonctionnalités du produit

AGA applique des principes de gouvernance d’identité établis aux accès liés à l’IA, tels que l’inventaire, la propriété, l’accès au moindre privilège, l’auditabilité et l’application. Contrairement aux outils de gouvernance d’identité traditionnels, AGA traite les agents d’IA qui ne sont pas des utilisateurs humains, mais des services ou des processus utilisant des jetons, des comptes de service ou des clés API.

Le système construit un profil d’agent d’IA en combinant trois ensembles de données : les sources où les agents sont identifiés, les cibles d’entreprise qu’ils touchent et les identités utilisées pour y accéder.

Gestion des risques

L’un des aspects du produit est conçu pour découvrir ce qui est appelé IA fantôme, qui inclut l’utilisation non autorisée de logiciels d’IA et d’outils de modèles linguistiques, ainsi que des agents exécutés localement. AGA s’intègre aux outils de détection et de réponse pour identifier les clients d’IA sur les appareils des employés.

Surveillance et conformité

Le produit offre également une visibilité sur l’activité des agents et les outils qu’ils invoquent, ainsi que les services auxquels ils se connectent. Il fournit des contrôles de politique pour les cibles approuvées et le comportement des clients d’IA, tout en créant des pistes de vérification pour les activités autorisées et bloquées.

Cette approche reflète un changement plus large dans la sécurité d’entreprise, où la découverte seule ne suffit plus. Les équipes de sécurité souhaitent désormais savoir non seulement qu’un outil d’IA existe, mais aussi s’il fonctionne dans un cadre de politique approprié.

Conclusion

Le lancement de cet outil illustre comment les fournisseurs de gestion des identités s’adaptent à l’essor des systèmes d’IA autonomes et semi-autonomes au sein des grandes organisations. AGA vise à aider les équipes de sécurité à cartographier les connexions IA, à examiner les permissions et à appliquer des politiques à mesure que l’utilisation de l’IA se développe dans les systèmes d’entreprise.