Un Modèle Conceptuel pour Orienter les Stratégies de Gouvernance des Risques liés à l’IA

Introduction

Ces dernières années, la mitigation des risques est devenue de plus en plus importante dans le paysage de la gouvernance de l’IA. À travers le monde, des pays et des organisations multilatérales ont évolué au-delà d’énoncés de haut niveau sur les risques posés par l’IA pour adopter des cadres, des lois et des politiques visant à clarifier les droits et valeurs que les développeurs et utilisateurs d’IA doivent respecter, ainsi que les pratiques à adopter pour ce faire.

Des politiques telles que la Loi sur l’Intelligence Artificielle de l’Union Européenne, les règles de l’administration Biden-Harris régissant l’utilisation de l’IA par les agences fédérales des États-Unis, et une résolution unanime de l’Assemblée Générale des Nations Unies sur une IA digne de confiance articulent l’intérêt public à protéger contre les risques liés à l’IA. Les pays ont également fondé de nouveaux instituts de sécurité de l’IA pour développer les sciences et pratiques nécessaires à une utilisation responsable de l’IA.

Analyse des Cadres de Gestion des Risques en IA

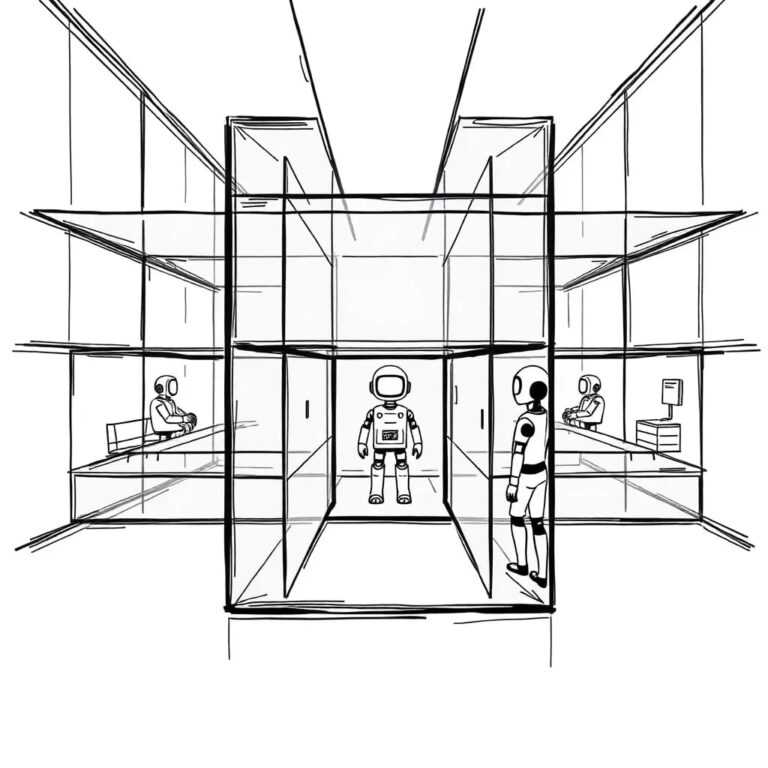

La gestion des risques liés à l’IA doit évoluer vers une approche systémique qui prenne en compte le contexte sociotechnique. Les interventions devraient se concentrer sur la prévention des dommages au niveau sociotechnique, en tenant compte des interactions entre les composants humains, matériels, techniques et sociaux.

Il est crucial d’évaluer si les efforts de gestion des risques se concentrent sur les bons acteurs et utilisent les bons outils pour réduire les préjudices causés par l’IA. Actuellement, les activités de gestion des risques en IA sont souvent déconnectées de la protection des droits et de la sécurité publics.

Implications et Risques

Les cadres de gouvernance existants se concentrent souvent sur des systèmes techniques, en mettant l’accent sur les méthodes d’évaluation et de mitigation qui ne suffisent pas à elles seules à s’attaquer aux préjudices réels. Une approche centrée sur le modèle peut nuire à l’innovation et à la compétition économique, et il est essentiel d’inclure une gamme plus large d’expertise et de méthodes pour gérer efficacement les risques liés à l’IA.

Conclusion

Pour que la gestion des risques de l’IA soit efficace et légitime, il est nécessaire d’établir des politiques qui élargissent les méthodes de mitigation des risques et engagent un plus grand nombre d’acteurs. En redéfinissant les objectifs de gestion des risques autour de la prévention des préjudices, nous pouvons mieux protéger les droits et la sécurité du public tout en tirant parti des avantages de l’IA.