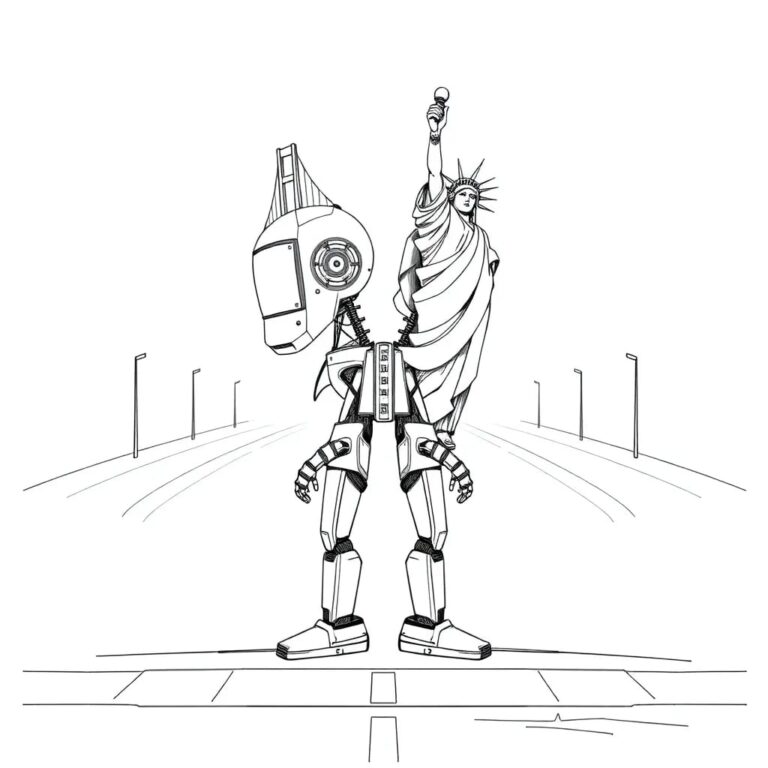

Législation sur la sécurité de l’IA dans les États : Californie et New York

Les États de Californie et de New York ont chacun adopté des lois en fin d’année 2025 pour imposer des protections lors du déploiement de « grands modèles d’IA de pointe ». Ces lois visent à atténuer les risques catastrophiques liés à ces puissants modèles en exigeant des développeurs qu’ils publient des informations sur leurs protocoles de sécurité, y compris des évaluations des risques, et qu’ils signalent les incidents de sécurité critiques à l’État.

Convergence des législations

La loi californienne, intitulée Transparency in Frontier Artificial Intelligence Act (TFAIA), a été signée par le gouverneur le 29 septembre 2025 et est entrée en vigueur le 1er janvier 2026. La loi de New York, connue sous le nom de Responsible AI Safety and Education Act (RAISE Act), a été signée le 16 décembre 2025 et entrera en vigueur le 1er janvier 2027. Les deux lois cherchent à établir un « référentiel unifié » entre les États.

Éléments clés des lois

Les deux lois partagent des éléments similaires :

- Exigence principale : un cadre d’IA de pointe documenté pour gérer et atténuer les risques catastrophiques.

- Développeurs : inclut les développeurs qui ont formé un modèle de pointe avec un chiffre d’affaires annuel supérieur à 500 millions de dollars. La loi de New York exclut certains établissements d’enseignement.

- Définition des incidents critiques : inclut un accès non autorisé entraînant des blessures ou des décès.

- Signalement des incidents : doit être signalé dans les 15 jours en Californie, et dans les 72 heures à New York.

- Sanctions principales : actions civiles par le procureur général pour violations. Les sanctions peuvent être plus élevées pour les violations répétées à New York.

Implications et risques

Ces lois pourraient être contestées dans le cadre de l’Executive Order 14365, qui vise à établir un cadre fédéral pour les politiques relatives à l’IA. Il n’est pas encore clair si les lois californienne et new-yorkaise sur la sécurité de l’IA seront affectées par ces directives fédérales.

Conclusion

Les législations de Californie et de New York représentent une étape importante dans la régulation des technologies d’IA avancées. Elles visent à garantir un déploiement sécurisé tout en encourageant l’innovation responsable. Les entreprises doivent se préparer à se conformer à ces nouvelles exigences pour éviter des pénalités et assurer la sécurité publique.