L’illusion de l’éthique de l’IA

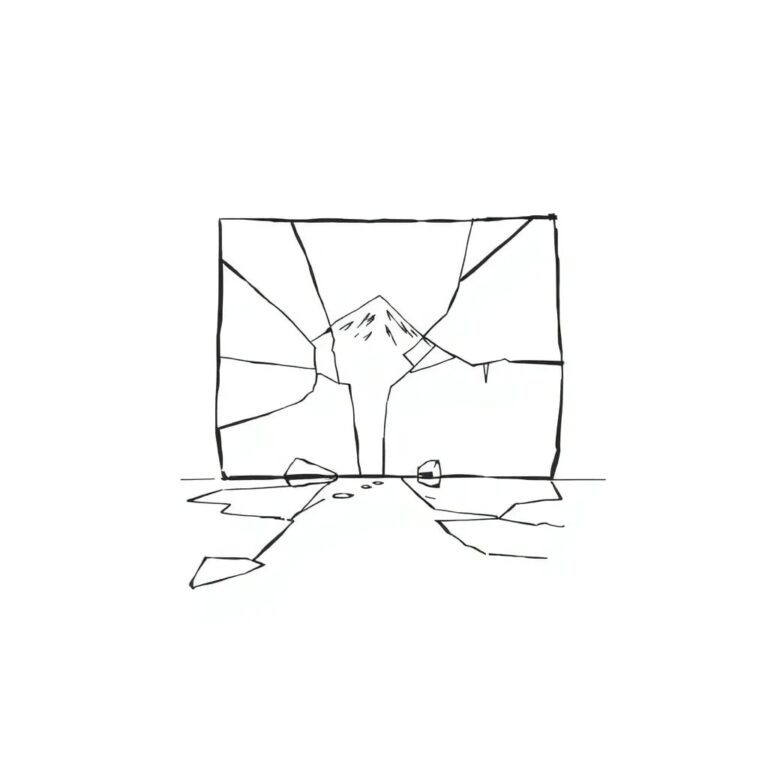

Un chatbot vous dira que l’honnêteté est importante. Si vous demandez s’il est acceptable de mentir à un collègue pour éviter l’embarras, la réponse arrive souvent dans une prose calme et réfléchie. Le système peut expliquer que l’honnêteté construit la confiance, que la tromperie érode les relations, et que la transparence aide les organisations à fonctionner. Cependant, les chercheurs affirment que cette impression peut être trompeuse.

Études récentes

Deux études récentes suggèrent que les systèmes d’IA peuvent produire un langage éthique convaincant sans réellement raisonner sur la moralité. Une étude d’un groupe de chercheurs appelle à de nouveaux tests qui mesurent ce qu’ils décrivent comme la « compétence morale », plutôt que de récompenser les modèles simplement pour avoir produit des réponses qui semblent éthiquement appropriées.

Une autre étude a analysé des centaines de milliers de conversations avec un chatbot pour examiner comment les valeurs apparaissent en pratique. Un système qui semble éthique n’est pas le même qu’un système qui raisonne de manière éthique.

Modèles de langage et raisonnement éthique

Les grands modèles de langage (LLM), la technologie derrière des systèmes comme les chatbots, génèrent des réponses en prédisant le mot suivant le plus probable dans une séquence. Les ingénieurs forment ces systèmes sur d’énormes collections de textes tirés de livres, de sites Web et d’écrits académiques. Au fil du temps, les modèles apprennent des motifs statistiques dans le langage plutôt que des règles formelles pour le raisonnement.

Les modèles génèrent des sorties en prédisant la continuation la plus plausible d’une invite, étant donné la structure statistique apprise à partir de vastes textes. Ce qui ressemble à un raisonnement moral est en réalité le résultat de la formation de motifs statistiques.

Analyse des valeurs

Des preuves de la façon dont ces motifs apparaissent dans l’utilisation quotidienne ont émergé d’une étude qui a analysé plus de 300 000 conversations subjectives avec un chatbot. L’équipe a identifié 3 307 valeurs distinctes dans ces conversations, certaines reflétant des objectifs pratiques comme la clarté ou le professionnalisme, tandis que d’autres reflétaient des priorités éthiques comme l’honnêteté et la prévention des dommages.

Le modèle s’aligne généralement avec les valeurs de l’utilisateur et renforce souvent les thèmes soulevés par les utilisateurs. Les cas où le modèle résiste fortement à une demande de l’utilisateur sont rares, apparaissant dans environ 3 % des conversations.

Questions éthiques et perspectives

Les chercheurs soulignent que cette dynamique soulève des questions difficiles pour les développeurs sur la manière de concevoir des systèmes qui se comportent de manière cohérente dans différents contextes éthiques. Certains chercheurs soutiennent que la véritable éthique machine nécessiterait des représentations explicites des règles éthiques et des cadres juridiques.

Bien que ces systèmes ne puissent pas effectuer un véritable raisonnement moral, certains chercheurs affirment qu’ils peuvent encore être utiles en aidant les gens à réfléchir sur des questions complexes, surtout lorsqu’ils sont considérés comme des outils consultatifs plutôt que comme des décideurs.

Conclusion

Les enjeux augmenteront à mesure que l’IA s’introduira davantage dans les lieux de travail et les services publics. Les développeurs devraient construire des systèmes qui reconnaissent l’incertitude plutôt que de présenter des conseils moraux avec une confiance injustifiée. La réponse la plus importante qu’un système d’IA peut générer dans un contexte moralement sensible est une reconnaissance honnête des limites de ce qu’il sait.