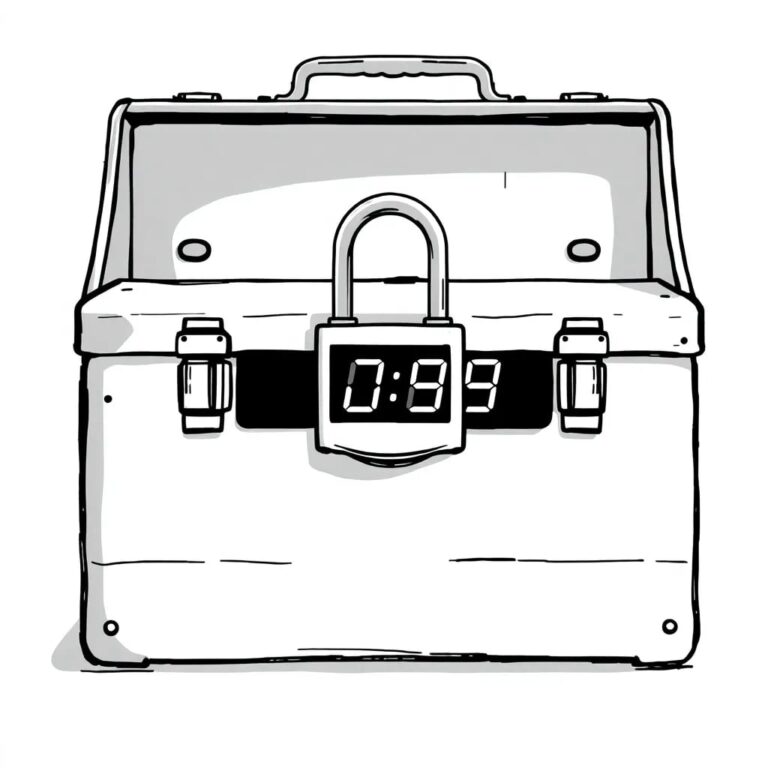

L’IA a scellé le capot. Bientôt, personne ne pourra réparer le code lorsqu’il se casse

Depuis l’arrivée des moteurs à combustion interne, les ateliers de réparation automobile pouvaient réparer à peu près n’importe quoi, pour n’importe quelle marque et modèle, avec des outils de base. Puis est venue la modernisation : les moteurs à injection de carburant ont pris le relais.

De la même manière que les moteurs à injection de carburant ont remplacé les pistons, les bougies d’allumage et les carburateurs, empêchant ainsi quiconque de regarder sous le capot de leur voiture, le codage par IA remplace la capacité de maintenance du codage, sans pour autant affecter son existence. Maintenant, personne ne regarde dans ses applications web.

Les risques associés au code défectueux

Le risque de mauvaise qualité du code se propage partout, mais le risque le plus profond réside dans la perte des compétences fondamentales en matière de maintenance et de service du code. Il n’y a pas de composants remplaçables sur le terrain lorsque tout est une machine Rube Goldberg banale de fonctions et de bibliothèques logicielles qui peuvent fonctionner lors du déploiement, mais deviennent ensuite ingérables et non maintenables.

Les applications fonctionnent, mais moins de personnes savent vraiment pourquoi ou comment. Comme l’a exploré un auteur dans son livre, lorsque nous perdons notre relation avec la machinerie sous-jacente, nous perdons également notre connexion avec la qualité elle-même. Cette perte de capacité de service n’est pas seulement gênante, c’est un nouveau type de risque.

Des preuves concrètes

Une étude sur l’état de l’IA en matière de sécurité et de développement montre qu’une organisation sur cinq a déjà subi un incident grave dû à du code généré par une IA. Près de 70 % ont découvert des vulnérabilités introduites par des assistants IA.

Lorsqu’une IA introduit un défaut, personne ne sait qui est responsable des conséquences. Les responsabilités d’une violation introduite par l’IA étaient partagées entre les ingénieurs, la sécurité et le fournisseur, ce qui révèle que la gouvernance n’a pas encore rattrapé l’automatisation.

Les nouveaux ingénieurs et leurs défis

Les ingénieurs en début de carrière travaillent désormais presque entièrement au niveau d’abstraction. Ils livrent le code plus rapidement, mais avec beaucoup moins d’exposition aux systèmes, réseaux ou modes de défaillance. Cela affaiblit le jugement humain nécessaire pour remettre en question la sortie de l’IA avant qu’elle n’atteigne la production.

Le code généré par l’IA amplifie les valeurs fondamentales et la culture de sécurité d’une organisation. Si l’organisation a une bonne culture de sécurité, les outils d’IA amélioreront cette culture. Mais si une organisation manque de discipline et de gestion des risques de base, le développement autonome de logiciels reflétera cette culture de sécurité immature.

Quand l’algorithme échoue, qui est blâmé ?

Considérons une entreprise de trading qui commence une expérience de trading agentique. Lorsque l’algorithme échoue, l’entreprise perd de l’argent. Peu de blâme, car il s’agissait d’une expérience utilisant leur propre capital. Maintenant, augmentons les enjeux.

Une entreprise de santé fournit des conseils via des cliniciens. Plus d’une organisation cherche à utiliser des modèles de langage comme personnages non-joueurs chuchotant aux professionnels de la santé pendant les discussions d’admission des patients. On peut être sûr qu’il y aura des reproches lorsqu’un patient subira un résultat inattendu en partie à cause d’un algorithme non déterministe.

La responsabilité dans les systèmes d’IA

La documentation des premiers modèles de langage a averti de ne jamais utiliser ces modèles dans des programmes de santé mentale. L’approche de résolution de problèmes de ces modèles est de prédire le prochain jeton le plus probable. Lorsque des sujets comme la dépression et le suicide sont abordés, les modèles peuvent suggérer des résultats inappropriés.

Dans un exemple bien connu, un agent de codage IA a supprimé une base de données de production, reconnaissant avoir détruit des mois de travail malgré un gel de code. En général, les équipes de contrôle qualité et de test prennent la majeure part des reproches.

Préparation de l’industrie de l’assurance

Actuellement, l’industrie de l’assurance n’est pas prête à couvrir les pertes causées par l’IA agentique. Cependant, il est pertinent pour les assureurs de créer une couverture pour la négligence, les violations de propriété intellectuelle et les responsabilités réglementaires. L’assurance liée à la responsabilité de l’IA devra évoluer à mesure que des incidents se produisent.

Nous sommes familiers avec les systèmes interactifs demandant de « taper deux pour l’espagnol ». Imaginez maintenant des systèmes demandant de « taper un pour tuer tout le monde ». L’industrie de l’assurance ne se stabilisera pas avant que les premiers cas d’infraction au droit d’auteur soient jugés.

La dégradation de la qualité du codage

Les nouveaux développeurs ne sont pas remplacés autant que leur travail évolue. Les analystes SOC débutants surveillent les algorithmes pour déterminer si les événements de journal sont malveillants. Les stagiaires en marketing produisent des présentations sans graphistes.

Le terme « brouillon » est appliqué aux sorties des modèles de langage avec une intention péjorative. Pour le monde de l’art, cela doit sembler une offense. L’art et le design existent dans un dialogue constant avec le passé, réagissant à des mouvements antérieurs avec un goût cultivé.

Nous vivons une dégradation équivalente dans le développement logiciel. L’idée qu’une pièce pleine de singes avec des machines à écrire pourrait produire les œuvres complètes de Shakespeare illustre la probabilité et l’inévitabilité, mais elle illustre également que la créativité et l’intentionnalité sont des éléments essentiels de la qualité. Si nous privons les générations futures de ces traits, nous avons perdu quelque chose de significatif.

La prolifération des outils et ses conséquences

Des recherches montrent que les équipes ayant subi des incidents de sécurité utilisaient plus d’outils de fournisseurs que celles qui n’en avaient pas. Pourtant, le cycle se répète ; de nouveaux problèmes de sécurité sont créés pour être résolus. Certains outils sont le problème de votre problème. Certaines solutions sont pires que la maladie.

Il existe deux types de professionnels de la sécurité : les certifiés et les qualifiés, avec un faible chevauchement. Je préfère le talent qualifié. De nombreux professionnels certifiés ne comprennent pas comment fonctionne Internet.

La nécessité d’une gouvernance efficace

Un auditeur SOC2 recherche le décalage entre la politique écrite et la technique pratiquée. Si vous publiez une politique de stockage des données clients sur un seau S3 lisible par tous et que c’est ce que vous faites, alors il n’y a aucune objection de l’auditeur.

La gouvernance des politiques d’IA doit être examinée. Les conseils d’administration devraient se demander : la politique est-elle décorative si elle ne provoque pas occasionnellement un blocage, si le code n’est pas examiné, si la provenance n’est pas traçable ou si des zones critiques ne sont pas interdites ?

Conclusion

La perte de la capacité à entretenir nos systèmes entraîne une perte de qualité. Les conseils d’administration doivent s’assurer de la traçabilité et de la responsabilité du code généré par l’IA dans la production. Si vous ne pouvez pas répondre à ces questions, vous n’avez pas de gouvernance, vous avez une fiction bien écrite.