Conflit entre une entreprise technologique et le Pentagone : l’éthique de la guerre par intelligence artificielle en question

Alors que la fumée s’élevait encore des ruines d’une école élémentaire en Iran, les questions ont commencé à surgir sur la manière dont cet incident tragique a pu se produire pendant les premières heures de la guerre entre les États-Unis et Israël contre l’Iran.

Des rapports préliminaires suggèrent que l’école a été mal identifiée comme un site militaire en raison d’informations humaines obsolètes, ce qui a conduit à une frappe par un missile de croisière. Cet événement met en lumière l’interaction complexe entre l’utilisation de l’intelligence artificielle générative pour traiter des données massives et la sélection de cibles militaires.

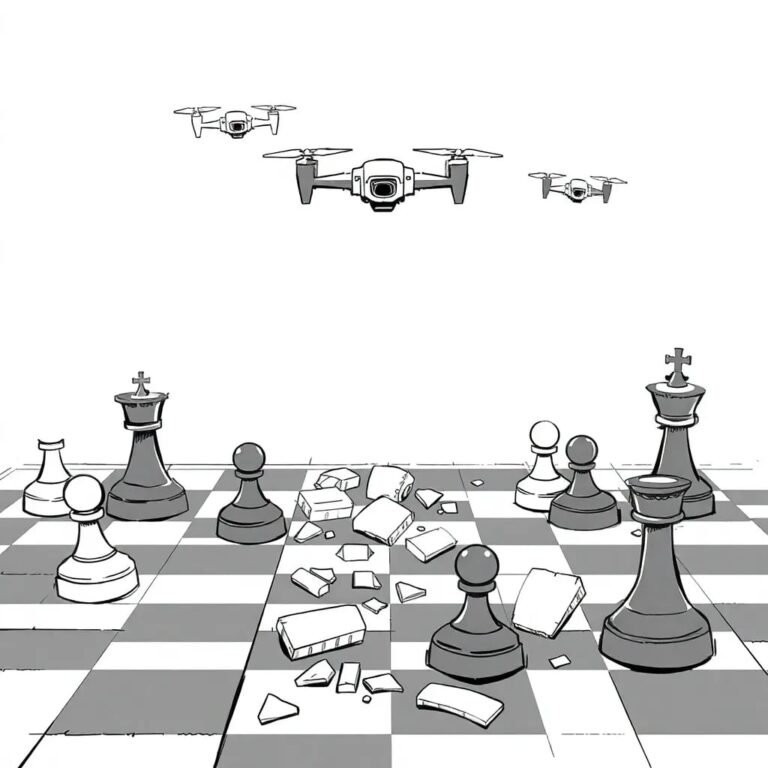

La première guerre par intelligence artificielle

Certains commentateurs qualifient ce conflit de « première guerre par IA », soulevant d’anciennes et nouvelles considérations éthiques. La préoccupation principale est que l’IA ne doit pas être laissée à ses propres dispositifs.

Le 27 février, la veille de l’opération, le président a ordonné aux agences gouvernementales de ne plus travailler avec une entreprise technologique majeure, en raison de divergences sur l’utilisation acceptable de sa technologie par le département de la Défense. En réponse, cette entreprise a intenté un procès contre le Pentagone.

Objections éthiques et soutien d’experts

Des théologiens catholiques ont déposé un mémoire de soutien, notant que les objections de l’entreprise concernant l’utilisation de l’IA pour la surveillance de masse sont alignées avec l’enseignement de l’Église sur la vie privée. Ils ont également souligné que les armes autonomes obscurcissent la responsabilité humaine.

Des responsables religieux ont fait part de leurs préoccupations concernant l’impact de l’IA sur la dignité humaine et les droits fondamentaux. Ils insistent sur le fait que toute décision de guerre doit être guidée par des considérations morales.

Utilisation actuelle des outils d’IA

Des responsables militaires ont déclaré que les États-Unis utilisent une variété d’outils avancés d’IA pour réaliser des frappes. Ces systèmes permettent de trier rapidement d’énormes quantités de données pour aider à la prise de décision.

Préoccupations législatives

Cependant, des législateurs ont exprimé leurs inquiétudes quant aux frappes ayant touché des lieux non militaires, demandant quel rôle l’IA joue dans le choix des cibles et à quel point elle est soumise à une vérification humaine.

Considérations éthiques et responsabilités

Historiquement, l’éthique de la guerre est régie par des règles strictes de conduite, mais certains observateurs s’inquiètent de la position actuelle sur la manière dont la guerre est menée. Il est essentiel que des décisions humaines soient toujours impliquées dans les applications de critères de guerre juste.

Les entreprises ont la responsabilité de s’assurer que leurs produits sont utilisés de manière appropriée et éthique. Les discussions actuelles soulignent la nécessité de maintenir des garde-fous moraux dans le développement et l’utilisation de l’intelligence artificielle dans le cadre militaire.

Conclusion

Le débat sur l’utilisation de l’IA dans les conflits armés met en lumière des enjeux éthiques significatifs. La nécessité d’une supervision humaine dans les décisions militaires demeure cruciale pour éviter des conséquences dévastatrices et assurer le respect des droits fondamentaux.