Votre IA organisationnelle est-elle une menace cachée ? Dévoiler les dangers de l’IA fantôme

Actuellement, au sein de votre organisation, quelqu’un est en train de s’inscrire à un outil d’intelligence artificielle (IA). Peut-être s’agit-il d’un responsable marketing expérimentant la génération de contenu. Peut-être un développeur intégrant un assistant de codage IA. Ou encore, une équipe financière explorant les rapports automatisés.

Ces actions ne sont pas le fruit de l’imprudence, mais d’une recherche de ressources. Ils ont trouvé quelque chose qui rend leur travail plus rapide, plus facile et plus efficace. Ils l’ont connecté à vos systèmes, lui ont accordé l’accès à vos données, puis ont poursuivi leur journée.

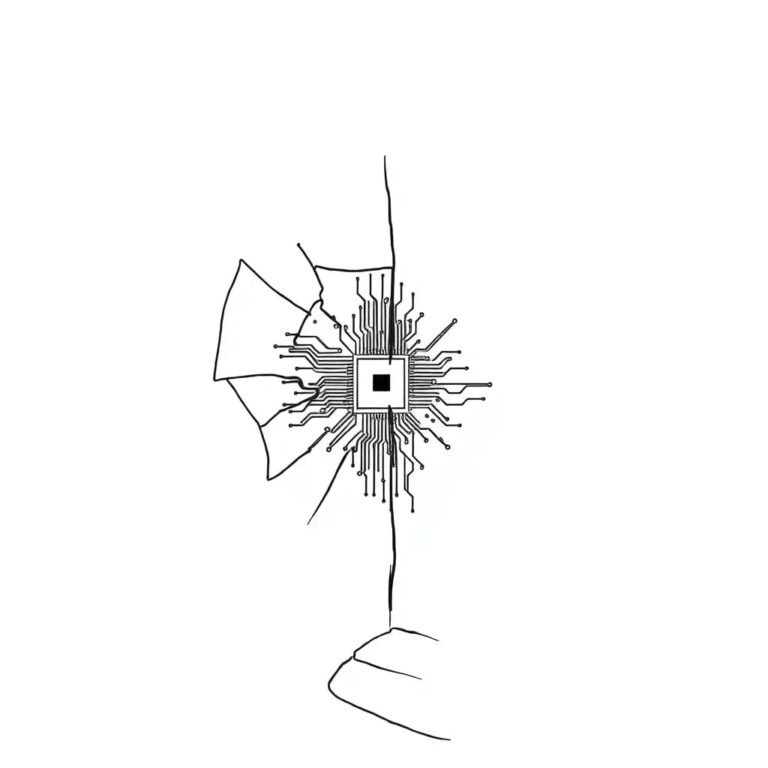

Ce qu’ils n’ont probablement pas fait, c’est en informer le département informatique. Et ce que le département informatique n’a presque certainement pas fait, c’est intégrer cet outil, ainsi que ses identités associées, dans votre cadre de gouvernance. C’est ce qu’on appelle l’IA fantôme. Et cela crée une crise d’identité dont la plupart des organisations ne se rendent pas encore compte.

Une adoption accélérée de l’IA

L’adoption de l’IA dans les entreprises a considérablement augmenté. Selon un rapport de janvier 2025, une grande partie de la mise en œuvre actuelle de l’IA est exploratoire ou expérimentale, avec des organisations utilisant des approches basées sur des cas d’utilisation qui mettent l’accent sur l’idéation et la mise en œuvre rapide.

Le problème ne réside pas dans l’expérimentation elle-même. L’innovation nécessite la liberté d’explorer. Le problème réside dans ce qui se passe ensuite : les expérimentations s’intègrent dans les opérations commerciales réelles sans l’évaluation rigoureuse des risques, les tests de système et la supervision de gouvernance que des déploiements formels exigeraient.

Identités non humaines et gestion des accès

Chaque outil d’IA qui se connecte à votre environnement crée de nouvelles identités. Des clés d’API qui authentifient les demandes, des comptes de service qui accèdent aux bases de données, des jetons qui maintiennent des connexions persistantes. Ces identités non humaines se multiplient rapidement, souvent sans apparaître dans aucun registre ou tomber sous aucune politique de gouvernance.

Dans des organisations où les identités non humaines dépassent déjà le nombre d’utilisateurs humains par 10:1 ou plus, l’IA fantôme accélère encore ce déséquilibre, totalement en dehors de la visibilité de votre équipe de sécurité.

La gestion traditionnelle des identités et des accès a été conçue avec un processus clair en tête. Quelqu’un demande l’accès, la demande est évaluée, l’accès est accordé ou refusé, et la décision est enregistrée. Lorsque les circonstances changent, l’accès est révisé et ajusté.

L’IA fantôme contourne complètement ce processus. Il n’y a pas de demande car personne ne pense à en faire une. Il n’y a pas d’évaluation car l’outil semble inoffensif. Il n’y a pas d’enregistrement car la connexion se fait en dehors des canaux sanctionnés. Lorsque l’employé qui l’a configuré change de rôle ou quitte l’entreprise, l’outil d’IA et ses identités restent — orphelins, non surveillés et potentiellement vulnérables.

Les risques accrus

Le rapport souligne ce risque : un manque de programmes de déploiement formels diminue la transparence, ce qui affaiblit les processus de gestion et la supervision des dirigeants. Une gestion laxiste des logiciels amplifie le problème alors que l’IA est introduite par le biais de navigateurs non sanctionnés, de plugins et d’outils open-source adoptés sans revue.

Ce qui commence par la productivité individuelle devient une exposition organisationnelle. Voici un test pratique : votre organisation peut-elle répondre à ces questions avec confiance ? Combien d’outils d’IA sont actuellement connectés à vos systèmes ? Lesquels ont été formellement approuvés et lesquels sont arrivés par adoption informelle ? Quelles données ces outils peuvent-ils accéder ? Quelles identités ont été créées pour permettre ces connexions ? Qui possède ces identités ? Quand les identifiants ont-ils été renouvelés pour la dernière fois ? Que se passe-t-il avec ces connexions lorsque l’employé qui les a créées part ?

Dans notre travail avec des entreprises, nous constatons que la plupart ne peuvent répondre à même pas la moitié de ces questions. Le problème ici est lié à l’infrastructure. Les outils et processus conçus pour gérer les identités de la main-d’œuvre humaine n’ont tout simplement pas été construits pour la population en expansion des identités machine que l’adoption de l’IA crée.

Solutions et gestion proactive

Aborder l’IA fantôme nécessite de commencer par ce que vous pouvez contrôler : la visibilité. Vous ne pouvez pas gouverner ce que vous ne pouvez pas voir, et vous ne pouvez pas voir ce que vous ne cherchez pas.

La découverte est la première étape essentielle. Un scan automatisé qui identifie les intégrations d’IA dans votre environnement, qu’elles soient autorisées ou non. De nombreux déploiements d’IA fantôme existent simplement parce qu’il n’y avait pas de processus clair pour une adoption formelle. Rendre ce processus visible et accessible réduit l’incitation à le contourner.

Ensuite, l’inventaire suit la découverte. Chaque outil d’IA, chaque identité associée, est mappé à un propriétaire humain et à un but commercial. Cela crée une responsabilité. Lorsqu’un nom est attaché à une intégration, la conversation sur la gouvernance devient naturelle plutôt qu’adversariale.

Les politiques doivent évoluer pour correspondre à la réalité. Des directives complètes couvrant comment l’IA peut être utilisée au sein de l’organisation, comment de nouveaux outils sont évalués avant leur mise en œuvre, et comment les identités créées par ces outils sont gérées tout au long de leur cycle de vie garantissent que l’innovation ne crée pas de risques involontaires.

Il y a aussi un élément humain. Les employés adoptent l’IA fantôme parce qu’ils y voient de la valeur. Bloquer cette adoption complètement pousse le comportement encore plus sous terre. L’approche la plus efficace combine l’autonomisation avec la gouvernance.

Cela signifie garantir que les administrateurs informatiques soient éduqués et suffisamment qualifiés pour évaluer et gérer les outils d’IA. Cela signifie créer des voies claires pour que les employés demandent de nouveaux outils, avec des délais de réponse qui ne les poussent pas vers des alternatives non officielles. Cela signifie reconnaître que l’adoption de l’IA est inévitable et positionner votre cadre d’identité pour l’accommoder plutôt que de lui résister.

Conclusion

Les organisations qui réussissent à gérer ce défi traitent l’IA fantôme comme un signal, et non seulement comme une menace. Elles comprennent où et pourquoi les employés veulent des solutions d’IA. Ces insights peuvent informer une adoption stratégique de l’IA qui offre les avantages de productivité tout en maintenant la sécurité et la gouvernance.

L’IA fantôme est une réalité actuelle qui devient de plus en plus complexe chaque semaine. Chaque nouvel outil adopté sans supervision, chaque clé d’API créée sans gouvernance, et chaque compte de service qui existe en dehors de votre cadre d’identité s’accumulent pour créer des risques qui deviennent plus difficiles à traiter tant qu’ils sont ignorés.

La bonne nouvelle est que les principes pour gérer ce défi existent déjà. Découverte, inventaire, propriété, gestion du cycle de vie et surveillance continue sont les mêmes fondamentaux qui s’appliquent à toute population d’identité. Ce qui est requis, c’est d’étendre leur portée pour englober les outils d’IA déjà opérationnels dans votre environnement.

L’IA que votre équipe a adoptée la semaine dernière a sa propre identité. La question est de savoir si vous allez la gérer de manière proactive ou la découvrir lors d’une enquête sur un incident.