Pourquoi la gouvernance de l’intelligence artificielle est devenue inévitable

L’intelligence artificielle est passée des marges de l’innovation au cœur de la société moderne. Les systèmes alimentés par des algorithmes influencent désormais la manière dont les gens travaillent, apprennent, communiquent et prennent des décisions.

Cette expansion rapide a contraint les gouvernements et les institutions à faire face à une réalité difficile : le progrès technologique a dépassé les cadres réglementaires. Pendant des années, les décideurs se sont appuyés sur des lignes directrices volontaires et l’auto-régulation de l’industrie. Cependant, au fur et à mesure que les systèmes d’intelligence artificielle devenaient plus puissants et autonomes, les préoccupations se multipliaient. Des problèmes tels que l’utilisation abusive des données, les biais algorithmiques, la désinformation et le manque de responsabilité ne pouvaient plus être considérés comme des risques théoriques.

Risques centraux poussant à un contrôle accru

Plusieurs risques sont au centre du débat réglementaire. L’un des plus importants est la propagation des médias synthétiques. L’intelligence artificielle peut générer des images, des audios et des vidéos très réalistes, difficiles à distinguer de la réalité, soulevant des inquiétudes concernant l’ingérence électorale et la fraude.

Le biais et la discrimination représentent une autre problématique critique. Les systèmes d’intelligence artificielle apprennent à partir de données, qui reflètent souvent des inégalités existantes. Lorsqu’ils sont déployés dans des domaines tels que le recrutement ou l’application de la loi, les résultats biaisés peuvent renforcer des désavantages structurels. Les régulateurs se concentrent de plus en plus sur l’assurance de l’équité et de la responsabilité dans la prise de décision algorithmique.

La vie privée est également sous pression. L’intelligence artificielle s’appuie fortement sur de grands ensembles de données, dont beaucoup contiennent des informations personnelles. La collecte, le stockage et le traitement de ces données soulèvent des questions de consentement et de surveillance. Sans garanties claires, les individus peuvent perdre le contrôle de leur identité numérique.

Équilibrer innovation et protection publique

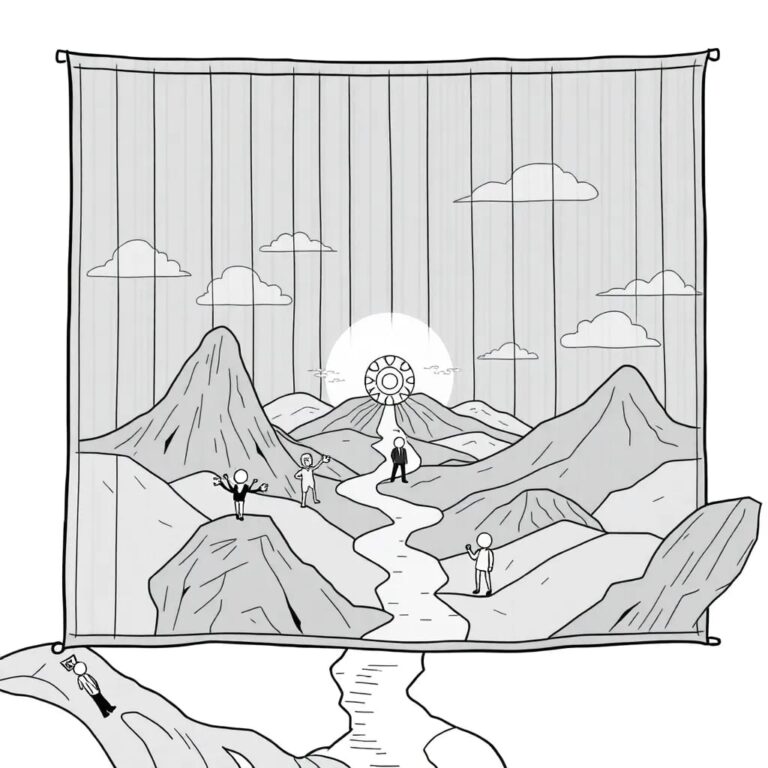

L’un des aspects les plus complexes de la réglementation de l’intelligence artificielle est de trouver le bon équilibre. Des règles trop restrictives pourraient freiner l’innovation, décourager les investissements et transférer le développement vers des environnements moins réglementés. En revanche, un contrôle insuffisant risque d’éroder la confiance du public et d’amplifier les préjudices.

Les décideurs explorent des approches basées sur les risques. Au lieu de réglementer tous les systèmes d’intelligence artificielle de manière égale, ils visent à se concentrer sur les applications ayant le plus grand impact potentiel. Les systèmes utilisés dans les infrastructures critiques ou les processus démocratiques font face à un examen plus strict que ceux déployés dans des contextes à faible risque.

Implications pour les économies et l’emploi

La réglementation influencera non seulement la manière dont l’intelligence artificielle est construite, mais aussi comment elle est adoptée à travers les économies. Des règles claires peuvent accélérer l’adoption en réduisant l’incertitude et en renforçant la confiance. Cependant, les exigences de conformité peuvent également augmenter les coûts, ce qui pourrait ralentir le déploiement dans certains secteurs.

Les marchés du travail sont au centre de cette transformation. L’intelligence artificielle promet des gains d’efficacité, mais menace également de perturber les modèles d’emploi traditionnels. La réglementation ne peut pas à elle seule prévenir le déplacement des emplois, mais elle peut façonner la manière dont les transitions sont gérées.

Conclusion

La phase réglementaire actuelle marque un tournant. L’intelligence artificielle passe d’une technologie expérimentale à une infrastructure fondamentale de la vie moderne. Avec cette transition vient une reconnaissance de la responsabilité. La réglementation cherchera à garantir que le progrès technologique soit en accord avec les valeurs sociétales, plutôt que de les compromettre.