Pourquoi les investisseurs devraient se concentrer sur l’IA axée sur la confidentialité : points clés des directives sur l’IA agentique de l’ICO

Cette semaine, l’ICO a publié des directives détaillées sur ses attentes concernant l’IA agentique. Le message central du régulateur britannique de la protection des données est clair : le succès futur de cette technologie repose sur la responsabilité.

Les attentes des investisseurs quant à la réalisation des avantages commerciaux du déploiement de l’IA augmentent. Parallèlement, la confiance dans la conformité réglementaire via les principes de responsabilité est fondamentale pour établir cette confiance. Bien sûr, avec la confiance viennent les opportunités commerciales. Les points clés à retenir des directives de l’ICO soulignent les domaines d’innovation en matière de protection des données que les investisseurs doivent prioriser dans le secteur technologique britannique.

Agents de gestion de la confidentialité personnelle

L’ICO souhaite voir des agents qui permettent aux utilisateurs de gérer leur propre confidentialité. Cela inclut des IA capables d’interpréter des avis de confidentialité complexes ou des bandeaux de cookies en leur nom, afin d’éviter la fatigue du consentement et de construire la confiance des consommateurs en respectant leurs préférences. Les solutions qui rationalisent les parcours utilisateurs gagnent une adoption plus significative, facilitant ainsi des traitements à risque plus élevés tout en préservant la confiance des consommateurs.

Automatisation des réponses de conformité

Les agents pourraient révolutionner la façon dont les organisations traitent les demandes des sujets de données, en garantissant que les outils peuvent rechercher et compiler avec précision les informations pertinentes, permettant aux organisations de répondre de manière plus rapide et efficace. Des garde-fous importants seront nécessaires pour s’assurer que les organisations ne fournissent pas d’informations incorrectes. Les modèles de langage spécifiques pourraient garantir une approche axée sur la confidentialité, l’ICO reconnaissant que des ensembles de données d’entraînement plus petits et plus spécialisés entraînent une plus grande précision des résultats. À mesure que les volumes augmentent, il est essentiel de garantir la sécurité tout en permettant aux entreprises de bénéficier des gains d’efficacité.

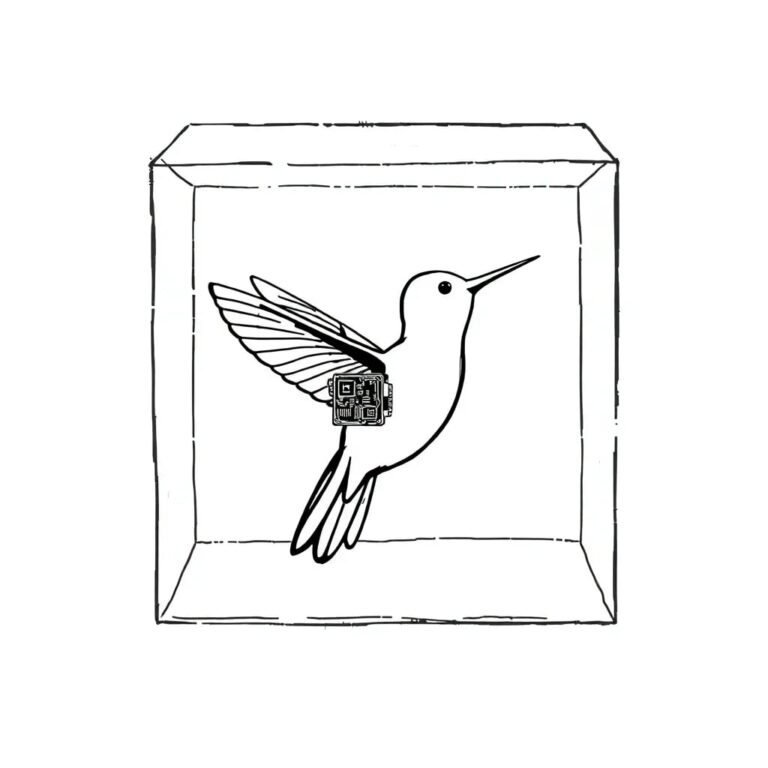

Agents locaux et informatique de confiance

Il existe un fort intérêt pour des agents qui traitent les données localement sur l’appareil de l’utilisateur. Par exemple, un agent pourrait analyser les vulnérabilités sans avoir besoin d’accéder aux informations personnelles de l’utilisateur. Pour les outils multi-agents, l’ICO souligne les opportunités de développer des protocoles de communication sécurisés standardisés entre agents. Cela est techniquement complexe, et avec le nouvel accent de l’ICO sur le droit de se plaindre, il est essentiel de vérifier que les organisations disposent de mécanismes efficaces de recours lorsque les choses tournent mal et que plusieurs agents sont impliqués.

Loin de constituer un obstacle, cette section des directives de l’ICO met en évidence des opportunités significatives pour les innovateurs technologiques. Pour les entreprises développant la prochaine génération d’outils d’IA, intégrer la « confidentialité dès la conception » n’est plus simplement une case à cocher pour la conformité. L’ICO considère que démontrer une telle conception responsable pourrait devenir un puissant facteur de différenciation sur le marché.

Les entreprises qui développent des modèles d’IA axés sur la confidentialité et une bonne gouvernance des données peuvent bénéficier de conseils sur la mise en œuvre des attentes de l’ICO dans la pratique, en particulier en ce qui concerne les évaluations d’impact sur la protection des données pour les architectures d’IA agentique.