AI en 2026 : Les services financiers prennent de l’avance, mais la gouvernance et les risques doivent rattraper leur retard

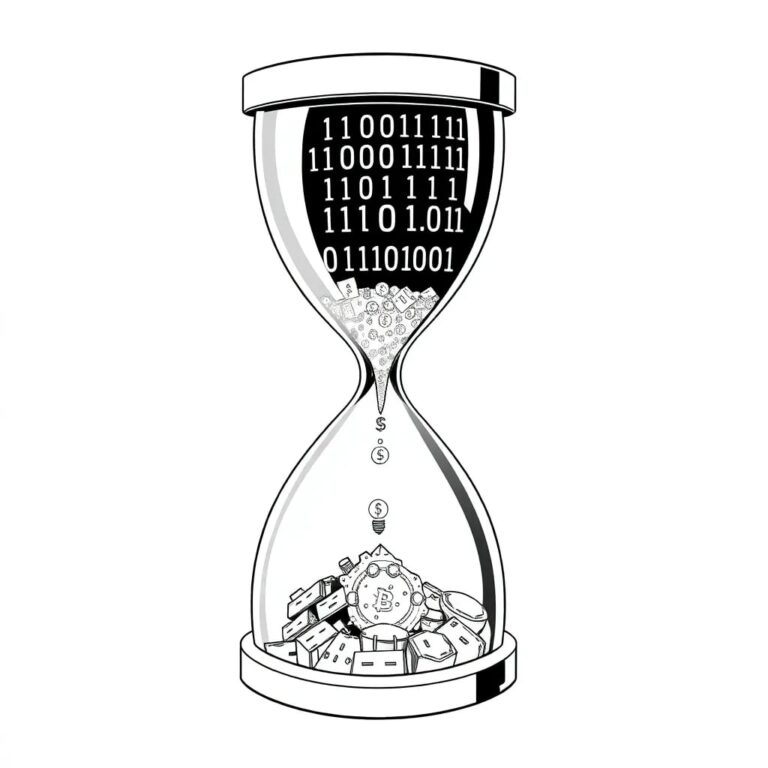

AI est désormais profondément ancré dans les services financiers, mais la gouvernance et la surveillance n’ont pas suivi le rythme, créant des risques opérationnels, réglementaires et de confiance croissants pour les entreprises et les conseillers.

Bien que nous soyons déjà en janvier 2026, il est clair que l’IA n’est plus une ambition futuriste pour les services financiers. Elle est de plus en plus intégrée dans les opérations quotidiennes des banques, des assureurs et des gestionnaires de patrimoine dans des domaines tels que la détection de fraude en temps réel et la prise de décision de crédit, tout en offrant des parcours clients plus personnalisés.

Pour les conseillers, l’intégration est plus rapide, les insights de portefeuille sont davantage basés sur les données et l’engagement numérique devient la norme.

La gouvernance de l’IA en retard

Cependant, la gouvernance de l’IA n’a pas suivi le rythme. De nombreuses entreprises s’appuient encore sur des cadres conçus pour des modèles statiques, ce qui rend difficile l’adaptation à la nature dynamique de l’apprentissage continu de l’IA. Cela entraîne un écart croissant en matière de résilience opérationnelle, de préparation réglementaire et de défense contre les cybermenaces qui, si elles ne sont pas traitées, peuvent saper la confiance des clients.

Lorsque la prise de décision basée sur l’IA devient courante

Les décisions basées sur l’IA influencent désormais les approbations de crédit, les alertes de fraude, le profilage des risques et la segmentation des clients. Contrairement aux systèmes traditionnels, les modèles modernes sont souvent adaptatifs, se mettant à jour à mesure que de nouvelles données arrivent. Les contrôles hérités qui dépendent de validations ponctuelles et de tests historiques ne suffisent plus. Sans surveillance continue, les entreprises risquent de subir des dégradations de performance, des biais cachés qui nuisent aux résultats et des choix difficiles à expliquer aux clients ou aux régulateurs.

Au-delà de la gestion traditionnelle des risques de modèles

La gestion traditionnelle des risques de modèles reste fondamentale, mais elle doit être augmentée pour l’IA. Les entreprises devraient adopter un suivi continu, une gouvernance tout au long du cycle de vie et une documentation rigoureuse de l’origine des données, de la formation, des tests et des mises à jour. Il ne s’agit pas seulement de conformité ; c’est une question de résilience. Les modèles non surveillés peuvent se dégrader silencieusement jusqu’à ce que des problèmes deviennent visibles pour les clients ou les superviseurs.

Un paysage de menaces cybernétiques en évolution rapide

L’IA élargit à la fois la surface d’attaque et les vecteurs d’attaque. Des menaces telles que le poisoning des données (manipulation des données d’entraînement), l’inversion de modèle (extraction d’informations sensibles), le vol de modèle et les attaques par injection de prompts deviennent de plus en plus sophistiquées. Une protection efficace nécessite désormais un mélange de discipline en cybersécurité et une compréhension de la façon dont les modèles apprennent et se comportent au fil du temps, surtout quand il s’agit de données clients et de confiance.

Responsabilité et surveillance éthique

La responsabilité de la gouvernance de l’IA se déplace vers les conseils d’administration et la direction, aux côtés de la cybersécurité et des contrôles financiers. Cela inclut la formation du personnel non seulement à l’utilisation des outils d’IA, mais également à la compréhension des risques réglementaires, réputationnels, financiers, éthiques et opérationnels, ainsi que des moyens de les gérer. Pour les conseillers, cet accent sur une IA éthique s’aligne sur les devoirs professionnels d’agir dans le meilleur intérêt des clients et de maintenir la confiance dans le processus de conseil.

La réglementation renforce les exigences

Les attentes réglementaires se renforcent. La loi européenne sur l’IA et les normes émergentes poussent les entreprises à intégrer des principes d’IA responsable dès le départ, couvrant le classement des risques, la documentation, la transparence et le suivi post-commercialisation, plutôt que de réadapter les contrôles. Même lorsque les conseillers ne sont pas directement concernés, ils ressentiront l’impact par le biais de fournisseurs de plateformes, de fabricants de produits et de partenaires de données.

La gouvernance comme avantage concurrentiel

Le facteur différenciant en 2026 ne sera pas la façon dont l’IA est largement déployée, mais la manière dont elle est intelligemment gouvernée. Les entreprises qui investissent dans une supervision robuste, la transparence et des cadres éthiques innoveront en toute confiance, protégeront les clients et répondront de manière crédible à la surveillance réglementaire. Pour les conseillers et leurs clients, une gouvernance efficace de l’IA n’est pas une question technique abstraite, c’est fondamental pour la confiance, la résilience et la crédibilité des conseils financiers dans un monde de plus en plus automatisé.