Gouvernance de l’IA pour les développeurs : Un guide pratique

Il y a des décennies, des concepts tels que les tests unitaires, le contrôle de version et les protocoles de sécurité n’étaient pas des pratiques standards dans le développement logiciel. Aujourd’hui, ils font partie intégrante de l’outil professionnel d’un développeur. Nous sommes à un tournant similaire avec l’intelligence artificielle. La gouvernance de l’IA pour les développeurs représente la prochaine évolution de notre métier. Il s’agit d’une approche structurée pour garantir que les systèmes que nous construisons sont non seulement puissants, mais également éthiques, conformes et sûrs. Cela ne consiste pas à ajouter de la bureaucratie, mais à appliquer une discipline d’ingénierie aux défis uniques de l’IA. Ce guide décompose la gouvernance en étapes pratiques et actionnables qui s’intègrent directement dans votre flux de travail existant, tout comme toute autre pratique de développement essentielle.

Principaux enseignements

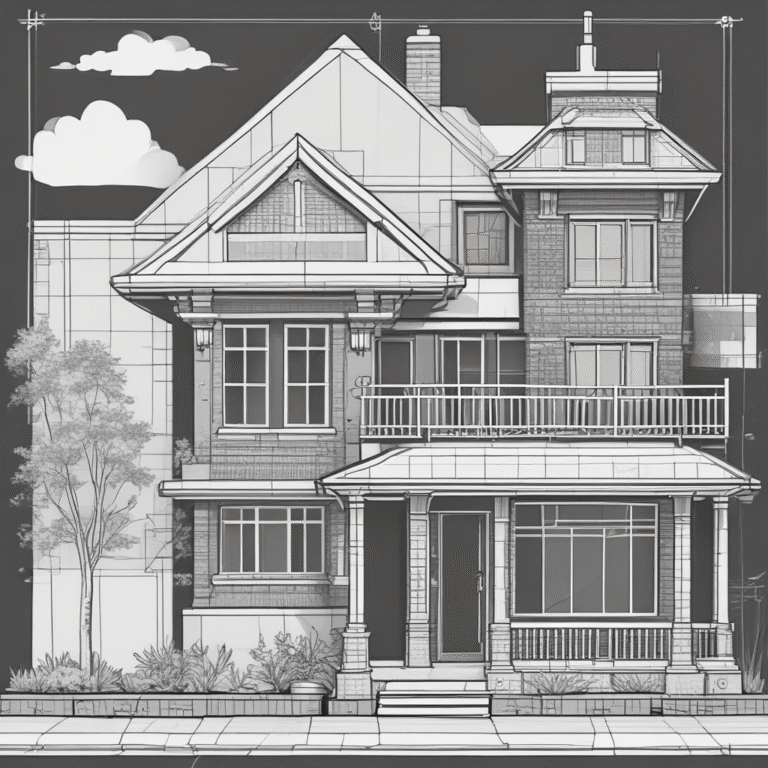

La gouvernance est un cadre de contrôle, pas une barrière : Pensez à la gouvernance de l’IA comme le plan architectural de votre travail. Elle fournit les règles et la structure claires nécessaires pour construire avec précision et autorité, transformant des principes abstraits en un plan concret pour créer des systèmes fiables et conformes.

Équité par conception – Les développeurs fixent les normes : En tant que développeur, vous êtes la première ligne de défense contre les risques. Bien que les équipes juridiques puissent auditer les problèmes, vous avez le pouvoir d’empêcher qu’ils ne soient intégrés dans le système dès le départ. Posséder cette responsabilité est la clé pour construire une IA sûre par conception.

Automatiser la gouvernance pour maintenir l’élan : Intégrez des pratiques responsables directement dans votre cycle de développement à l’aide d’outils automatisés. Les plateformes qui gèrent la surveillance, l’évaluation des risques et la documentation font de la gouvernance une partie intégrante de votre flux de travail, et non un obstacle final qui ralentit votre progression.

Qu’est-ce que la gouvernance de l’IA pour les développeurs ?

La gouvernance de l’IA est l’ensemble des garde-fous qui garantit que l’intelligence artificielle est développée et utilisée de manière sûre, éthique et conforme aux réglementations. Pour vous, le développeur, cela n’est pas seulement une politique d’entreprise abstraite. C’est le cadre pratique qui guide la manière dont vous concevez, construisez et déployez des systèmes d’IA de manière responsable. Considérez-le comme le manuel qui aide à créer des outils puissants tout en minimisant les risques tels que les biais, les violations de la vie privée et les comportements imprévisibles.

Composants clés d’un cadre de gouvernance

Pensez à un cadre de gouvernance comme le système d’exploitation de la stratégie IA de votre entreprise. C’est un ensemble de règles, de plans et d’outils qui rassemble tout le monde – des équipes de données et des ingénieurs aux dirigeants juridiques et commerciaux. Un cadre solide rend vos modèles d’IA plus fiables et prévisibles, réduit les risques juridiques et de conformité, et apporte de la clarté sur la façon dont les décisions automatisées sont prises.

Votre rôle dans la gouvernance de l’IA

Bien que votre PDG et les dirigeants supérieurs soient finalement responsables de la stratégie IA de l’entreprise, votre rôle en tant que développeur est absolument critique. Vous êtes en première ligne. Parce que vous construisez, entraînez et testez les modèles, vous jouez un rôle direct dans la garantie que l’IA est équitable et fonctionne comme prévu. Les équipes juridiques et d’audit peuvent vérifier les risques et les biais, mais le développeur IA est le mieux équipé pour les empêcher d’être codés dans le système dès le départ.

Principes fondamentaux de la gouvernance de l’IA

La gouvernance de l’IA crée une structure claire et fiable qui guide votre travail. Ces principes fondamentaux sont la base de cette structure. Ils fournissent le « pourquoi » derrière les exigences techniques et aident à construire une IA qui est non seulement puissante mais également responsable, équitable et digne de confiance.

Transparence et explicabilité

La transparence signifie être ouvert sur l’utilisation de l’IA, ce qu’elle fait et comment vos modèles d’IA sont utilisés, tandis que l’explicabilité est votre capacité à décrire pourquoi un modèle a pris une décision spécifique en langage clair. En tant que développeur, cela signifie que vous devez aller au-delà de l’exactitude du modèle.

Équité et atténuation des biais

L’équité dans l’IA signifie que vos modèles ne créent ni ne perpétuent des biais contre certains groupes. Les biais peuvent souvent se glisser à travers les données utilisées pour entraîner le modèle, reflétant des préjugés historiques ou sociétaux. Votre rôle est d’identifier et d’atténuer activement ces biais.

Confidentialité et sécurité des données

Les modèles d’IA, en particulier dans l’apprentissage profond, sont gourmands en données. Cela rend la confidentialité et la sécurité des données absolument essentielles. Votre responsabilité est de protéger les informations personnelles à chaque étape, de la collecte et du stockage des données à l’entraînement et au déploiement du modèle.

Responsabilité claire

Lorsque un système d’IA commet une erreur critique, qui est responsable ? La responsabilité claire signifie définir la propriété des actions et des résultats de l’IA. Cela ne consiste pas à se renvoyer la balle ; il s’agit d’établir des lignes de responsabilité claires pour la surveillance, la gestion et la correction des systèmes d’IA.

Éthique fondationnelle

Au-delà des principes techniques se trouve une fondation éthique. Cela consiste à intégrer un ensemble de valeurs fondamentales – comme la sécurité, le bien-être humain et l’impact sociétal – dans votre travail. Il s’agit de se poser non seulement la question « Pouvons-nous construire cela ? » mais aussi « Devrions-nous construire cela ? ».

Outils pour mettre en œuvre la gouvernance de l’IA

Une gouvernance efficace de l’IA repose sur plus que des politiques et des procédures ; elle nécessite un ensemble pratique d’outils pour donner vie à votre cadre. En tant que développeur, ces outils sont vos alliés pour construire, déployer et maintenir une IA responsable.

Surveillance automatisée

Pensez à la surveillance automatisée comme un contrôle de santé continu pour vos systèmes d’IA. Une fois un modèle déployé, son travail est loin d’être terminé. Ces systèmes fonctionnent en arrière-plan pour détecter automatiquement des problèmes comme la dégradation des performances, le dérive des données ou l’émergence de biais.

Plateformes d’évaluation des risques

Gérer le complexe réseau de risques de l’IA est un défi majeur, surtout dans les industries réglementées. Les plateformes d’évaluation des risques fournissent un environnement structuré pour identifier, mesurer et atténuer les dommages potentiels associés à vos modèles d’IA.

Outils de gestion des données

Le principe « déchets dans, déchets dehors » est particulièrement vrai pour l’IA. La qualité et l’intégrité de vos données sont fondamentales pour construire des modèles équitables et fiables. Les outils de gestion des données sont essentiels pour faire respecter les normes de qualité, de confidentialité et de sécurité des données tout au long du cycle de vie de l’IA.

Tableaux de bord et analyses

Comment communiquer la santé et la conformité de vos systèmes d’IA aux parties prenantes qui ne sont pas dans les détails techniques ? Les tableaux de bord et les outils d’analyse traduisent des métriques de performance complexes en visualisations claires et intuitives.

Inventaire de l’IA

À mesure que l’utilisation de l’IA s’étend au sein d’une organisation, il est facile de perdre de vue tous les différents modèles en développement et en déploiement. Un inventaire de l’IA fonctionne comme un enregistrement centralisé pour tous vos systèmes d’IA.

Comment mettre en œuvre la gouvernance de l’IA

Mettre en pratique la gouvernance de l’IA consiste moins à créer un manuel rigide qu’à construire un système solide et flexible. C’est une approche structurée qui intègre des pratiques responsables directement dans votre cycle de développement.

Surmonter les défis courants de mise en œuvre

Un défi est que la technologie IA évolue souvent plus rapidement que les cadres conçus pour la gouverner. Cela peut créer un fossé frustrant où vos systèmes existants et vos flux de travail de développement ne se connectent pas facilement aux nouvelles exigences de gouvernance.

La gouvernance de l’IA efficace n’est pas un obstacle final à franchir avant le déploiement ; c’est un fil que vous tissez à travers chaque étape du cycle de développement. En intégrant la gouvernance dès le départ, vous créez un système plus robuste, éthique et conforme.