Tendances de l’IA pour 2026 – Naviguer à travers le patchwork de lois et de risques lors de l’utilisation des outils d’IA pour l’emploi

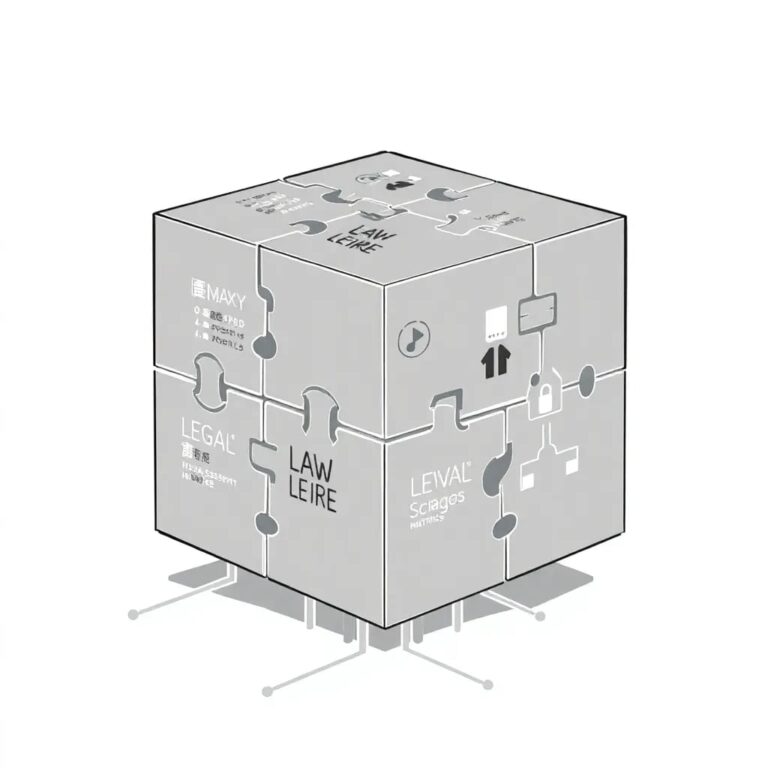

Les employeurs déploient de plus en plus d’outils d’IA pour rationaliser les fonctions clés des ressources humaines, allant du filtrage des CV à la gestion des performances et à d’autres fonctions de la main-d’œuvre. En 2026, ces outils ne sont plus expérimentaux ; certaines entreprises les intègrent dans leurs fonctions RH principales. Cependant, les législateurs, régulateurs et avocats des plaignants intensifient rapidement l’examen de l’utilisation de l’IA par les employeurs, cherchant à réglementer et à poursuivre des réclamations liées à ces outils. Avec l’émergence d’un patchwork de lois sur l’IA et de risques, les employeurs doivent comprendre comment naviguer efficacement dans ces défis de conformité et risques juridiques lors de l’utilisation des outils d’IA dans leur main-d’œuvre.

Conformité avec les lois sur l’IA en expansion et conflictuelles

Naviguer dans le patchwork en rapide expansion et en évolution des lois sur l’IA aux États-Unis et à l’étranger représente un défi important pour les entreprises nationales et internationales. De nombreux États et villes aux États-Unis ont adopté ou envisagent d’adopter leurs propres lois sur l’IA. Beaucoup de ces lois entreront en vigueur en 2026, y compris celles relatives à la loi sur les droits de l’homme de l’Illinois, à la loi sur l’IA du Colorado, et aux amendements à la loi californienne sur la protection de la vie privée des consommateurs. Ces lois comportent souvent de nombreuses exigences, notamment des audits de biais, des évaluations des risques et des exigences de divulgation.

La situation est compliquée par un décret exécutif qui tente de restreindre les États dans la réglementation de l’IA d’une manière qui contredit les priorités fédérales. En l’absence d’une préemption fédérale claire, les employeurs doivent déterminer comment créer des stratégies et des politiques cohérentes pour se conformer à l’utilisation des outils d’IA dans leur main-d’œuvre.

Risque croissant de réclamations pour discrimination

La tendance des régulateurs et des avocats à poursuivre des réclamations de discrimination contre les employeurs en raison de leurs outils d’IA devrait se poursuivre en 2026. Les employeurs doivent s’assurer que leurs outils d’IA ne discriminent pas les employés ou les candidats. Les employeurs restent pleinement responsables des résultats des outils d’IA qu’ils déploient, qu’ils soient développés en interne ou par des fournisseurs tiers.

Assurer la conformité avec les lois sur l’emploi existantes

Les employeurs doivent également vérifier que tout outil d’IA qu’ils utilisent respecte les lois sur l’emploi en vigueur. Par exemple, ils doivent prendre en compte les accommodations appropriées liées aux outils d’IA et aux évaluations de recrutement. De même, les outils d’IA peuvent présenter divers risques en matière de salaires et d’heures s’ils ne sont pas gérés correctement. Les employeurs qui considèrent le risque lié à l’IA comme une question juridique « nouvelle » peuvent négliger ces pièges de conformité hérités.

Stratégies pour naviguer dans les défis de l’IA

Pour naviguer dans ces enjeux, les employeurs doivent établir de bonnes politiques et contrôles lors de l’utilisation de l’IA à des fins RH. Voici quelques éléments à considérer :

- Développer des politiques de gouvernance de l’IA : Les employeurs devraient mettre en œuvre des politiques claires régissant l’utilisation de l’IA dans le recrutement, l’embauche, le suivi du temps de travail et d’autres fonctions RH. Ces politiques doivent inclure des discussions sur la supervision humaine appropriée, les exigences d’approbation des outils d’IA, et les obligations légales à considérer.

- Évaluer les fournisseurs : Les fournisseurs doivent être transparents sur le fonctionnement de leurs systèmes d’IA, y compris la façon dont leurs outils ont été testés pour le biais conformément aux exigences légales. Les assurances routinières ne sont pas acceptables.

- Auditer les outils d’IA pour le biais : Les audits de biais sont essentiels et doivent être réalisés conformément aux exigences légales pour atténuer les risques de discrimination.

- Assurer une formation et une supervision appropriées : Une formation adéquate pour toute personne utilisant ou s’appuyant sur des outils d’IA pour des fonctions RH est cruciale. Les professionnels des RH doivent comprendre les limites des outils et savoir quand l’intervention humaine est nécessaire.