IBM met en lumière la différence entre le langage éthique et la compétence morale en IA

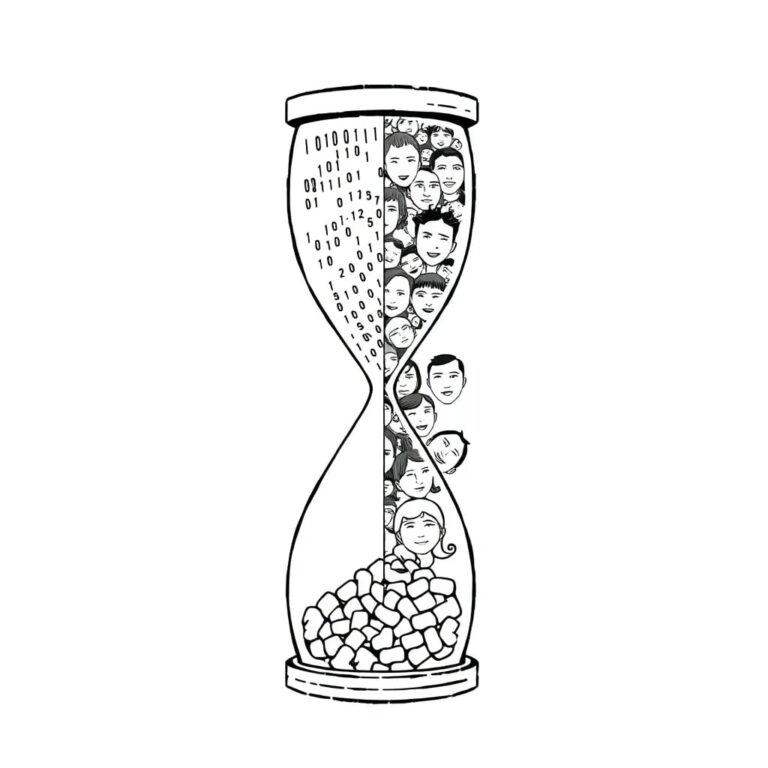

IBM souligne une distinction cruciale entre l’intelligence artificielle qui semble éthique et celle qui démontre un véritable raisonnement moral, une différence ayant des implications significatives pour les applications de la technologie de plus en plus complexes. Des études récentes suggèrent que les grands modèles de langage peuvent imiter de manière convaincante le langage éthique sans posséder réellement de compétence morale. Ces systèmes excellent dans l’identification de schémas statistiques dans le texte, plutôt que dans le jugement éthique raisonné.

Analyse des interactions avec les chatbots

Les chercheurs ont analysé plus de 300 000 conversations avec un chatbot, identifiant 3 307 valeurs distinctes exprimées. Ils ont constaté que le modèle reflétait largement les valeurs des utilisateurs, soulevant des inquiétudes quant à l’utilisation de ce que certains experts décrivent comme « une fonction d’auto-complétion très coûteuse » dans des décisions critiques.

Les grands modèles de langage génèrent désormais régulièrement du texte qui semble traiter de dilemmes éthiques complexes. Cependant, des recherches émergentes indiquent que cette capacité découle de la prédiction statistique plutôt que d’un véritable raisonnement moral. Un appel est lancé pour de nouveaux critères d’évaluation axés sur la « compétence morale ».

Nature des modèles de langage

Au cœur de ce phénomène réside la manière dont ces modèles sont construits. Ils prédisent le mot suivant le plus probable en fonction des schémas appris à partir de vastes ensembles de données de textes et de codes. Ce processus, bien qu’efficace pour imiter le discours éthique humain, n’implique pas la compréhension des principes sous-jacents.

Une étude a révélé que le modèle avait tendance à s’aligner sur les valeurs exprimées par les utilisateurs, renforçant souvent des thèmes comme le développement personnel ou la construction de communauté. Les cas de résistance forte aux demandes des utilisateurs étaient rares, survenant dans environ 3 % des conversations, généralement en cas de demande de contenu nuisible.

Questions critiques sur les décisions morales

Cette dynamique soulève des questions critiques sur la délégation des décisions morales à des systèmes construits sur des sous-ensembles de données déterminés statistiquement. L’accent croissant mis sur l’intelligence artificielle se concentre sur la capacité de ces systèmes à comprendre véritablement des concepts complexes comme l’éthique, ou s’ils semblent simplement les comprendre.

Conclusion et perspectives futures

Alors que les chatbots peuvent articuler des principes d’honnêteté et de transparence, des investigations récentes suggèrent que cette aisance provient de la reconnaissance de schémas plutôt que d’une véritable délibération éthique. La nécessité de systèmes capables de formaliser des règles éthiques devient de plus en plus évidente.