La Loi sur l’IA de l’UE est arrivée : Ce qu’il faut savoir

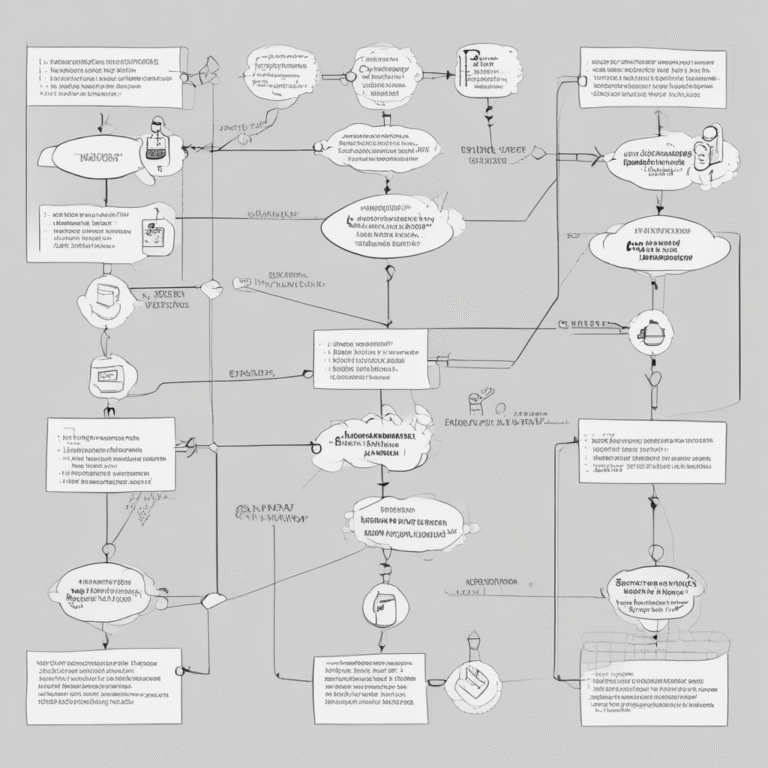

La Loi sur l’IA de l’UE est maintenant en vigueur, marquant le début d’une nouvelle ère de conformité pour les entreprises opérant dans l’Union européenne. À compter du 2 août 2025, des pénalités, y compris des amendes administratives, sont applicables. La prochaine échéance pour les systèmes à haut risque, qui incluent de nombreux produits médicaux utilisant des systèmes d’intelligence artificielle (IA), est prévue dans un an, nécessitant une conformité pour les systèmes d’IA mis sur le marché avant le 2 août 2026.

Les étapes déjà en vigueur : Échéances d’août 2025

La loi s’applique rétroactivement à tous les modèles d’IA à usage général en cours d’utilisation dans l’UE à partir du 2 août 2025. Cela inclut des exigences importantes telles que :

- Chapitre III Section 4 : Établissement des autorités de notification et des procédures de notification;

- Chapitre V : Exigences complètes pour les modèles et systèmes d’IA à usage général;

- Chapitre VII : Gouvernance aux niveaux national et de l’Union;

- Chapitre XII : Pénalités.

Les modèles d’IA à usage général en opération dans l’UE avant le 2 août 2025 doivent finaliser la documentation et les étapes de déclaration d’ici le 2 août 2027. Les dispositions de confidentialité de l’Article 78 de la loi sont également en vigueur, avec des pénalités futures pouvant atteindre jusqu’à 3% des revenus mondiaux ou 15 millions d’euros, selon le montant le plus élevé.

Le compte à rebours pour l’application en août 2026

La loi sera entièrement applicable le 2 août 2026, avec une période de phase pour les systèmes à haut risque décrits à l’Article 6. Un système est classé comme à haut risque si son utilisation prévue peut poser un risque élevé pour la santé et la sécurité ou les droits fondamentaux des personnes.

Les dispositifs médicaux, les dispositifs de diagnostic in vitro (IVD) et les logiciels utilisés dans le triage des soins de santé sont explicitement désignés comme des systèmes à haut risque. La loi vise à compléter les lois existantes telles que le Règlement MDR de l’UE (2017/745) et le Règlement IVDR de l’UE (2017/746).

Ce qui vient : Application complète d’ici le 2 août 2027

Les dispositions restantes de la loi nécessiteront une conformité d’ici le 2 août 2027. À cette date, la loi s’appliquera à tous les systèmes d’IA à haut risque entrant en service dans l’UE.

Les opérateurs de systèmes à haut risque, en particulier ceux des dispositifs médicaux et des applications de diagnostic in vitro soumis à des exigences de marquage CE, devront être conformes à cette échéance finale.

Portée et juridiction de la loi

La loi s’applique généralement aux entreprises introduisant des systèmes d’IA sur le marché ou les mettant en service dans l’UE. Des nuances existent quant à l’applicabilité de la loi selon la nature de l’implication d’une entreprise dans le développement ou le déploiement du système d’IA.

Les modèles et systèmes utilisés uniquement pour la recherche et le développement ainsi que ceux en phase de développement pré-commercial sont exemptés de conformité jusqu’à ce que leurs applications soient commercialisées.

Soutien des experts : Le rôle du panel scientifique

Reconnaissant la nécessité d’une surveillance technique continue, l’UE a lancé un panel scientifique d’experts indépendants. Ce panel soutient le Bureau de l’IA dans l’évaluation des risques techniques, des classifications d’IA et des menaces systémiques. Il peut émettre des « alertes qualifiées » lorsque de nouveaux risques sont identifiés.

Étapes suivantes pour les entreprises Medtech et développeurs d’IA

Avec les dispositions clés de la Loi sur l’IA de l’UE maintenant en vigueur et l’application complète prévue pour le 2 août 2027, les entreprises Medtech opérant dans l’UE doivent agir rapidement. L’étendue rétroactive de la réglementation, la désignation des systèmes à haut risque et l’introduction d’un cadre de sandbox réglementaire représentent à la fois des défis de conformité et des opportunités d’innovation.

Les entités soumises à la loi devraient commencer par évaluer leur exposition, mettre à jour leur documentation et se préparer à interagir avec les régulateurs.