À l’intérieur de la bataille des plateformes d’IA : Comment les LLMs s’affrontent sur le coût, la confiance et le contrôle

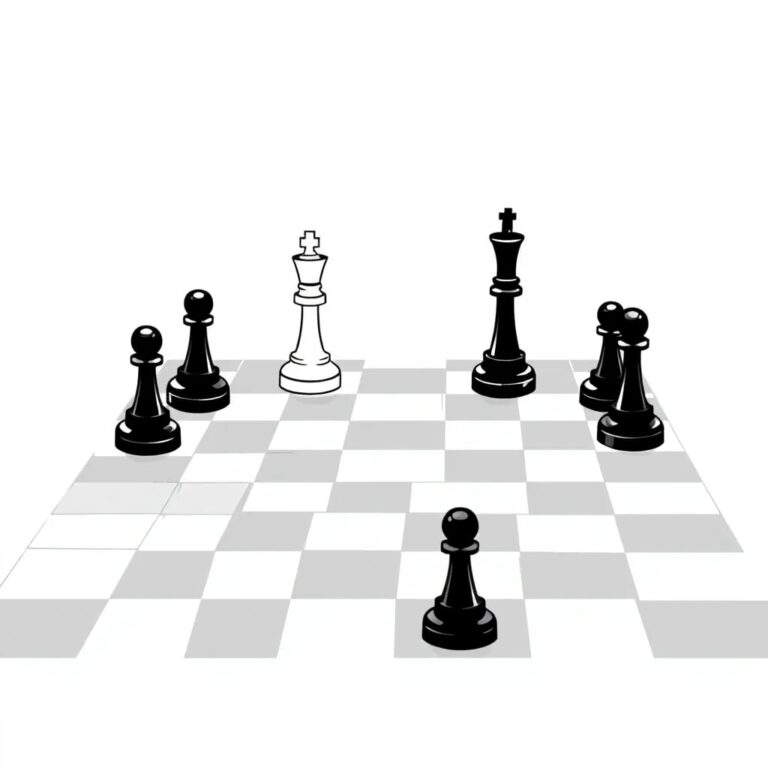

Trois ans après que ChatGPT ait secoué la Silicon Valley, la course aux modèles de langage de grande taille (LLM) ne se limite plus à savoir qui peut atteindre le plus d’utilisateurs. Il s’agit maintenant d’un concours sur le coût, la confiance et le contrôle de la pile d’IA émergente.

Les acteurs principaux ne se contentent plus de publier des modèles plus grands ou plus rapides. Ils construisent des plateformes à grande échelle, intégrant des modèles dans des systèmes d’exploitation, des logiciels de productivité, des moteurs de recherche et des outils pour développeurs, afin de fidéliser les utilisateurs au sein des flux de travail quotidiens.

Le résultat est une bataille rapide qui ressemble de plus en plus à une guerre des systèmes d’exploitation pour une nouvelle ère de l’informatique. Des LLMs leaders comme ChatGPT d’OpenAI à Claude d’Anthropic, ces modèles rivalisent désormais non seulement pour l’attention des utilisateurs, mais aussi pour une utilisation à long terme, tout en essayant de transformer l’utilisation habituelle en revenus d’abonnement.

Les différences fondamentales

Dans la « constitution » récemment publiée de Claude, Anthropic indique que le « statut moral » du modèle est profondément incertain. L’entreprise ne revendique pas la conscience ; elle refuse de rejeter la question et soutient qu’il est plus sûr de concevoir en tenant compte de cette incertitude, une posture inhabituelle dans un domaine où de nombreux laboratoires minimisent ou rejettent la question.

Cette publication coïncide avec l’apparition du PDG lors d’un forum économique mondial, un moment où la gouvernance de l’IA a été mise en avant, plaçant la transparence d’Anthropic devant les décideurs et les acheteurs d’entreprises sensibles aux risques. La sécurité et l’éthique de l’IA sont devenues le différenciateur central de l’entreprise.

Différenciation sur le marché

Anthropic se positionne pour avoir un avantage concurrentiel sur le marché, en le présentant comme plus qu’un simple outil. Cet engagement résonne fortement avec les clients d’entreprises averses au risque et les décideurs. La méthodologie de formation d’Anthropic garantit que ses modèles, comme Claude, adhèrent à un ensemble de principes éthiques, ce qui les rend plus fiables et résistants à la production de résultats nuisibles ou biaisés.

De plus, on constate que près de 80 % de l’utilisation de Claude par les consommateurs provient de l’extérieur des États-Unis, avec une utilisation par habitant dans des pays comme la Corée du Sud, l’Australie et Singapour dépassant celle des États-Unis.

Les acteurs majeurs

OpenAI reste l’acteur le plus visible dans l’IA grand public, avec ChatGPT qui sert toujours de référence pour des millions d’utilisateurs à travers le monde. Son avantage provient de l’échelle et de la diversité de l’écosystème. Les utilisateurs payants peuvent passer sans effort entre le texte, la voix, la génération d’images et les GPTs personnalisés dans une seule interface.

Microsoft, de son côté, mise sur la distribution et le contexte. Copilot est intégré dans plusieurs applications, permettant aux entreprises déjà abonnées aux logiciels Microsoft de bénéficier de l’IA sans établir une nouvelle relation avec un fournisseur. Contrairement aux chatbots autonomes, Copilot peut puiser dans les documents et les réunions au sein du flux de travail existant d’une entreprise, ce qui fait du contexte un facteur différenciateur important.

Google, avec son initiative Gemini, s’appuie sur la multimodalité native, permettant aux modèles de comprendre et de raisonner à travers le texte, les images, l’audio, la vidéo et le code dans une seule architecture. Cela permet à Gemini de s’intégrer profondément dans les produits principaux de Google.

Meta, quant à elle, a choisi une voie peu orthodoxe en publiant des modèles Llama de plus en plus puissants, accessibles au téléchargement et à la modification, ce qui élargit leur adoption. Perplexity se distingue en agissant davantage comme un outil de recherche, mettant l’accent sur la précision et la transparence.

Conclusion

Le paysage des LLMs évolue rapidement, chaque fournisseur cherchant à tirer parti d’un avantage spécifique pour fidéliser les utilisateurs et générer des revenus. La bataille pour le coût, la confiance et le contrôle façonne l’avenir de l’intelligence artificielle, réinventant notre interaction avec la technologie.