Introduction

L’intelligence artificielle (IA) progresse à un rythme sans précédent, transformant les industries et redéfinissant notre façon de vivre et de travailler. Cependant, avec ces avancées rapides viennent des défis significatifs, notamment en matière d’équilibre entre innovation et nécessité de réglementation. Cet article explore pourquoi certains experts plaident pour l’interdiction de l’intelligence artificielle, en soulignant l’importance de trouver un équilibre entre la promotion de l’innovation et la mise en œuvre de réglementations nécessaires pour garantir un déploiement éthique et sûr de l’IA.

La nécessité de la réglementation

Justifications pour la réglementation

Alors que les technologies de l’IA continuent d’évoluer, il y a un appel croissant à la réglementation pour aborder diverses préoccupations. Les raisons clés incluent :

- Compétition sur le marché : Assurer des conditions de concurrence équitables et prévenir les pratiques monopolistiques.

- Préoccupations relatives à la vie privée : Protéger les droits des individus concernant leurs données au milieu de la collecte massive de données par l’IA.

- Protection de la propriété intellectuelle : Sauvegarder les innovations et la créativité au sein du secteur de l’IA.

- Utilisations militaires : Prévenir le développement et le déploiement d’armes autonomes.

- Questions éthiques : Aborder les biais et garantir l’équité dans les algorithmes de l’IA.

- Risques pour la stabilité financière : Atténuer les perturbations économiques potentielles causées par l’IA.

Exemples d’efforts de réglementation

À l’échelle mondiale, plusieurs initiatives ont été lancées pour réglementer efficacement l’IA :

- Règlement sur l’IA de l’UE : Établit un cadre basé sur le risque axé sur la sécurité, la transparence et les droits de l’homme.

- Directives américaines : Bien qu’il manque une législation complète, les États-Unis s’appuient sur des directives décentralisées.

- Examens des algorithmes en Chine : Se concentre sur l’examen des algorithmes pour garantir leur conformité aux politiques d’État.

Défis de la sur-réglementation

Impact sur les startups

Une réglementation excessive peut créer des barrières significatives pour les nouveaux entrants sur le marché de l’IA. Les startups, qui sont souvent à l’avant-garde de l’innovation, pourraient avoir du mal à faire face aux charges financières et administratives de la conformité, étouffant ainsi la créativité et ralentissant le progrès technologique.

Étouffer l’innovation

La sur-réglementation présente le risque de freiner le rythme des avancées en IA. En imposant trop de restrictions, il existe un danger d’étouffer le potentiel d’innovation que l’IA détient, ce qui pourrait finalement retarder des solutions bénéfiques pour la société dans son ensemble.

Équilibrer réglementation et innovation

Cadres basés sur des principes

L’approche du Royaume-Uni en matière de réglementation de l’IA illustre un cadre basé sur des principes, mettant l’accent sur la flexibilité et l’adaptation rapide. Cette stratégie permet une évolution continue des lignes directrices en réponse aux avancées technologiques, évitant ainsi les pièges des réglementations rigides et obsolètes.

Gouvernance collaborative

Une réglementation efficace de l’IA nécessite une collaboration entre les décideurs politiques, les entreprises et la société civile. En engageant plusieurs parties prenantes, un cadre réglementaire plus complet et équilibré peut être développé, garantissant que les besoins et les préoccupations de toutes les parties sont pris en compte.

Exemples concrets et études de cas

Mise en œuvre du Règlement sur l’IA de l’UE

L’approche fondée sur le risque du Règlement sur l’IA de l’UE sert de précieuse étude de cas. Elle catégorise les systèmes d’IA en fonction de leurs niveaux de risque, permettant des réglementations adaptées qui répondent à des préoccupations spécifiques sans imposer de charges inutiles aux technologies à faible risque.

Approches des États-Unis et de la Chine

Comparer les directives décentralisées aux États-Unis avec les examens algorithmiques de la Chine met en lumière la diversité des stratégies réglementaires. Les États-Unis se concentrent sur des directives flexibles, tandis que la Chine met l’accent sur une surveillance stricte, reflétant des priorités et des styles de gouvernance différents.

Explications techniques

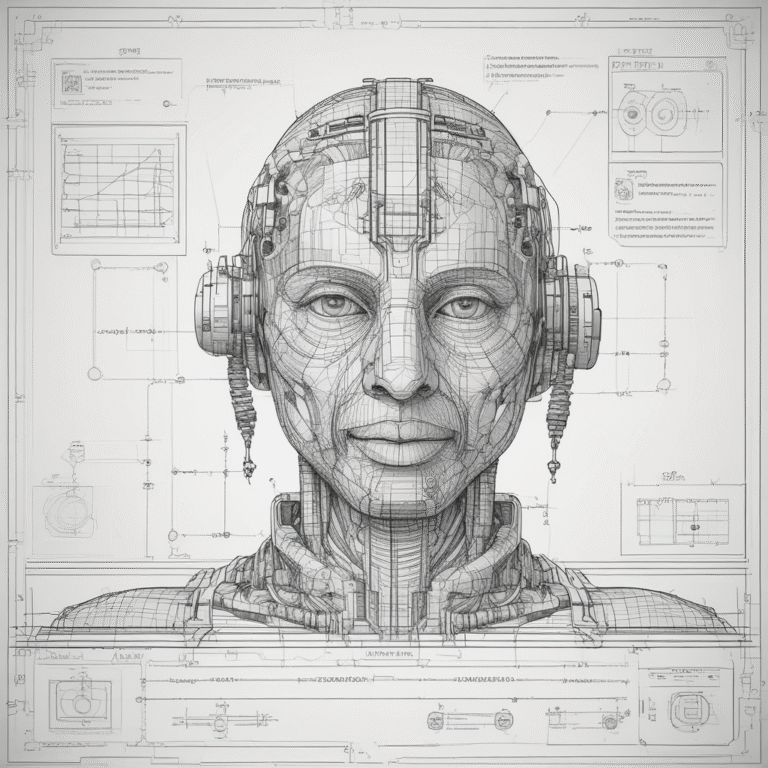

Développement de modèles d’IA

Le développement de modèles d’IA implique des processus complexes qui nécessitent une attention particulière aux implications éthiques. Garantir que les systèmes d’IA sont conçus et déployés de manière responsable est crucial pour maintenir la confiance du public et éviter des conséquences involontaires.

Conformité réglementaire

Pour les entreprises, naviguer dans le paysage complexe des réglementations sur l’IA peut être un défi. Des guides étape par étape et des outils peuvent aider les organisations à garantir leur conformité, à atténuer les risques et à favoriser une culture de responsabilité et de transparence.

Informations exploitables

Meilleures pratiques pour le développement de l’IA

Pour développer des systèmes d’IA de manière responsable, les entreprises doivent donner la priorité à la transparence, à la responsabilité, à l’équité et à la réparation. Ces principes constituent la base du développement éthique de l’IA, garantissant que les systèmes sont conçus en tenant compte des intérêts humains.

Outils et plateformes pour la conformité

De nombreux outils existent pour aider les organisations à gérer les risques liés à l’IA et à se conformer aux réglementations. Ces plateformes offrent des solutions pour surveiller les systèmes d’IA, évaluer leur impact et garantir leur conformité aux lignes directrices établies.

Cadres pour une IA éthique

Des méthodologies telles que la supervision contextualisée et la responsabilité des utilisateurs finaux jouent un rôle essentiel dans la promotion d’une IA éthique. En incorporant ces cadres, les développeurs peuvent s’assurer que leurs systèmes d’IA s’alignent sur les valeurs sociétales et les normes éthiques.

Défis et solutions

Défis clés

Les principaux défis en matière de réglementation de l’IA incluent la sur-réglementation, le manque de clarté et le maintien de la compétitivité mondiale. Naviguer dans ces questions nécessite une approche nuancée qui équilibre innovation et supervision nécessaire.

Solutions

La mise en œuvre de cadres basés sur des principes, l’encouragement de l’auto-réglementation et la promotion de la coopération internationale sont des stratégies clés pour surmonter les défis réglementaires. Ces solutions favorisent un équilibre harmonieux entre innovation et réglementation.

Dernières tendances et perspectives d’avenir

Développements récents

Les actions réglementaires récentes reflètent une attention croissante portée à la gouvernance structurée de l’IA. Ces développements soulignent l’importance d’aligner les réglementations sur les avancées technologiques pour garantir que les systèmes d’IA sont sûrs et éthiques.

Tendances à venir

La réglementation de l’IA est susceptible d’évoluer vers des modèles plus décentralisés ou d’auto-réglementation. À mesure que la technologie progresse, des cadres adaptatifs qui accommodent l’innovation tout en protégeant les intérêts publics seront cruciaux.

Compétition mondiale

La compétition internationale a un impact significatif sur les stratégies de réglementation et d’innovation en matière d’IA. Les pays doivent naviguer dans l’équilibre délicat entre la promotion des avancées nationales en IA et le respect des normes mondiales pour rester compétitifs.

Conclusion

Le débat sur l’interdiction de l’intelligence artificielle souligne les défis persistants liés à l’équilibre entre innovation et réglementation. Bien que l’IA recèle un potentiel immense pour des bénéfices sociétaux, elle présente également des risques qui nécessitent une supervision attentive. En adoptant des cadres réglementaires flexibles basés sur des principes et en favorisant la collaboration entre les parties prenantes, nous pouvons trouver un équilibre qui promeut l’innovation tout en garantissant un déploiement sûr et éthique des technologies d’IA.